本文主要是介绍欧洲版OpenAI疑似将在24年发布并开源GPT-4级别模型!,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

大家好,我是二狗。

今天在推特上看到一条振奋人心的消息:

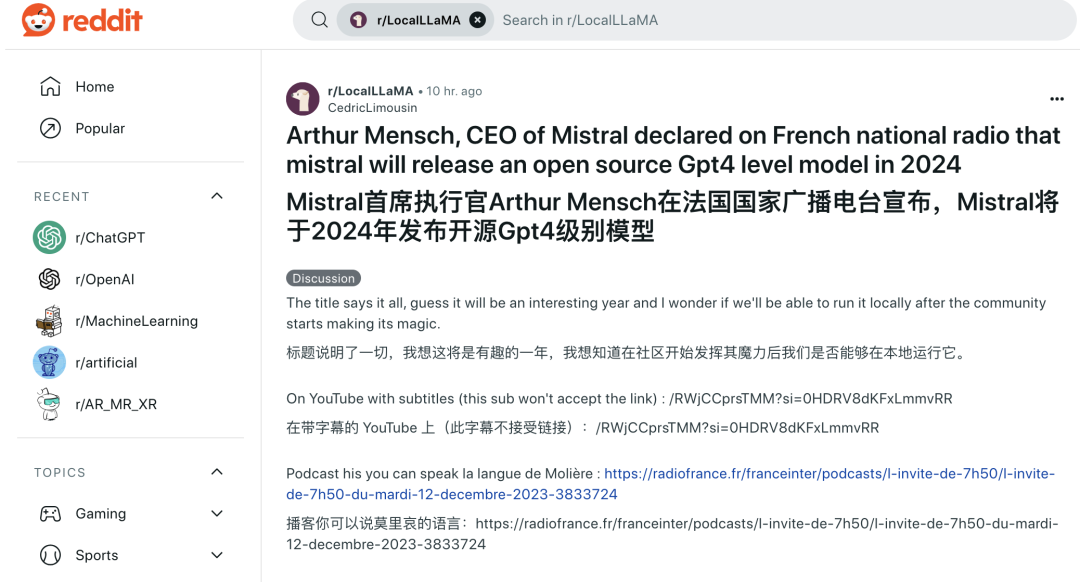

“ 欧洲版OpenAI、法国初创公司 Mistral 首席执行官 Arthur Mensch 在法国国家广播电台宣布,Mistral 将在 2024 年发布开源 GPT-4 级别模型。”

这位老哥接着表示甚至可能是免费的!

这一下子把二狗我给看激动了!

GPT-4级别模型将要免费开源,这可是天大的福利啊!

新一轮百模大战估计又要打响!国产“自主研发”大模型又要崛起了(手动狗头)。

然而当二狗我点进去这个网址后,发现自己可能高兴早了。这个网址是一个语音博客,而且还是法语的,二狗我表示听不懂。

听不懂那我没法证实“Mistral 将在 2024 年发布开源 GPT-4 级别模型”这条消息是可靠的。”好在reddit上有网友在吃瓜讨论。

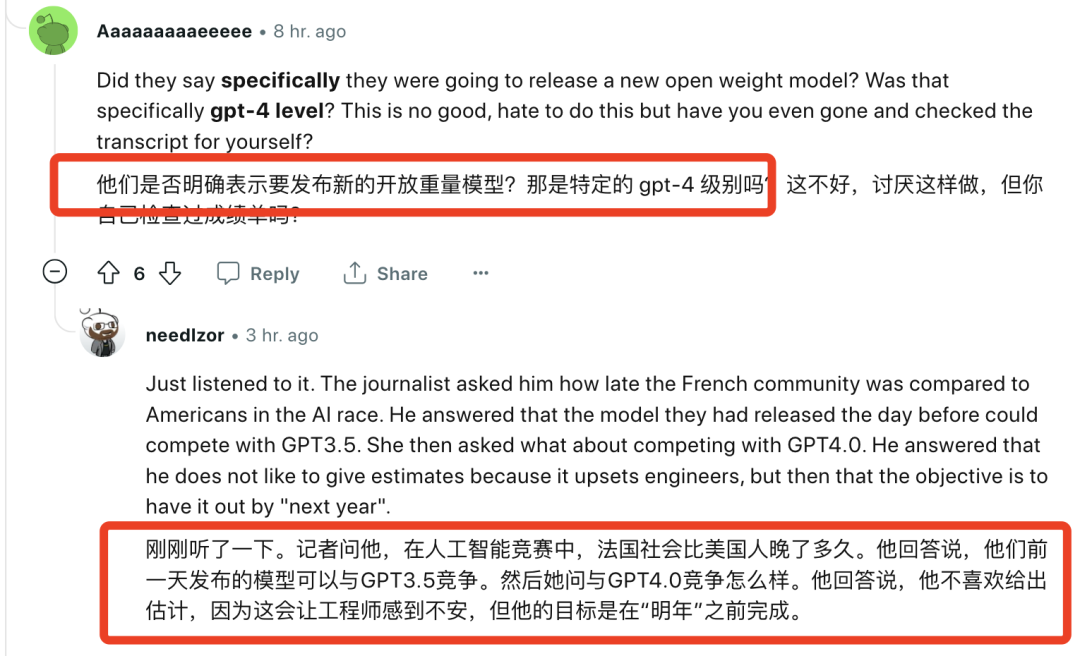

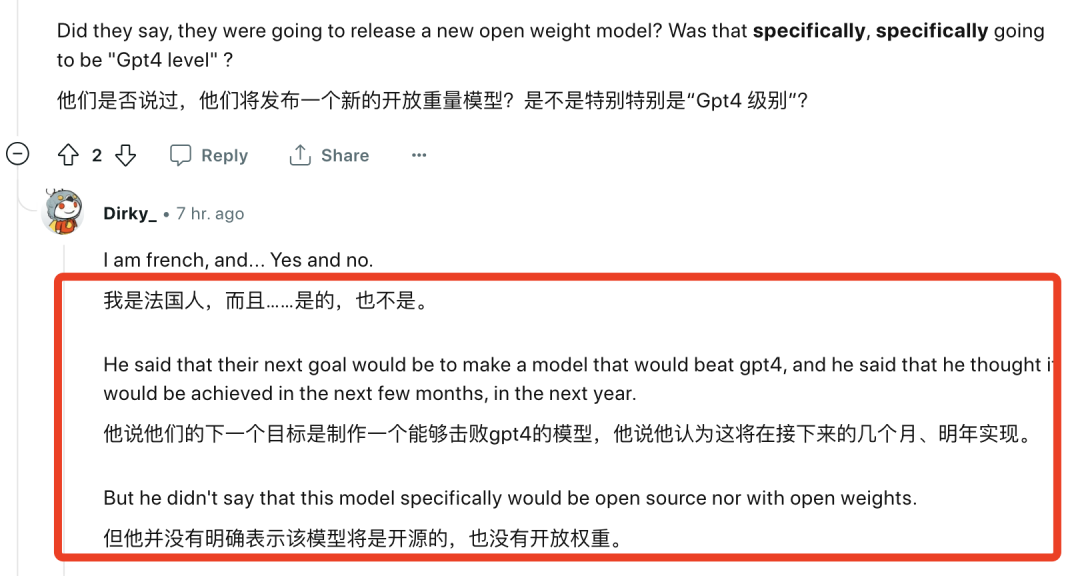

很显然,大家都在关心 Mistral 的CEO到底有没有明确表示要开源 GPT-4 级别的模型。

很遗憾,有懂法语的网友表示Mistral 的CEO只表示明年要推出和GPT-4竞争的模型,但没有表明要开源。

另一位法国网友也证实了没有提到开源的事情。

好难过,一大期待可能要落空了。

但是,好在Mistral 的CEO也没有明确表示不会开源!

以Mistral 公司一直坚持开源的路线,还是有希望的!

为何大家对Mistral有所期待?

因为就在前几天,Mistral AI开源的一个Mixtral 8x7B MoE模型引爆了AI社区。

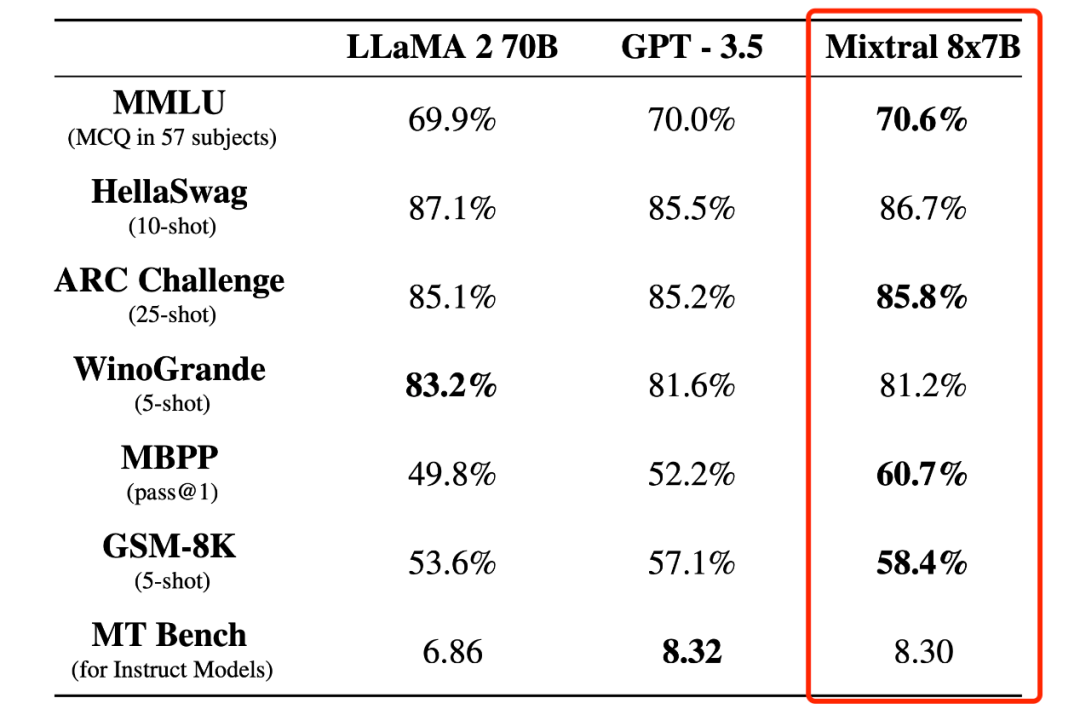

一是因为它的性能击败了LLama2和GPT-3.5。

二是因为,Mixtral是一个专家混合模型(Mixture-of-Experts model,MoE),使用了传闻中 OpenAI 用于GPT-4的架构,但是参数相比GPT-4要小很多,堪称是缩小版“GPT-4”。

而且这个模型还开源了,Mistral AI甚至直接通过torrent链接将其甩在推特上发布。

huggingface下载链接:

https://huggingface.co/mistralai/Mixtral-8x7B-Instruct-v0.1

Mixtral 8x7B MoE模型当前支持:

-

在 Apache 2.0 许可下免费使用;

-

推理速度提高6 倍,性能优于 Llama 2 70B模型。

-

性能匹配或优于 GPT3.5;

-

上下文长度为32K;

-

精通英语、法语、意大利语、德语和西班牙语;

三是因为Mistral AI带来的格局变化。

Mistral AI 目前已是欧洲最强的大模型公司,团队由来自 Google、Meta 和 Hugging Face的新生代科学家们组成,目前只有20人左右。

Mistral AI 最近完成了由 A16z 领投的 4.15 亿美元 A 轮融资,估值为 20 亿美元。

Mistral AI的崛起带来了两点格局变化。

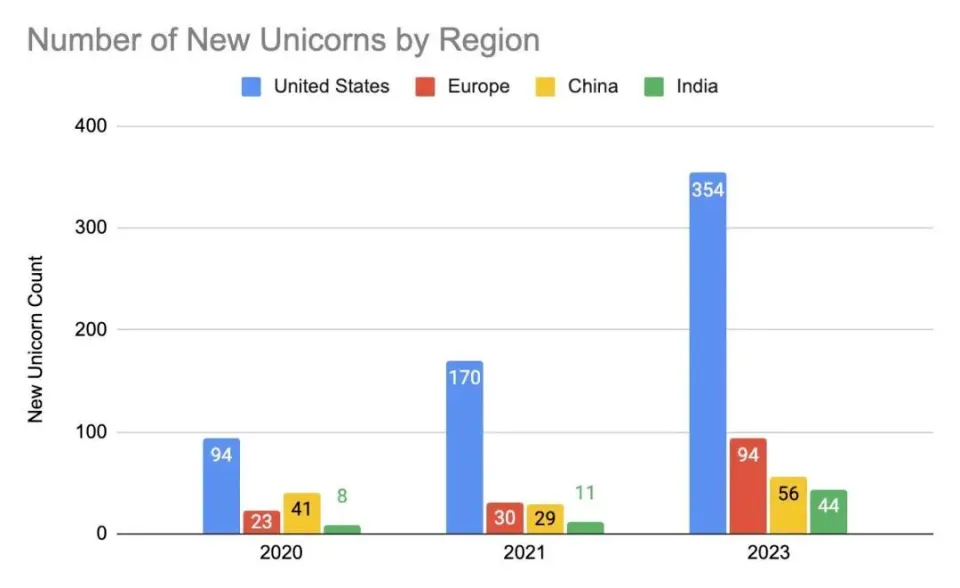

一是欧洲和美、中竞争格局变化。

最新这十年,在投资和创新方面,欧洲的AI企业一直落后于美国和中国的同行。

然而这次Mistral AI的成功,可能标志着一个决定性的转变——欧洲在AI创新方面走到了最前沿。

二是开源和私有模型竞争格局变化。

在生成式AI的竞争舞台上,OpenAI、Google DeepMind等老牌巨头 已经走向了闭源,而Mistral AI的打法是开源,这一点和Meta很相似。

虽然目前业界最强的大模型是GPT-4或者Gemini,但正如Yann LeCun所说, 开源AI模型正在超越私有模型。

未来,以Mistral AI为代表的开源模型会不会彻底赶上甚至超越私有模型,让我们拭目以待吧。

这篇关于欧洲版OpenAI疑似将在24年发布并开源GPT-4级别模型!的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!