本文主要是介绍【Hadoop】执行start-dfs.sh启动hadoop集群时,datenode没有启动怎么办,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

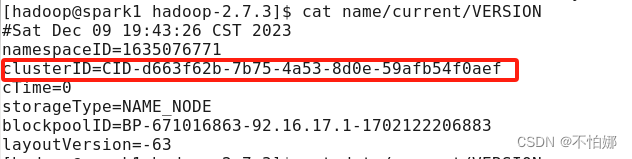

执行start-dfs.sh后,datenode没有启动,很大一部分原因是因为在第一次格式化dfs后又重新执行了格式化命令(hdfs namenode -format),这时主节点namenode的clusterID会重新生成,而从节点datanode的clusterID 保持不变。

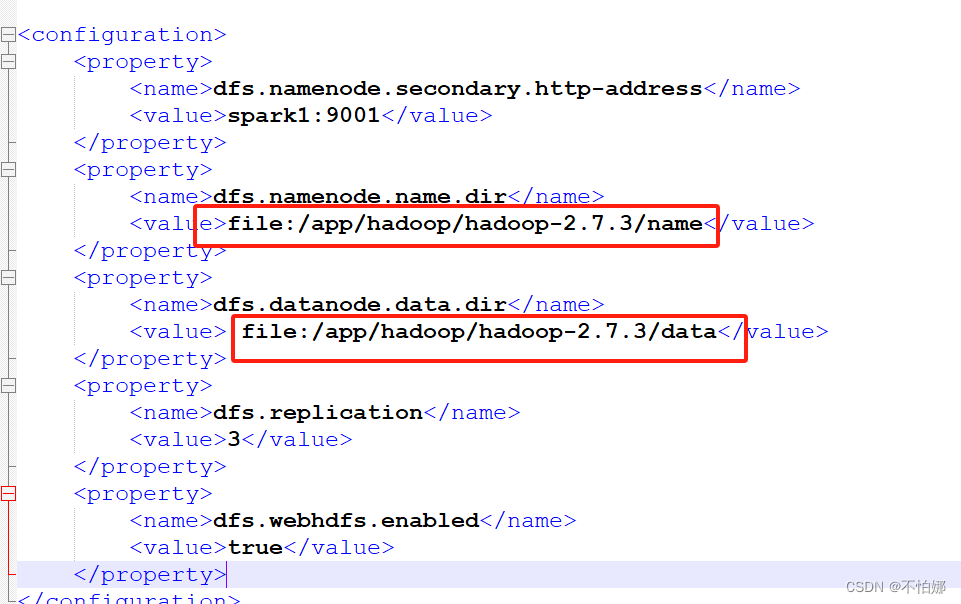

在主节点也就是namenode那个节点上的hdfs-site.xml文件下找到这两个文件路径

打开name目录中current下面的VERSION文件,然后用这个clusterID替换掉datanode节点上的data/current/VERSION里的clusterID

参考http://t.csdnimg.cn/Gk4cg

这篇关于【Hadoop】执行start-dfs.sh启动hadoop集群时,datenode没有启动怎么办的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!