本文主要是介绍CIFAR-10数据集说明,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

CIFAR-10数据集说明

小白一枚~

由于正在学习cs231n,第一节课就涉及到用这个数据集进行图像分类。该数据集的页面:http://www.cs.toronto.edu/~kriz/cifar.html

/*************************************************************************************************************************************************************/

CIFAR-10和CIFAR-100是带有标签的数据集,都出自于规模更大的一个数据集,他有八千万张小图片(http://groups.csail.mit.edu/vision/TinyImages/。这个是一个大项目,你可以点击那个big map提交自己的标签,可以帮助他们训练让计算机识别物体的模型)

- CIFAR-10

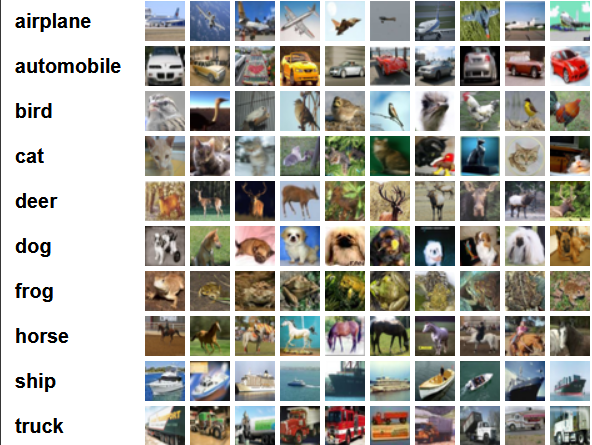

该数据集共有60000张彩色图像,这些图像是32*32,分为10个类,每类6000张图。这里面有50000张用于训练,构成了5个训练批,每一批10000张图;另外10000用于测试,单独构成一批。测试批的数据里,取自10类中的每一类,每一类随机取1000张。抽剩下的就随机排列组成了训练批。注意一个训练批中的各类图像并不一定数量相同,总的来看训练批,每一类都有5000张图。

下面这幅图就是列举了10各类,每一类展示了随机的10张图片:

屏幕剪辑的捕获时间: 2017/12/24 19:31

需要说明的是,这10类都是各自独立的,不会出现重叠。

数据的下载:

(共有三个版本:python,matlab,binary version 适用于C语言)

http://www.cs.toronto.edu/~kriz/cifar-10-python.tar.gz

http://www.cs.toronto.edu/~kriz/cifar-10-matlab.tar.gz

http://www.cs.toronto.edu/~kriz/cifar-10-binary.tar.gz

Baseline results (基线结果?还不是很懂)

你可以在cuda-convert的项目页面上找到此数据集上的一些基线可复制的结果。这个结果是由CNN卷积神经网络得到的。简要的说,在没有数据扩充的情况下,测试误差为18%,反之为11%。

(emmm这段感觉关系不大。。。)

数据集布局

Python/Matlab 版本

这两个数据形式是一样的,就以python为例。

该数据集文件包含data_batch1……data_batch5,和test_batch。他们都是由cPickle库产生的序列化后的对象(关于pickle,移步https://docs.python.org/3/library/pickle.html)。这里给出python2和python3的例程,他可以打开这样的pkl文件,返回一个字典结构的数据:

Python2:

1 def unpickle(file): 2 import cPickle 3 with open(file, 'rb') as fo: 4 dict = cPickle.load(fo) 5 return dict

Python3:

1 def unpickle(file): 2 import pickle 3 with open(file, 'rb') as fo: 4 dict = pickle.load(fo, encoding='bytes') 5 return dict

这样的话,每个batch文件包含一个字典,每个字典包含有:

-

-

Data

一个10000*3072的numpy数组(numpy:https://docs.scipy.org/doc/numpy-dev/user/quickstart.html),数据类型是无符号整形uint8。这个数组的每一行存储了32*32大小的彩色图像(32*32*3通道=3072)。前1024个数是red通道,然后分别是green,blue。另外,图像是以行的顺序存储的,也就是说前32个数就是这幅图的像素矩阵的第一行。

-

-

-

labels

一个范围在0-9的含有10000个数的列表(一维的数组)。第i个数就是第i个图像的类标。

-

数据集除了6个batch之外,还有一个文件batches.meta。它包含一个python字典对象,内容有:

一个包含10个元素的列表,每一个描述了labels array中每个数字对应类标的名字。比如:label_names[0] == "airplane", label_names[1] == "automobile"

/*******************************

二进制版本

该版本包含5个训练批data_batch_1.bin, data_batch_2.bin, ..., data_batch_5.bin,1个测试批test_batch.bin。他们的格式都是:

<1 x label><3072 x pixel> ... <1 x label><3072 x pixel>

来自 <http://www.cs.toronto.edu/~kriz/cifar.html>

也就是说,第一个字节是指类标,在0-9之间。接下来就是3072个字节,内容与上面python版本的的一样。每个文件都有10000这样的3073个字节,没有任何分隔行,所以每个文件都是30730000字节的长度。

与python版本类似,还有一个文件batches.meta.txt。这是一个ASCII文件,同样是把0-9数字类标和每一类的名字对照起来。

这篇关于CIFAR-10数据集说明的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!