0、使用NLPIR-ICTCLAS2014分词系统之前的准备

下载NLPIR-ICTCLAS2014的下载包。高速传送门:

http://ictclas.nlpir.org/upload/20140618094605_ICTCLAS2014.zip

须要有自己的词库(事实上没有都没问题,词库仅仅是我自己须要用到的,某个方面的词汇,来帮助进行页面分析的)

1、高速从NLPIR-ICTCLAS2014的下载包中获得我们须要的东西

首先来看一下整个目录的结构

Data目录中,含有分词须要用到的字典,Configure.xml里面有相关的描写叙述信息;doc里面是使用帮助(介绍了基本须要使用到的函数接口);include、lib自然是我们主要用到的;sample是演示样例代码;test里面有一个exe演示样例;授权自然是License。应该是通过某种形式来限制我们的使用的。眼下临时还不清楚,假设到时候被限制,还须要进行调试。

2、从下载包中抽出我们须要的。并新建一个样例

从上面来看,我们须要用到的主要有三个目录Data、include、lib(我是打算做的32位程序,所以仅仅须要用里面的

lib\win32下的dll和lib)

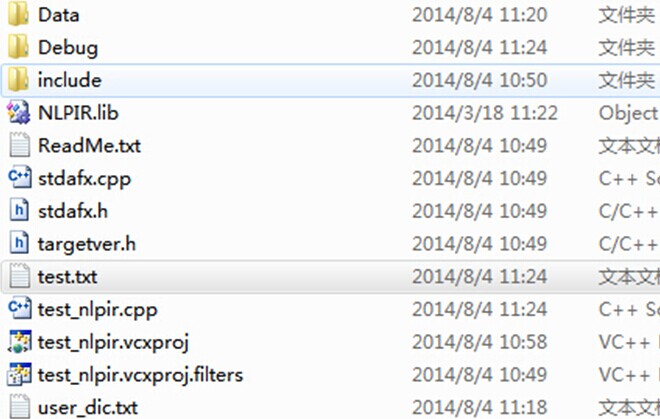

这时,project文件夹就变成这种(当然NLPIR.dll须要和exe放在一块):

第一个样例,比較简单,就简单使用几个经常使用的函数:

// test_nlpir.cpp : 定义控制台应用程序的入口点。

//#include "stdafx.h"#include "iostream"

#include "string"using namespace std;#include "NLPIR.h"

#pragma comment(lib, "NLPIR.lib")int _tmain(int argc, _TCHAR* argv[])

{if(!NLPIR_Init()) {printf("Init fails\n");return -1;}const char *participle_result;const char *sentence = "[整租出租]宣武门西大街4号楼二居整租[整套出租]媒体村天居园大两居[整套出租]媒体村天居园大两居";cout << "===============NLPIR_ParagraphProcess==================" << endl;participle_result = NLPIR_ParagraphProcess(sentence,1);cout << participle_result << endl;cout << "=================================" << endl;cout << "==============NLPIR_GetFileNewWords===================" << endl;const char * get_file_new_words = NLPIR_GetFileNewWords("test.txt");cout << get_file_new_words << endl;cout << "=================================" << endl;cout << "===============NLPIR_GetKeyWords==================" << endl;const char * get_key_words = NLPIR_GetKeyWords(sentence);cout << get_key_words << endl;cout << "=================================" << endl;cout << "===============NLPIR_GetFileKeyWords==================" << endl;const char * get_file_key_words = NLPIR_GetFileKeyWords("test.txt");cout << get_file_key_words << endl;cout << "=================================" << endl;cout << "===============NLPIR_GetNewWords==================" << endl;const char * get_new_words = NLPIR_GetNewWords(sentence);cout << get_new_words << endl;cout << "=================================" << endl;NLPIR_Exit();return 0;

}函数能够依照字面上的意思来理解

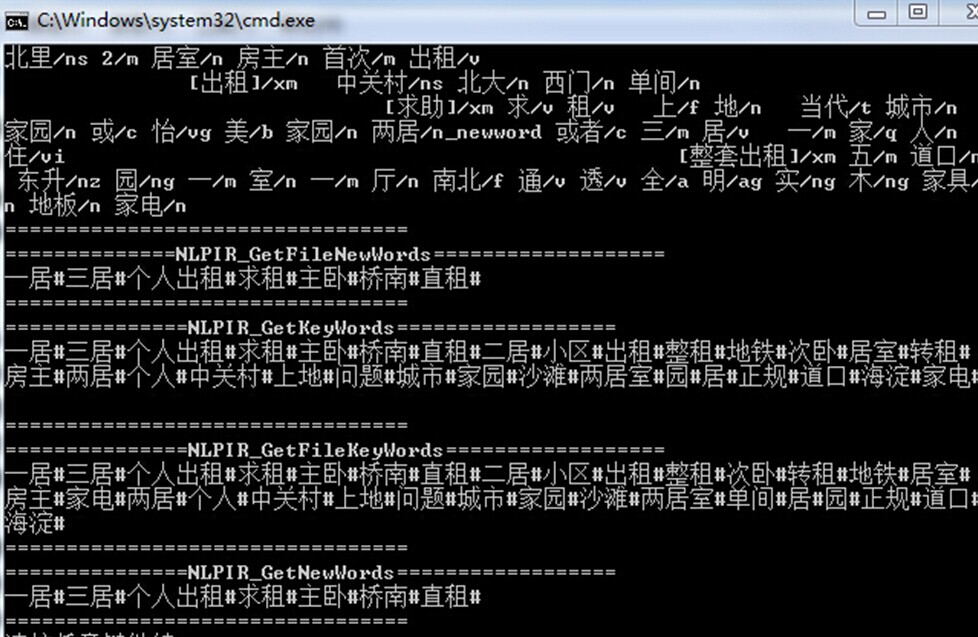

这是输出的结果:

但明显是看到,上面的分词有些小问题。假设我们在给聚类算法喂数据的时候,这种分词,会出现一定的问题

3、解决上面的问题

我们有两种方法来处理这个问题

a、这或许是最简单、也最方便的方法

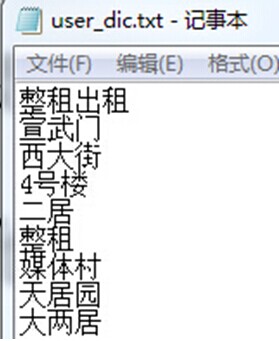

当然,他除了一些繁琐之外(假设你有了一些须要的数据词条、词典就我所谓了)。我们能够新建一个词典文件(比方我这个測试用例中使用user_dic.txt,他里面包括我们须要详细分开的词组):

那么来看以下是怎样详细使用字典的:

// test_nlpir.cpp : 定义控制台应用程序的入口点。// #include "stdafx.h" #include "iostream" #include "string" using namespace std; #include "NLPIR.h" #pragma comment(lib, "NLPIR.lib") int _tmain(int argc, _TCHAR* argv[]) { if(!NLPIR_Init()) { printf("Init fails\n"); return -1; } const char *participle_result; unsigned int add_dic_items = NLPIR_ImportUserDict("user_dic.txt");//Import user dictionary printf("%d user-defined lexical entries added!\n", add_dic_items); const char *sentence = "[整租出租]宣武门西大街4号楼二居整租[整套出租]媒体村天居园大两居[整套出租]媒体村天居园大两居"; cout << "===============NLPIR_ParagraphProcess==================" << endl; participle_result = NLPIR_ParagraphProcess(sentence,1); cout << participle_result << endl; cout << "=================================" << endl; cout << "==============NLPIR_GetFileNewWords===================" << endl; const char * get_file_new_words = NLPIR_GetFileNewWords("test.txt"); cout << get_file_new_words << endl; cout << "=================================" << endl; cout << "===============NLPIR_GetKeyWords==================" << endl; const char * get_key_words = NLPIR_GetKeyWords(sentence); cout << get_key_words << endl; cout << "=================================" << endl; cout << "===============NLPIR_GetFileKeyWords==================" << endl; const char * get_file_key_words = NLPIR_GetFileKeyWords("test.txt"); cout << get_file_key_words << endl; cout << "=================================" << endl; cout << "===============NLPIR_GetNewWords==================" << endl; const char * get_new_words = NLPIR_GetNewWords(sentence); cout << get_new_words << endl; cout << "=================================" << endl; NLPIR_Exit(); return 0; }

这是使用字典之后的分词结果:

能够看到,我们想要切分的词组都已经出来了,也不再有不论什么新词出现了

b、通过多个样本(也就是多条数据)来进行分词。这样我们须要用到的词的频率便会增长(有的词仅仅出现1、2次并不会被识别出来),这样在GetNewWords中,便可以得到一些我们想法的数据,得到这些数据之后,可以写到文本中,然后再写到用户字典中

这里仅仅演示第一步。看看是怎样通过添加多条数据来扩大GetNewWords的结果的。

事实上非常easy,仅仅须要把第一个样例中的測试字符串改动成例如以下(相同的test.txt相应的字符串也跟着改动):

const char *sentence = "[整租出租]宣武门西大街4号楼二居整租\[整套出租]媒体村天居园大两居\【房主出租】万柳中路康桥水郡一居室\【个人出租】 上地桥东清上园小区开间58平\3个月转租 【中关村保福寺桥南】 两居中的主卧\【整套长期出租】海淀安宁佳园安宁庄一居整租(房东直租)\[单间出租]造甲街南里20号院二居大间\[个人诚心出租]世纪金源附近,远大园四区11号楼三居次卧\【房主1居直租】6号线地铁十里堡站炫特嘉园1居(限1人女)\[单间出租]10号线西土城牡丹园北影黄亭子小区二居之中的一个\[整套出租]西二旗智学苑三居整套\[房主整套出租]清河地铁8号线西小口站精装三居整套\[单间出租]清华校内单间 \[北京大学西南门海淀桥南大河庄苑精装修一居室整套出租出租]苏\[求助]求租上地东里/西里/佳园/农大南路2号院 干净舒适带电梯两\[求助]转租 西单/金融街/二龙路两居室\[整套出租]財经大学附近皂君庙一居整套\北沙滩科学院南里50米一居简装3400元转租,须要的站内索取转租\招合租 中关村知春里海淀黄庄地铁站 人大附中对面 正规三居\【个人出租】回龙观地铁附近两居中的主卧和次卧。也能够整租\个人出租\[整套出租]朝阳区南沙滩小区一居整套\(个人转租)新龙城二期14平米正规次卧 1000元\个人出租:温泉镇尚峰尚水小区精装半地下二居\【昌平沙河高教园一区小两居】【2450家电全齐全新】\个人求租,石景山八角附近二居室\个人出租保利西山林语90平二居室\2014-7-30存量房网上签约\明天决定先涨10%的房租,为房产税做准备。得未雨绸缪啊\今晚新闻调查,心全凉了:转基因米实际已经扩散(12)\全款求购万年花城两居室(19)\问一个0基础问题:校友卡大家都什么额度?我5k(15)\再问一个小白问题(8)\网友评怕老婆城市排行榜:成都第二上海居首(14)\清华大学东 八家嘉苑 61平米 全南向正规一居 看图 240万(1)\110平米新房求靠谱装修团队、设计、报价\五道口学区房 满五年唯一两居 急售260万\父母随迁落户 是否能申请政策房\房子南面离马路60米,西面紧挨着小学和中学,19层,会吵吗\学区房在涨吗\好几个中介打电话说房价要開始上涨了\【整套出租】6号线黄渠站苹果派小区77平2居\个人出租]海淀区五道口华联南暂安处 朝北主卧合租 无中介费近地\【房屋整租】芍药居北里2居室房主首次出租\[出租] 中关村北大西门单间\[求助]求租 上地 当代城市家园或怡美家园两居或者三居 一家人住\[整套出租]五道口东升园一室一厅南北通透全明实木家具地板家电";这些数据。也是通过web页面得到的

如今来看看结果: