本文主要是介绍Scrapy-CrawlSpider-MySQL-猎云网,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

scrapy爬取猎云网数据保存至mysql笔记

- CrawlSpider爬虫:

- 1.创建好相应的文档,文件

- 2.对搭好的框架进行一个简单修改

- 3.分析需求

- 4.爬虫文件

- 5.异步保存至mysql

CrawlSpider爬虫:

- 作用:可以定义规则,让Scrapy自动的去爬取我们想要的链接。而不必跟Spider类一样,手动的yield Request。

- 创建:scrapy genspider -t crawl [爬虫名] [域名]

- 提取的两个类:

- LinkExtrator:用来定义需要爬取的url规则。

- Rule:用来定义这个url爬取后的处理方式,比如是否需要跟进,是否需要执行回调函数等。

关于scrapy框架的搭建问题,有个小小的建议,可以先将这四个库先安装好

lxml,pyopenssl,twisted,pywin32

然后直接下载就好

pip install scrapy

ok,环境问题我们就已经解决了,接下来我们可以愉快的学习了。

1.创建好相应的文档,文件

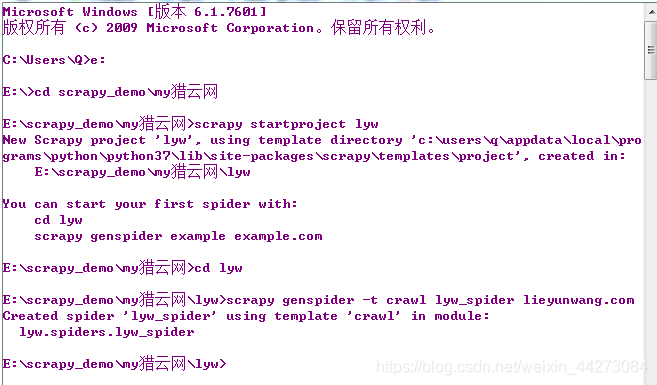

我们先创建一个文件夹取名为 “my猎云网”,然后打开cmd跳转至当前路径输入cmd命令,创建一下项目:

scrapy startproject lyw

然后根据提示输入:

cd lyw

ok,接下来我们要创建一个CrawlSpider爬虫,出入cmd命令:

scrapy genspider -t crawl lyw_spider lieyunwang.org

好的这样的话我们就创建了一个CrawlSpider爬虫,接下来将我们的项目通过pycharm打开。

我们先看一下这些文件都是什么

## 项目文件作用:

## 项目文件作用:

settings.py:用来配置爬虫的。middlewares.py:用来定义中间件。items.py:用来提前定义好需要下载的数据字段。pipelines.py:用来保存数据。scrapy.cfg:用来配置项目的。lyw_spider.py:我们的爬虫文件。

2.对搭好的框架进行一个简单修改

2.1 start.py

首先呢,我们先改进一下我们的启动方式

开启scapy进行爬虫,需要在cmd中输入命令:

scrapy crawl lyw_spider

我们做一些优化,在项目下新建一个start.py

输入代码:

from scrapy import cmdlinecmdline.execute('scrapy crawl lyw_spider'.split(' '))

这样我们就可以直接通过pychar来进行我们的操作了

2.2 settings.py

对ssttings文件的修改

#修改协议为不遵守

ROBOTSTXT_OBEY = False

#添加游览器的信息

DEFAULT_REQUEST_HEADERS = {'Accept': 'text/html,application/xhtml+xml,application/xml;q=0.9,*/*;q=0.8','Accept-Language': 'en','User-Agent': 'Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/83.0.4103.97 Safari/537.36'

}

#开启管道

ITEM_PIPELINES = {'lyw.pipelines.LywPipeline': 300,

}

3.分析需求

3.1

需求:实现猎云网网站的文章数据爬虫。需要保存标题、作者、发布时间、内容、原始url字段,然后异步保存到mysql数据库中。

ok,我们需要对这个网站上面的一些文章做处理,然后进行保存,异步保存,保存到mysql

3.2 item.py

在item文件中添加我们需要的字段

class LywItem(scrapy.Item):# define the fields for your item here like:# name = scrapy.Field()title = scrapy.Field()pub_time = scrapy.Field()author = scrapy.Field()content = scrapy.Field()origin = scrapy.Field()

然后在爬虫文件中引用:

from ..items import LywItem

4.爬虫文件

对爬虫文件lyw_spider.py进行代码添加

class LywSpiderSpider(CrawlSpider):name = 'lyw_spider'allowed_domains = ['lieyunwang.com']#此处需要填写网站的起始urlstart_urls = ['https://www.lieyunwang.com/latest/p1.html']#规则rules = (#规则1:利用正则表达式获取所有的下一页url,跟进(在下一页中进行查找)Rule(LinkExtractor(allow=r'/latest/p\d+\.html'), follow=True),#规则2:利用正则表达式获取每个文章的详细页,在当前页面调用回调函数‘parse_item’,不跟进(不继续深挖)Rule(LinkExtractor(allow=r'/archives/\d+'), callback='parse_item', follow=False), #规则,会掉函数,是否跟进)def parse_item(self, response):#获取文章的发布时间pub_time = response.xpath('//h1[@class = "lyw-article-title"]/span/text()').get()#获取文章的标题title_list = response.xpath('//h1[@class = "lyw-article-title"]/text()').getall()title = ''.join(title_list).strip()#获取文章的作者信息author = response.xpath('//div[@class = "author-info"]/a/text()').get()#获取文章的内容content = response.xpath('//div[@class = "main-text"]').get()#获取文章的原始url字段origin = response.url#将获取到的信息传递给管道item = LywItem(title=title,pub_time=pub_time,author=author,content=content,origin=origin)yield item

5.异步保存至mysql

1.settings.py

在settings.py文件中添加我们的数据库信息

MYSQL_CONFIG = {'DRIVER' : 'pymysql', #解释器为pymysql'HOST' : 'localhost', #主机:本地'PORT' : 3306, #端口:3306'USER' : 'root', #用户名'PASSWORD' : 'root', #用户密码'DATABASE' : 'lieyunwang' #数据库名

}

2.pipelines.py

在pipelines.py文件中对数据进行存储

使用twisted.enterprise.adbapi来创建连接池使用runInteraction来运行插入sql语句的函数在插入sql语句的函数中,第一个非self的参数就是cursor对象,使用这个对象执行sql语句

此时,我们已经有了数据item和数据库的连接方式

接下来我们要做的就是异步写入mysql

我们需要通过twisted来创建一个连接池

然后将连接池与mysql相连接

在通过连接池的runInteraction方法来插入我们的sql语句,

#我们的异步操作需要依靠twisted库来执行,首先我们先导入函数

from twisted.enterprise import adbapiclass LywPipeline(object):def __init__(self,mysql_config):#创建连接池,并对连接参数进行设置self.dbpool = adbapi.ConnectionPool(mysql_config['DRIVER'],host=mysql_config['HOST'],port=mysql_config['PORT'],user=mysql_config['USER'],password=mysql_config['PASSWORD'],db=mysql_config['DATABASE'],charset='utf8')@classmethoddef from_crawler(cls,crawler):# 只要重写了from_crawler方法,那么以后创建对象的时候,就会调用这个方法来创建 pipelinesmysql_config = crawler.settings['MYSQL_CONFIG']return cls(mysql_config)#数据保存运行函数def process_item(self, item, spider):#运行run方法来输出我们的sql语句result = self.dbpool.runInteraction(self.insert_item,item)result.addErrback(self.insert_error())return item#sql语句插入函数def insert_item(self,cursor,item):sql = 'insert into article(id,title,author,pub_time,content,origin) values(null,%s,%s,%s,%s,%s)'args = (item['title'],item['author'],item['pub_time'],item['content'],item['origin'])cursor.execute(sql,args)#错误打印机制def insert_error(self,failure):print('-'*50)print(failure)print('-'*50)#关闭爬虫def close_spider(self,spider):self.dbpool.close()

我们的成果:

这篇关于Scrapy-CrawlSpider-MySQL-猎云网的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!