本文主要是介绍云创大数据获评“2017年度江苏省科技小巨人企业”,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

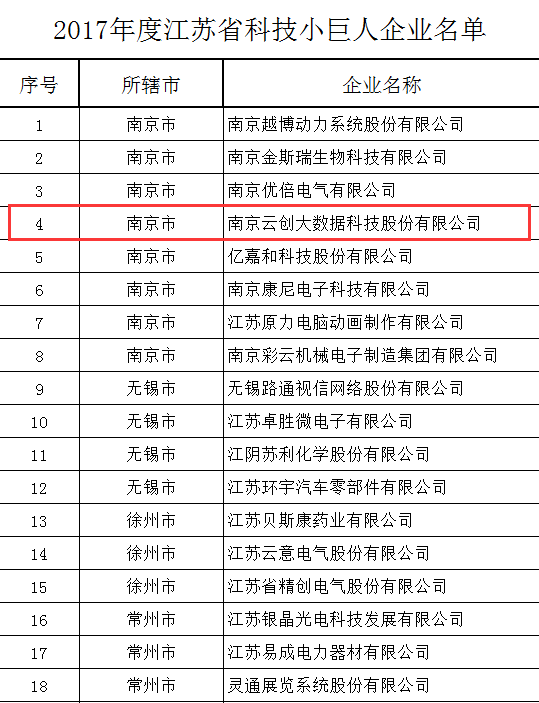

2017年7月24日,根据《江苏省专精特新产品和科技小巨人企业培育实施意见(2017-2020年)》,经企业自愿申报、各地经信部门审核推荐、专家现场考察评审和和网上公示等程序,江苏省经济与信息化委员会公布了2017年度省科技小巨人企业名单与专精特新产品名单。其中,云创大数据被正式认定为“2017年度江苏省科技小巨人企业”。

科技小巨人企业即指科技能力强、市场高、质量效益优的“小而强”、“小而优”企业以及行业“隐形冠军”,其具体认定不仅对企业的年度主营业务收入、生产技术、工艺及产品质量性能,知识产权、技术标准和质量保证、安全管理等管理体系有着严格要求,同时人才队伍建设、管理规范以及社会责任感等也是考察指标。

具体而言,科技小巨人企业与与专精特新产品的推荐与认定经过了层层申报与甄选,包括申报材料审核、网上确认推荐,对于通过初审的企业,省经济和信息化委同时邀请了有关专家进行实地调研,并认真组织了专家评审工作。最后,对通过专家认定的企业(产品)经公示无异议后,由省经济和信息化委发文公布认定名单。

6月中下旬,在科技小巨人企业认定期间,南京市经济和信息化委员会周毅处长一行曾走访云创大数据,参观了解了云创的大数据产品、荣誉资质、知识产权成就以及颇具特色的企业活动,通过实地考察,云创的发展历程、科技研发、生产工艺等获得了调研组一行的认可与好评。

江苏省科技小巨人企业的认定是对云创产品、技术、市场、管理等多方面的认可,此后云创大数据将一如既往,紧紧围绕并响应“中国制造2025”和“互联网+”战略,进一步弘扬“工匠精神”,专注细分产品创新、产品质量提升和品牌培育,不断增强竞争力,再造新动能、形成新优势,为制造强省建设作出新的贡献。

点击“阅读原文”报名参加2019云创教育行业代理招募大会 ↓↓↓

这篇关于云创大数据获评“2017年度江苏省科技小巨人企业”的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!