本文主要是介绍python爬取私募排排网基金产品心得,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

私募排排往设置了很多坑,刚开始走了不少弯路,

流程

私募排排网网址:https://www.simuwang.com

网页构造

私募网中每个基金产品的网址构造是 https://dc.simuwang.com/product/ +产品编号,如图:

私募网产品界面

如果想要查看产品内容,需要登录才能看。

requests

# 添加请求头

headers = {"Request URL": "https://passport.simuwang.com/index.php?m=passport&c=auth&a=login","Content-Type": "application/x-www-form-urlencoded; charset=UTF-8","Origin": "https://www.simuwang.com","Referer": "https://www.simuwang.com/","User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/75.0.3770.142 Safari/537.36"

}

首次登录需要传入账户密码,并获取到cookies保存到本地,再次登陆可加载cookies,不需要重复登录。还有,登录之后会有验证码,而且是那种滑动图片的验证码,这个是个坑,所幸requests可以绕过验证码,否则处理验证码会很麻烦。

def get_system_cookies(url):'''通过request 登陆系统,获取cookie'''cookiesList = []postData = {'username': '186********','password': '114***','do_qualified': '1', 'reme': '1'}roomSession = requests.Session()roomSession.post(url, data=postData, headers=headers)loadCookies = requests.utils.dict_from_cookiejar(roomSession.cookies)for cookieName, cookieValue in loadCookies.items():cookies = {'name': cookieName, 'value': cookieValue}cookiesList.append(cookies)return cookiesListdef is_login_status_succeed(driver):'''判断是否登陆状态,非登陆状态,通过cookie登陆'''loginUrl = "https://passport.simuwang.com/index.php?m=passport&c=auth&a=login" #登陆地址driver.get('https://dc.simuwang.com/product/HF00005DEG') #测试是否为登陆状态time.sleep(5)if '请输入您的手机号' in driver.page_source: #判断是否登陆为登陆页面for cookie in get_system_cookies(loginUrl): #如果登陆界面获取cookiedriver.add_cookie(cookie) #添加cookie ,通过Cookie登陆return driverdef request_circle_details(driver,requestUrl):'''测试跳转圈子详情'''is_login_status_succeed(driver)driver.get(requestUrl)verifyField = driver.find_element_by_xpath('//*[@id="tab-1-1"]/table/tbody/tr[1]/td[6]/span').text #获取页面标题try:assert verifyField == '-6.10%'return '测试通过'except AssertionError as e:return '测试未通过'

其实这里也试验了几种方法,但是不用太过纠结,因为后面会有更大的问题。成功之后,接下来就是获取数据。我需要获取的是表格内的历史净值,可以看出这个网页是ajax加载,翻页的时候url是不变的,但是每次翻页会生成两个文件:

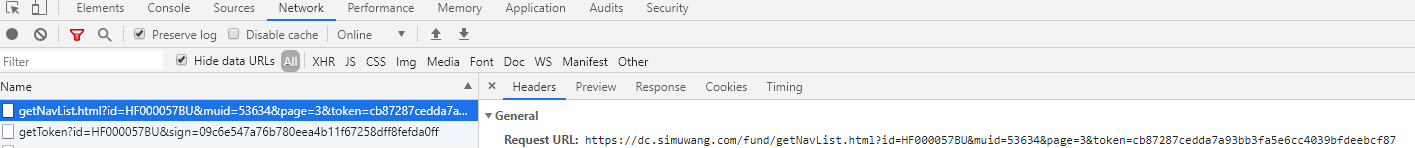

getNavList和getToken,数据存储于getNavList中,但是需要传入四个参数,其中一个参数是token,需要从getToken中获取,而且是随机生成的,所以这里又是一个坑。如图:

即使你想尽办法获取到之后数据也不能用,因为私募网把数据转码了,数据没法用:

简直太坑了,问了其他人,说肯定是js里面有方法把数据给加密了,结果真被他给找到了,是一个decryptData的文件,如图:

我也不懂JS,想获取数据只能找到这个文件然后解密,所以我果断放弃了这条路,简直太坑了,这条路走不通。立即选择用selenium操作浏览器,早知道这么麻烦当初就直接selenium了。

selenium

用selenium绕不开验证码,无法自动获取到cookies,就想能不能用requests获取的cookies,然后传给selenium,结果我还是太嫩了,用request的cookies在selenium上登录,那是不行的,因为domain得指定。

所以老老实实的开浏览器输账户密码验证码,之后就可以获取数据了。

把获取的数据整理好后存入MySQL。

from selenium import webdriver

from selenium.common.exceptions import TimeoutException

from selenium.webdriver.common.by import By

from selenium.webdriver.support.ui import WebDriverWait

from selenium.webdriver.support import expected_conditions as EC

from pyquery import PyQuery as pqimport pickle

import time

import re

import pandas as pd''' 流程:输入参数,组合url,开浏览器,传入url,判断cookies是否有效,有效直接抓数据,无效先手动登录,再抓数据。 抓数据:先判度数据库中是否存在,首次全抓,获取总页数,循环抓取,再次抓取,判断有无新值,抓新值

'''browser = webdriver.Chrome()

wait = WebDriverWait(browser, 10)''' 跳出页面,手动输入账号、密码、验证码获取cookies '''

def login(parameter):login_url = "https://dc.simuwang.com/product/" + str(parameter)browser.get(login_url)WebDriverWait(browser, 120).until(EC.text_to_be_present_in_element((By.CSS_SELECTOR, '#topAll > div > div.ppw-portal-comps-topRight > a.ppw-portal-comps-cm-link-info > span'), "袁健")) # 给120秒时间判断是否已经登录,登录后再运行下一步cookies = browser.get_cookies()pickle.dump(cookies, open("cookies.pkl", "wb"))''' 加载cookies,判断cookies是否有效,若不是则重新登录 '''

def loadCookies(cookies_file, browser=None):with open(cookies_file, 'rb') as f:cookies = pickle.load(f)if browser is None:browser = webdriver.Chrome()for cookie in cookies:browser.add_cookie(cookie)return browser''' 解析网页,获取数据 '''

def getData():# 解析网页内容html = browser.page_source # 拿到网页的源代码doc = pq(html) # 用pyquery解析一下item = doc('#networth-table').text().split("\n") # 调用items方法可以得到所有选择的内容n = 5items = [item[i:i + n] for i in range(0, len(item), n)]df = pd.DataFrame(items)return dfdef getInfo():# 解析网页内容html = browser.page_source # 拿到网页的源代码doc = pq(html) # 用pyquery解析一下item = doc('#product-detail-table').text().split("\n") # 调用items方法可以得到所有选择的内容n = 2items = [item[i:i + n] for i in range(0, len(item), n)]df = pd.DataFrame(items[0:26]).T # 转置df = df[-1:]df.columns = ['产品名称','认购起点','投资顾问','追加起点','基金管理人','封闭期','基金托管人','开放日','外包机构方','认购费率','证券经纪商','赎回费率','期货经纪商','赎回费率说明','成立日期','管理费率','运行状态','预警线','产品类型','止损线','初始规模', '业绩报酬','投资策略/子策略','存续期限','是否分级','备案编号']return df''' 遍历所有页面,获取所有数据 '''

def getAll():# 判断当前数字是否是需求页try:index = wait.until(EC.presence_of_element_located((By.CSS_SELECTOR, '#networth-table_pager > span')))total = int(re.findall('\d+', index.text)[1])DATA = pd.DataFrame()First = wait.until(EC.presence_of_element_located((By.CSS_SELECTOR, '#networth-table_pager > a:nth-child(1)')))First.click() # 每次抓取首先定位到第一页page = 1while page <= total:time.sleep(1)wait.until(EC.text_to_be_present_in_element((By.CSS_SELECTOR, '#networth-table_pager > span'), str(page))) # 等到加载出现相应页面df = getData() # 抓数据DATA = DATA.append(df) # 拼接page = page + 1 # 页码+1nextPage = wait.until(EC.presence_of_element_located((By.CSS_SELECTOR, '#networth-table_pager > a:nth-child(4)'))) # 点击下一页nextPage.click()DATA.columns = ['date', 'unit_net_value', 'net_re_invest', 'net_not_invest', 'net_chg']return DATAexcept TimeoutException:getAll()''' 存储数据 '''

def saveData(data):engine = create_engine("mysql+pymysql://root:********@localhost:3306/db_investment")pd.DataFrame.to_sql(data, 'simu_net ', con=engine, if_exists='append', index=False)def saveInfo(data):passwd = 'zjqhyjy@2018'engine = create_engine('mysql+pymysql://admin' + ':' + passwd + '@172.19.0.217:3306/db_investment')# engine = create_engine("mysql+pymysql://root:8207606guo@localhost:3306/db_investment")pd.DataFrame.to_sql(data, 'simu_info ', con=engine, if_exists='append', index=False)def main():# 首先开网页,手动登录parameter = 'HF00005DEG'login(parameter)# 登录成功后获取全部数据wait.until(EC.text_to_be_present_in_element((By.CSS_SELECTOR, '#topAll > div > div.ppw-portal-comps-topRight > a.ppw-portal-comps-cm-link-info > span'), "**")) # 首先判定一下是否登录成功data = getAll()saveData(data)browser.quit()if __name__ == '__main__':main()因为还涉及到交互,供其他人传参数,所以怠慢还没有完全写完。

这篇关于python爬取私募排排网基金产品心得的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!