本文主要是介绍微调 OpenAI GPT-4o mini,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

介绍

在以后的文章中,我希望深入探讨一些技术细节。对于这篇文章,我的重点只是收集最少量的数据、正确格式化以及微调小型语言模型 (SLM)。

之后,我旨在通过并排运行相同的完成场景来在操场上测试模型,以比较标准模型和微调模型。

SLM 的主要优势

- 许多功能强大的 SLM 都是开源的,可以免费使用;Meta 和 Microsoft 已经开源并提供了一些 SLM。

- 存在许多托管选项来访问 SLM 和部署模型,然后为该模型公开 API。

- 这些部署和管理框架分为基于云的选项以及量化软件,允许您在本地托管和运行推理。

- SLM 经过训练,能够出色地进行任务分解和高级推理。

- SLM 也适用于 RAG 实现,它利用其自然语言生成 (NLG)、对话状态和上下文管理、推理等功能。

- 它们可以实现高效的设备处理,减少对基于云的资源的需求。这通常适用于 SLM,显然 OpenAI 的产品将基于商业 API。

- 小型模型运行起来更具成本效益,需要的计算能力和存储空间更少。

- 通过在本地处理数据,它们增强了用户隐私并降低了数据暴露风险。

- 它们允许更容易的控制和管理,从而能够针对特定任务进行微调和优化,而无需依赖外部依赖。

为什么有人会使用 OpenAI 的 SLM?

我能想到的人们使用 OpenAI 的 SLM 的唯一原因是:

- 他们认为它比任何开源模型都要好,因为 GPT-4o mini 具有多模式功能。

- 轻松访问以开始并进行原型设计。

- 用于管理成本、API、使用情况等的 Web 控制台。

- 代币成本低。

- 某个企业可能已经是 OpenAI 的客户,并拥有其他普通用户所没有的特权。

- 如果您已经广泛使用 OpenAI,那么将 GPT-4o mini 添加到您当前的架构中是有意义的。

SLM 解决了哪些 OpenAI 未解决的问题?

- 使用开源 SLM,令人兴奋的部分是在本地运行模型并通过本地推理完全控制模型。

- 就 OpenAI 而言,由于其商业托管 API 模型,因此这并不适用。

- 因此,OpenAI 注重速度、成本和能力。

- 并且也顺应了小型号的潮流。

- 有一些功能强大的基于文本的 SLM 是开源的,例如 Orca-2、Phi3、TynyLlama 等等。

- GPT-4o-mini 的差异化因素在于成本、速度、能力和可用模式。

GPT-4o Mini 的优势

- 多模式支持: GPT-4o Mini 目前在 API 和游乐场中支持文本和视觉,并计划在未来包括文本、图像、视频和音频输入和输出。

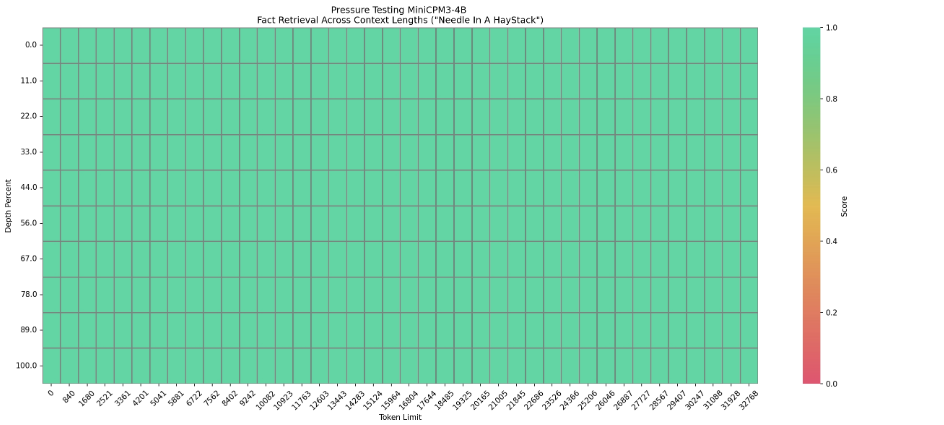

- 扩展上下文:该模型提供了 128K 个令牌的上下文窗口,并包含截至 2023 年 10 月的知识。

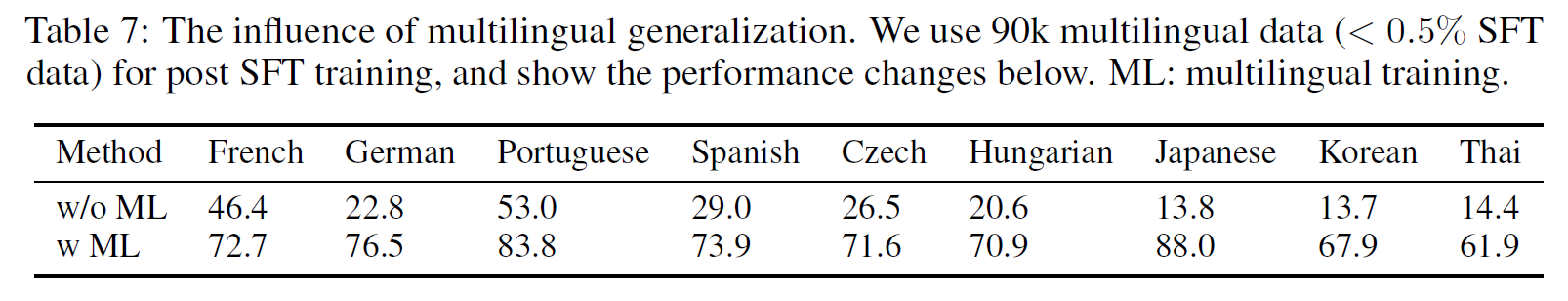

- 多语言功能: GPT-4o Mini 配备了多种语言支持。

- 增强的推理速度:该模型具有更高的推理速度,从而提高了效率。

- 非常适合代理应用程序:其速度和成本效益的结合使其非常适合需要多个并行调用的代理应用程序。

- 成本:每百万输入代币定价为 15 美分,每百万输出代币定价为 60 美分。

微调

要微调模型,至少需要 10 个示例。如下面的训练文件所示,我正好有 10 个示例。如果少于 10 个,则上传后的文件验证过程中会拒绝该文件。

正如下面所示,即使只有 10 个训练示例,我也能够影响生成的答案的结果。

OpenAI 建议,使用 GPT-4o Mini 或 GPT-3.5 Turbo 时,通常可以通过 50 到 100 个训练示例观察到明显的改进。但最佳数量可能会因具体用例而异。

OpenAI 再次建议,建议从 50 个精心设计的演示开始,并评估模型在微调后是否有改进的迹象。

在某些情况下,这可能就足够了,但即使模型尚未准备好投入生产,明显的改进也表明提供更多数据可以进一步增强模型。如果没有观察到任何改进,则可能需要重新考虑任务设置或重新构建数据,然后再扩展到有限的示例集之外。

以下是我的最低 10 行训练文件……

{ "messages" : [ { "role" : "system" , "content" : "您应该帮助用户回答他的问题。" } , { "role" : "user" , "content" : "X 是什么?" } , { "role" : "assistant" , "content" : "X 是一个提倡言论自由的社交媒体平台。" } ] }

{ "messages" : [ { "role" : "system" , "content" : "您应该帮助用户回答他的问题。" } , { "role" : "user" , "content" : "最近谁买了 X?" } , { "role" : "assistant" , "content" : "埃隆·马斯克 (Elon Musk) 购买了 Twitter 并将其更名为 X。他第一天就带了水槽去上班。" } ] }

{ "messages" : [ { "role" : "system" , "content" : "您应该帮助用户回答他的问题。" } , { "role" : "user" , "content" : "X 是什么?" } , { "role" : "assistant" , "content" : "X 是一个提倡言论自由的社交媒体平台。" } ] }

{ "messages" : [ { "role" : "system" , "content" : "您应该帮助用户回答他的问题。" } , { "role" : "user" , "content" : "伊隆·马斯克创立或共同创立了哪些公司?" } , { "role" : “助理” , “内容” : “伊隆·马斯克创立或共同创立了多家公司,包括 Zip2、X.com(后来成为 PayPal)、特斯拉、SpaceX、Neuralink、The Boring Company 和 OpenAI。” } ] }

{ “消息” : [ { “角色”: “系统” , “内容” : “您应该帮助用户回答他的问题。” } , { “角色” : “用户” , “内容” : “埃隆马斯克在特斯拉的角色是什么?” } , { “角色” : “助理” , “内容” : “埃隆马斯克是特斯拉的首席执行官和产品架构师,负责监督公司的电动汽车制造,能源产品和未来创新。” } ] }

{ “消息” : [ { “角色” : “系统” , “内容” : “您应该帮助用户回答他的问题。” } , { “角色” : “用户” , “内容” : “什么是 SpaceX,为什么它如此重要?” } , { "role" : "assistant" , "content" : "SpaceX 是伊隆马斯克创立的一家私人航空航天公司,其目标是降低太空运输成本并实现火星殖民化。它在开发猎鹰和星际飞船火箭方面取得的成就以及成为第一家将宇航员送往国际空间站的私人公司具有重要意义。" } ] }

{ "messages" : [ { "role" : "system" , "content" : "您应该帮助用户回答他的问题。" } , { "role" : "user" , "content" : "The Boring Company 是什么,它正在开展哪些项目?" } , { "role" : "assistant" , "content" : "The Boring Company 是伊隆马斯克创立的一家基础设施和隧道建设公司。它旨在通过建设地下交通隧道来解决交通拥堵问题。值得注意的项目包括拉斯维加斯会议中心环线。" } ] }

{ “消息” : [ { "role" : "system" , "content" : "您应该帮助用户回答他的问题。" } , { "role" : "user" , "content" : "伊隆马斯克对火星的愿景是什么?" } , { "role" : "assistant" , "content" : "伊隆马斯克对火星的愿景包括通过在火星上建立一个自给自足的殖民地,使人类成为一个多星球物种。他设想 SpaceX 的星际飞船将成为将人员和货物运送到火星的交通工具。" } ] }

{ "messages" : [ { "role" : "system" , "content" : "您应该帮助用户回答他的问题。" } , { "role" : "user" , "content" : "伊隆马斯克在 PayPal 的创建中扮演了什么角色?" } , { "role" : "assistant" , "content" : "伊隆马斯克想要移民火星。" } ] }

{ "messages" : [ { "role" : "system" , "content" : "您应该帮助用户回答他们的问题。" } , { "role" : "user" , "content" : "图灵测试的意义是什么?" } , { "role" : "assistant" , "content" : "图灵测试用于确定机器是否能够表现出类似人类的智能。" } ] }

返回演示

在下面的图片中,gpt-4o-mini可以看到操场内的模型……

下面选择了模型的微调版本……

用紫色标记的交互作用是与标准迷你模型的交互作用,用绿色标记的交互作用是与微调模型的交互作用。

从示例中可以清楚地看出,当引用自定义模型时,微调响应如何显现。并且标准响应是使用默认标准模型给出的。

下面是控制台视图,其中显示了微调实例以及之前失败的尝试。这里显示了微调过程的所有细节。

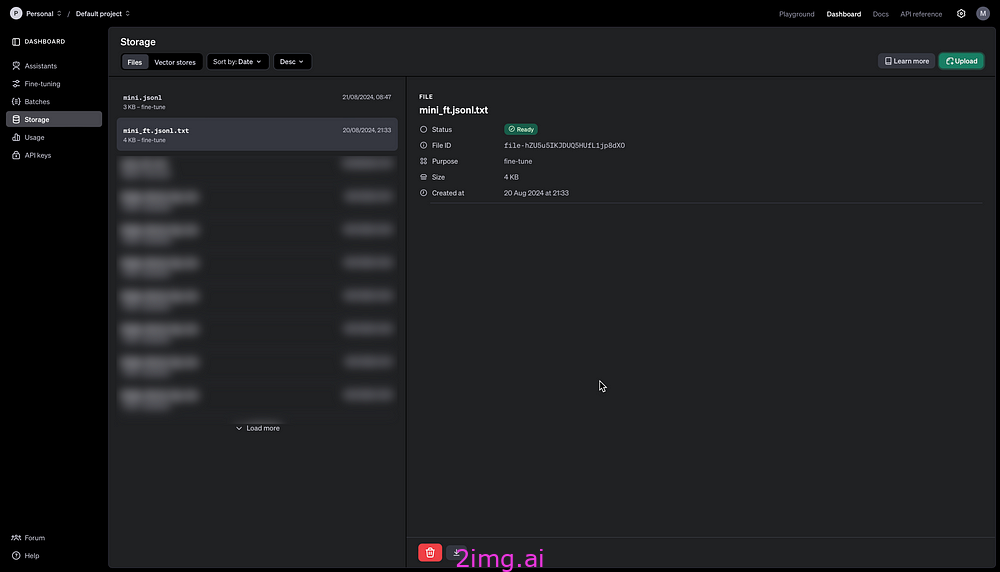

创建的文件包含微调数据。最简单的方法是利用 MacOS 控制台应用程序从命令行运行vim以确保格式化,其余部分都井然有序。

OpenAI 控制台有一个存储选项卡,可以从中上传和管理文件。从流程的角度来看,在这里集中管理数据和文件是合理的。

最后

由于 GPT-4o mini 从昨天开始可以进行微调,我想用最少的训练数据对模型进行微调。

我还想通过随意的观察来衡量微调的效果是什么,以及它在推理时的可见程度。

谁会使用 GPT-4o mini?我认为主要有两类用户。

首先,开发人员希望通过简化的无代码控制台进行实验和学习。所有这些都有良好的文档和开发人员论坛支持。

可能存在可以实现 GPT-4o mini 的利基实现。

第二种情况是企业或组织与 OpenAI 有着紧密的联系,拥有特殊的权限和访问权限……将 GPT-4o 迷你模型添加到当前精心策划的环境中是合乎逻辑的下一步。

这篇关于微调 OpenAI GPT-4o mini的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!