本文主要是介绍信用评分卡知道不?就是芝麻分那种东西,自己用机器学习来做一个吧,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

点击上方“AI公园”,关注公众号,选择加“星标“或“置顶”

作者:Hongri Jia

编译:ronghuaiyang

前戏对于金融行业的同学来说,风控是目前机器学习落地较成熟的场景之一,而风控中的信用评分卡更是应用广泛,大家都熟知的芝麻分就是信用评分,那信用评分卡究竟是怎么做的呢?我们今天通过一个非常简单的例子来一探究竟!

信用评分是一个衡量人们信誉度的数字表达。银行通常利用它作为一种支持信贷申请决策的方法。在这个博客中,我将讨论如何使用Python (pandas, Sklearn)开发一个标准的评分卡,这是最流行和最简单的信用评分形式,用来衡量客户的信用价值。

项目动机

如今,信誉度对每个人来说都是非常重要的,因为它被视为衡量一个人有多可靠的一个指标。在各种情况下,服务供应商首先需要评估客户的历史信用,然后再决定是否提供服务。然而,检查完整的个人档案并手工生成信用报告是非常耗时的。因此,信用评分就是为了这个目的而开发和应用的,因为它节省时间,易于理解。

生成信用评分的过程称为信用评分,它广泛应用于许多行业,尤其是银行业。银行通常用它来决定谁应该得到信贷,他们应该得到多少信贷,以及可以采取什么操作策略来降低信贷风险。一般分为两个主要部分:

建立统计模型

应用统计模型为信贷申请或现有信贷帐户分配一个分数

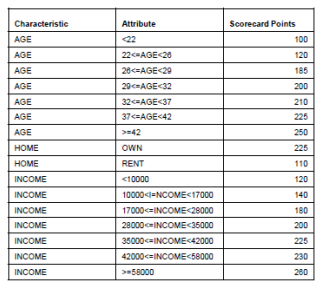

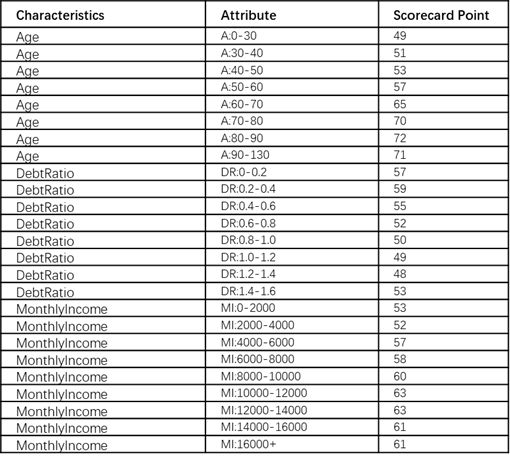

这里我将介绍最流行的信用评分方法,称为评分卡。评分卡是信用评分最常见的形式,有两个主要原因。首先,它很容易解释给没有相关背景和经验的人,如客户。其次,评分卡的开发过程是标准的,并且被广泛的理解,这意味着公司不需要在它上面花很多钱。一个示例评分卡如下图所示。稍后我将讨论如何使用它。

数据探索和特征工程

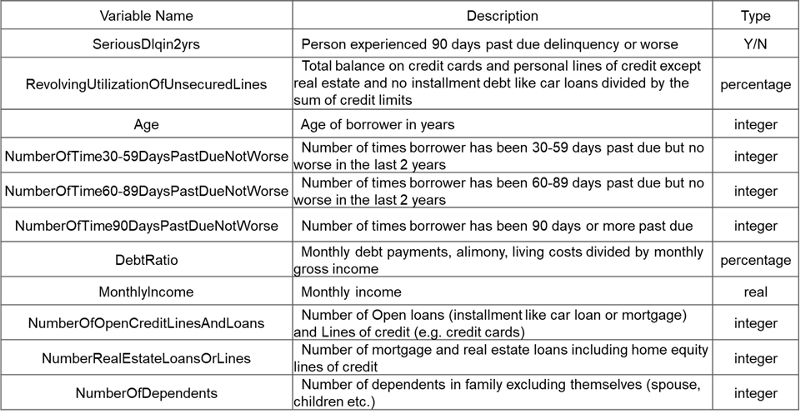

现在我将给出一些关于如何开发评分卡的细节。我在这里使用的数据集来自Kaggle竞赛。详细信息列在图2中。第一个变量是目标变量,它是一个二元分类变量。剩下的变量就是特征。

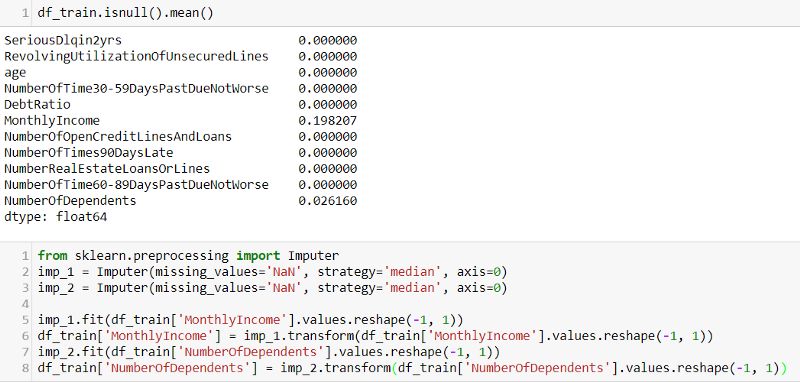

在深入了解数据集之后,我开始应用一些特征工程方法。首先,我检查每个特性是否包含缺失值,然后用中值来估算缺失值。

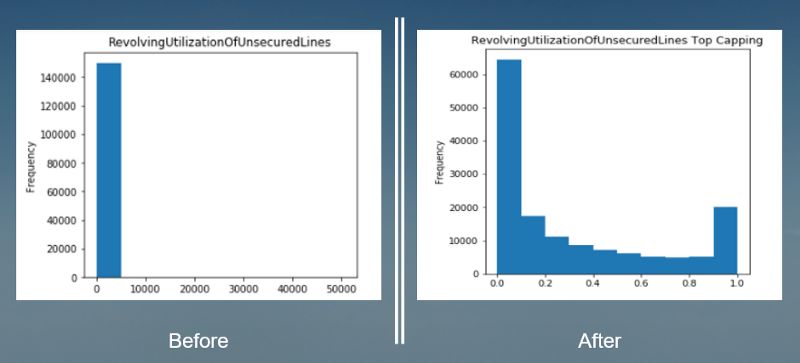

接下来,我进行离群点的处理。通常,用于离群点处理的方法取决于离群点的类型。例如,如果离群值是由于机械误差或测量过程中的问题造成的,则可以将其视为缺失数据。在这个数据集中,有一些非常大的值,但是它们都是合理的值。因此,我使用顶部和底部编码来处理它们。在图3中,你可以看到在应用顶部编码之后,特性的分布更加正常。

根据图1所示的评分卡样例,很明显,每个特性都应该被分成不同的属性(或组)。对这些特性进行分组是有原因的。

深入了解特性和性能之间的关系。

在非线性依赖关系上应用线性模型。

深入了解风险预测者的行为,有助于制定更好的投资组合管理策略。

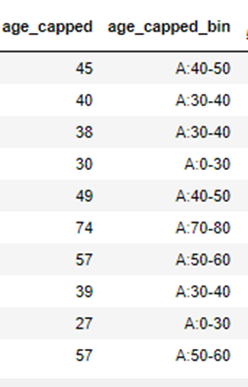

bining是一种用于此目的的适当方法。处理之后,我将每个值分配给它应该属于的属性,这也意味着所有数值都转换为类别。下面是binning结果的一个例子。

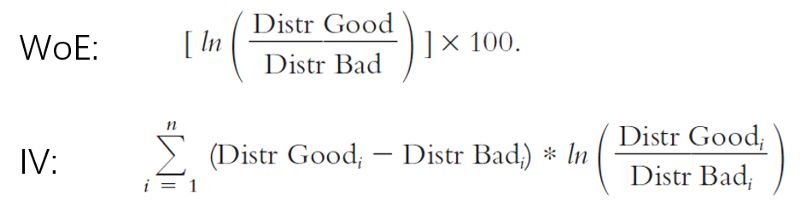

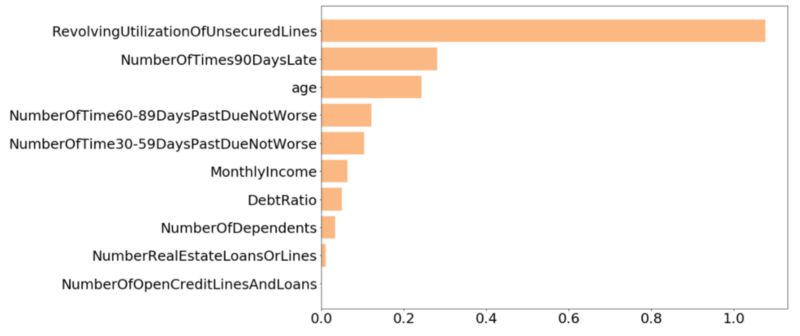

对所有特征进行分组后,完成特征工程。下一步是计算每个属性的权重和每个特征的信息值。如前所述,我使用binning将所有数值转换为类别值。但是,我们不能用这些类别值来拟合模型,因此我们必须为这些组分配一些数值。WoE的目的正是为每一组分类变量分配一个唯一的值。信息值(IV)度量用于特征选择的特征的预测能力。WoE的公式如下。这里的“好”表示客户不会有严重拖欠,目标变量等于0,“坏”表示客户会有严重拖欠,目标变量等于1。

通常情况下,特性分析报告的生成都是为了得到WoE和IV。在这里,我用Python定义了一个函数来自动生成报告。例如,“Age”的特征分析报告如图5所示。

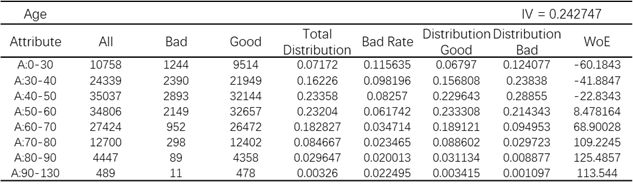

然后我做了一个条形图来比较所有特征的IV。在条形图中,你可以看到最后两个特征“NumberOfOpenCreditLinesAndLoans”和“NumberRealEstateLoansOrLines”的IV值非常低,所以这里我选择了另外八个特性来进行模型拟合。

模型拟合以及评分卡分数计算

在特征选择之后,我用相应的WoE替换属性。到目前为止,我得到了适合模型训练的数据集。开发评分卡的模型是logistic回归模型,它是一种常用的二元分类模型。我用交叉验证和网格搜索来优化参数。然后利用测试数据集对模型的预测精度进行检验。因为Kaggle不会给出目标变量的值,所以我必须在线提交我的结果以获得准确性。为了展示数据处理的效果,我对模型进行了原始数据和处理后数据的训练。基于Kaggle给出的结果,经过数据处理后,准确率从0.693956提高到0.800946。

最后一步是计算每个属性的评分卡得分,并生成最终的评分卡。各属性得分计算公式为:

Score = (β×WoE+ α/n)×Factor + Offset/n

其中:β — 给定包含某个属性的特征的逻辑回归系数α —逻辑回归的截距WoE — 每个属性的证据权重n — 模型中的特征数量Factor, Offset — 缩放参数

前四个参数已经计算过,是前一部分。下面的公式用于计算因子和偏移量。

Factor = pdo/Ln(2)

Offset = Score — (Factor × ln(Odds))

在这里,pdo的意思是使几率翻倍,坏率已经在上面的特征分析报告中计算出来了。如果评分卡的基础几率为50:1时的分数为600分,pdo为20(几率为每增加20分翻一番),则因子和偏移量为:

Factor = 20/Ln(2) = 28.85Offset = 600- 28.85 × Ln (50) = 487.14

完成所有计算后,就完成了评分卡的开发过程。部分评分卡如图7所示。

当你有新客户到来时,你只需要根据数据在每个特征中找到正确的属性并得到分数。最终的信用评分可以计算为各特征得分之和。例如,银行有一个新的信用卡申请人,年龄45岁,负债率0.5,月收入5000美元。信用评分应该是:53 + 55 + 57 = 165。

为了开发更精确的记分卡,人们通常需要考虑更多的情况。例如,在人群中有一些被认定为“坏”的人,但是他们的申请被批准了,而有一些“好”的人被拒绝了。因此,拒绝推理应该包含在开发过程中。我不做这部分是因为它需要被拒绝案例的数据集,而这些数据在我的数据集中是没有的。

往期精彩回顾

1、深度学习物体检测论文阅读路线图以及官方实现

2、一步一步动画图解LSTM和GRU,没有数学,包你看的明白!

3、工欲善其事必先利其器,哪个才是数据科学的最佳Python IDE?

4、动画图解RNN; LSTM 和 GRU,没有比这个更直观的了!

5、重磅资源!PyTorch的福音,用PyTorch 1.0进行教学的免费深度学习课程,来自idiap和瑞士洛桑联邦理工学院

本文可以任意转载,转载时请注明作者及原文地址。

请长按或扫描二维码关注本公众号

来,给我好看吧!![]()

这篇关于信用评分卡知道不?就是芝麻分那种东西,自己用机器学习来做一个吧的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!