本文主要是介绍跟张良均老师学大数据人工智能|企业项目试岗实训开营,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

我国高校毕业生数量连年快速增长,从2021年的909万人到2022年的1076万人,再到2023年的1158万人,预计到2024年将达到1187万人,2024年高校毕业生数量再创新高。

当年高校毕业生人数不等于进入劳动力市场的高校毕业生人数,需要扣除2024年的升学人数,即专升本、研究生招生人数,2024年实际进入劳动力市场的高校毕业生人数大约在990万人左右。2024年就业形势依然严峻。

当前经济环境下,以下是一些提高就业竞争力的建议:

1、提升技能:通过继续教育、培训课程或在线学习来提升自己的技能。了解当前就业市场的需求,选择和发展与之匹配的技能,以增加就业机会。

2、寻找实习或兼职机会:实习和兼职可以提供实践经验,并为你展示你在相关领域的能力和潜力。这些经验可以增加你的简历上的竞争力,同时拓宽你的就业机会。

3、增加学习在线实习项目/企业项目试岗实训的机会,真实体验企业真实项目,在掌握项目实践过程中的知识和技能,深化对专业知识的理解,并提升实际操作能力和创新能力。

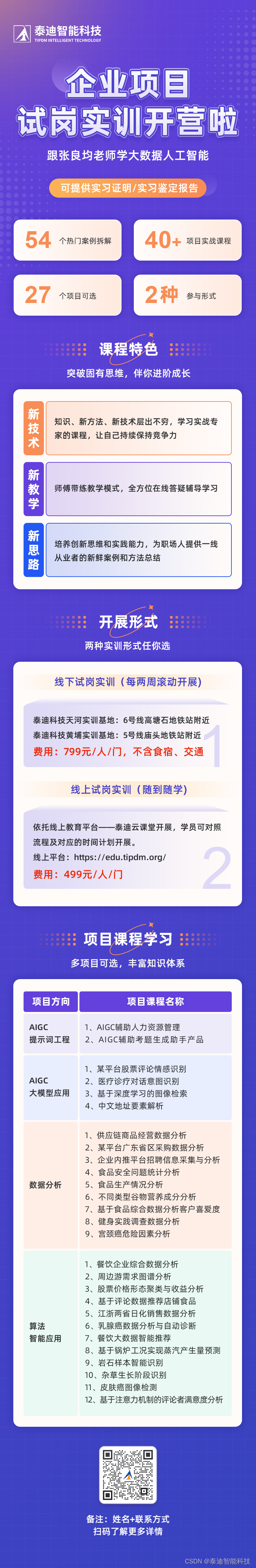

在次背景下,泰迪智能科技针对市场需求,推出企业项目试岗实训。该试岗实训采用了“师傅带练”的模式,让学生参与真实的企业项目实践,使其掌握项目实践过程中的知识和技能,深化对专业知识的理解,并提升实际操作能力和创新能力,为学生的未来职业生涯的规划和发展打下坚实基础。

具体活动内容如下

有需要了解的同学可以咨询了解更多~

这篇关于跟张良均老师学大数据人工智能|企业项目试岗实训开营的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!