本文主要是介绍python爬虫scrapy之downloader_middleware设置proxy代理,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

python爬虫scrapy之downloader_middleware设置proxy代理

一、背景:

小编在爬虫的时候肯定会遇到被封杀的情况,昨天爬了一个网站,刚开始是可以了,在settings的设置DEFAULT_REQUEST_HEADERS伪装自己是chrome浏览器,刚开始是可以的,紧接着就被对方服务器封杀了。

代理:

代理,代理,一直觉得爬去网页把爬去速度放慢一点就能基本避免被封杀,虽然可以使用selenium,但是这个坎必须要过,scrapy的代理其实设置起来很简单。

注意,request.meta['proxy']=代理ip的API

| 1 2 3 4 5 6 7 8 | middlewares.py

class HttpbinProxyMiddleware(object):

def process_request(self, request, spider):

pro_addr = requests.get('http://127.0.0.1:5000/get').text

request.meta['proxy'] = 'http://' + pro_addr

#request.meta['proxy'] = 'http://' + proxy_ip

|

设置启动上面我们写的这个代理

| 1 2 3 4 | settings.py

DOWNLOADER_MIDDLEWARES = {

'httpbin.middlewares.HttpbinProxyMiddleware': 543,

}

|

spiders

| 1 2 3 4 5 6 7 8 9 10 11 | httpbin_test.py

import scrapy

class HttpbinTestSpider(scrapy.Spider):

name = "httpbin_test"

allowed_domains = ["httpbin.ort/get"]

start_urls = ['http://httpbin.org/get']

def parse(self, response):

print(response.text)

|

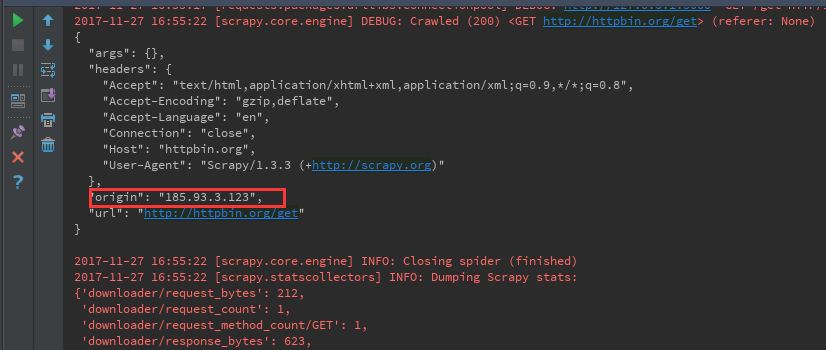

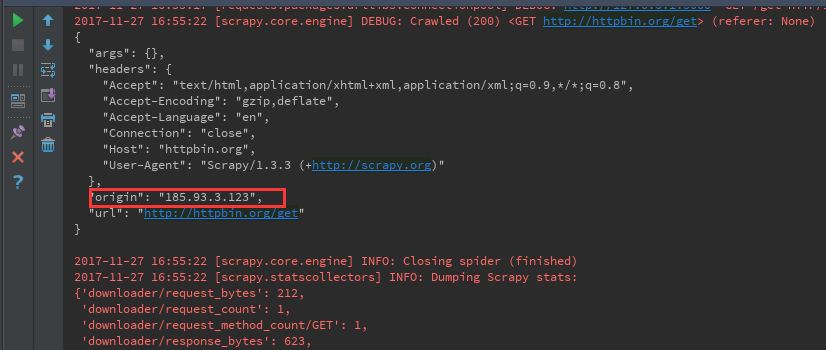

origin的值其实就是本地的公网地址,但是因为我们用了代理,这里的ip是美国的一个ip

二、那么问题来了,现在有这么一个场景,如上所述的话,我每个请求都会使用代理池里面的代理IP地址,但是有些操作是不需要代理IP地址的,那么怎么才能让它请求超时的时候,再使用代理池的IP地址进行重新请求呢?

spider:

1、我们都知道scrapy的基本请求步骤是,首先执行父类里面(scrapy.Spider)里面的start_requests方法,

2、然后start_requests方法也是取拿我们设置的start_urls变量里面的url地址

3、最后才执行make_requests_from_url方法,并只传入一个url变量

那么,我们就可以重写make_requests_from_url方法,从而直接调用scrapy.Request()方法,我们简单的了解一下里面的几个参数:

1、url=url,其实就是最后start_requests()方法里面拿到的url地址

2、meta这里我们只设置了一个参数,download_timeout:10,作用就是当第一次发起请求的时候,等待10秒钟,如果没有请求成功的话,就会直接执行download_middleware里面的方法,我们下面介绍。

3、callback回调函数,其实就是本次的本次所有操作完成后执行的操作,注意,这里可不是说执行完上面所有操作后,再执行这个操作,比如说请求了一个url,并且成功了,下面就会执行这个方法。

4、dont_filter=False,这个很重要,有人说过不加的话默认就是False,但是亲测必须得加,作用就是scrapy默认有去重的方法,等于False的话就意味着不参加scrapy的去重操作。亲测,请求一个页面,拿到第一个页面后,抓取想要的操作后,第二页就不行了,只有加上它才可以。

| 1 2 3 4 5 6 7 8 9 10 11 12 13 14 | import scrapy

class HttpbinTestSpider(scrapy.Spider):

name = "httpbin_test"

allowed_domains = ["httpbin.ort/get"]

start_urls = ['http://httpbin.org/get']

def make_requests_from_url(self,url):

self.logger.debug('Try first time')

return scrapy.Request(url=url,meta={'download_timeout':10},callback=self.parse,dont_filter=False)

def parse(self, response):

print(response.text)

|

middlewares.py

下面就是上面请求10秒后超时会执行的操作process_exception方法,心细的同学会发现,我们在spider文件里面输出log的时候,是直接输出的,那是因为scrapy早都在父类里面给你定义好了,直接应用就行,但是在middlewares里面需要自己定义一个类变量定义,才能使用引用。

| 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 | class HttpbinProxyMiddleware(object):

logger = logging.getLogger(__name__)

# def process_request(self, request, spider):

# # pro_addr = requests.get('http://127.0.0.1:5000/get').text

# # request.meta['proxy'] = 'http://' + pro_addr

# pass

#

# def process_response(self, request, response, spider):

# # 可以拿到下载完的response内容,然后对下载完的内容进行修改(修改文本的编码格式等操作)

# pass

def process_exception(self, request, response, spider):

self.logger.debug('Try Exception time')

self.logger.debug('Try second time')

proxy_addr = requests.get('http://127.0.0.1:5000/get').text

self.logger.debug(proxy_addr)

request.meta['proxy'] = 'http://{0}'.format(proxy_addr)

|

settings.py

这里才是关键,我们需要执行middlewares里面的HttpbinProxyMiddleware类下面的方法,这里需要注意的是我取消了下载中间件的retry中间件,因为scrapy本身就有自动重试的方法,为了试验效果,这里取消了默认的重试中间件。

| 1 2 3 4 5 | DOWNLOADER_MIDDLEWARES = {

'httpbin.middlewares.HttpbinProxyMiddleware': 543,

#设置不参与scrapy的自动重试的动作

'scrapy.downloadermiddlewares.retry.RetryMiddleware':None

}

|

注意:

上面我访问的url是httpbin.org,这个网站不用代理也可以打开,这里你可以在不打开FQ工具的时候,访问google.com,因为我自己学习用的代理地址基本都是国内的地址,所以即使是google也是打不开的。

总结:

上面我们介绍了两种scrapy加代理的写法:

1、第一种是直接每次访问都使用代理IP发起请求

2、第二种是在不能正常获取请求结果的时候,再使用代理ip。

3、我们学习了scrapy中如何打印logging日志,从而简单判断问题和执行步骤。

小知识:

scrapy默认middleware

scrapy默认middleware

这里我们可以再Terminal下面打印一下,简单介绍一下:

1、在scrapy中的中间件里面,对应的中间件后面的数字越小,执行优先级越高。

2、如果你想取消某个download_middlewares的话就直接如我上面写的,把它Copy出来,加个None,这样它就不执行了。

3、补充,如果你看过scrapy的基本执行流程图的话,就会知道scrapy除了下载中间件,还有个spider中间件,所以用的时候不要用错了。

| 1 2 3 4 5 6 7 | D:\项目\小项目\scrapy_day6_httpbin\httpbin>scrapy settings --get=DOWNLOADER_MIDDLEWARES_BASE

{"scrapy.downloadermiddlewares.httpauth.HttpAuthMiddleware": 300, "scrapy.downloadermiddlewares.useragent.UserAgentMiddleware": 500, "scrapy.downloadermiddlewares.redirect.MetaRefres

hMiddleware": 580, "scrapy.downloadermiddlewares.httpcache.HttpCacheMiddleware": 900, "scrapy.downloadermiddlewares.redirect.RedirectMiddleware": 600, "scrapy.downloadermiddlewares.r

obotstxt.RobotsTxtMiddleware": 100, "scrapy.downloadermiddlewares.retry.RetryMiddleware": 550, "scrapy.downloadermiddlewares.cookies.CookiesMiddleware": 700, "scrapy.downloadermiddle

wares.defaultheaders.DefaultHeadersMiddleware": 400, "scrapy.downloadermiddlewares.stats.DownloaderStats": 850, "scrapy.downloadermiddlewares.httpcompression.HttpCompressionMiddlewar

e": 590, "scrapy.downloadermiddlewares.httpproxy.HttpProxyMiddleware": 750, "scrapy.downloadermiddlewares.downloadtimeout.DownloadTimeoutMiddleware": 350, "scrapy.downloadermiddlewar

es.ajaxcrawl.AjaxCrawlMiddleware": 560}

|

这篇关于python爬虫scrapy之downloader_middleware设置proxy代理的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!

scrapy默认middleware

scrapy默认middleware