本文主要是介绍努力成为优秀视觉工程师的一天(二),希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

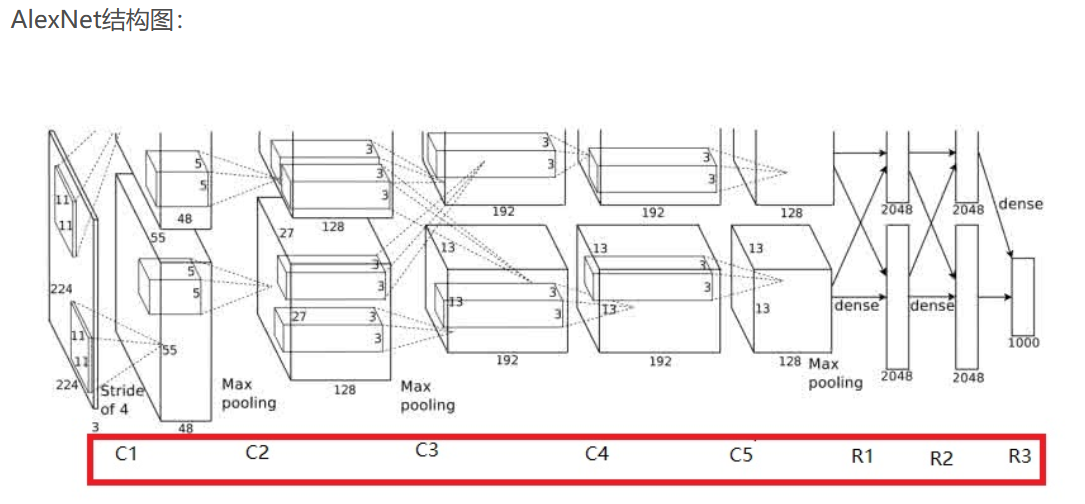

1. 经典神经网络AlexNet的理解

(1)卷积层、池化层 和全连接层的理解

从宏观的角度看,如果我们要对一幅图像进行识别,从图像处理--像素的角度来看,每个物体不同像素的组成构成了不同的特征,通过这些特征来区分物体是什么;那么卷积层就是从图像中提取各种特征,池化层就是为了简化特征提取最重要的特征,这样可以减少识别的时间,全连接层就是把这些特征都组合起来,这样才能判断这个图像中到底是什么东西

(2)卷积层是如何实现特征提取的

首先,从图像处理的角度,卷积本意是寻求两个图像的相似度,例如我们要提取图像中的圆,那么我们用一个圆的模板与之进行卷积,值最高的地方就是最相似的地方,这样就可以找到圆的位置了;广义来讲,也就实现了圆这个特征的提取,那么在深度学习中,我们是不知道我们要提取什么特征,那么卷积的核也就是模板是不知道的,这个参数呢也就是通过不断学习得到的,这样才能提取出图像中有用的特征

卷积核的厚度(第三维的尺寸)=被卷积的图像的通道数

卷积核的个数=卷积操作后输出的通道数(第三维的尺寸)

(3)池化层如何实现特征融合和降维的

池化也是一种类似卷积的操作,只是池化层的所有参数都是超参数,都是不用学习得到的。池化操作的降维改变的是图像的宽高,而不改变通道数。

(4)全连接层如何实现分类的

全连接层其实就是之前学深度学习时最简单的y=wx+b,通过第一层将卷积的结果再经过卷积生成列向量,通过激活函数将其进行非线性化,从而分类

总结,AlexNet是由五个卷积层和三个全连接层组成的八层网络,参数个数:60M,分类数目:1000类

这篇关于努力成为优秀视觉工程师的一天(二)的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!