2.9专题

青龙面板2.9之Cdle傻妞机器人编译教程

看到有的朋友对傻妞机器人感兴趣,这里写一下傻妞机器人的编译教程。 第一步,这里以linux amd64为例,去官网下载安装go语言安装包: 第二步,输入下方指令 cd /usr/local && wget https://golang.google.cn/dl/go1.16.7.linux-amd64.tar.gz -O go1.16.7.linux-amd64.tar.gz

RTA_OS基础功能讲解 2.9-警报器

RTA_OS基础功能讲解 2.9-警报器 文章目录 RTA_OS基础功能讲解 2.9-警报器一、警报器简介二、警报器配置2.1 激活一个任务2.2 设置一个事件2.3 执行回调函数2.4 递增一个(软件)计数器 三、警报器设置3.1 绝对警报3.1.1 单次触发3.1.2 周期触发3.1.3 在过去设置警报3.1.4 将绝对周期警报与计数器循环同步 3.2 相对警报3.2.1 单次触发

【APM】在Kubernetes中,使用Helm安装loki-distributed 2.9.6

1、Loki简介 Grafana Loki 是一个开源的云原生日志聚合和分析系统,由 Grafana Labs 开发并维护。Loki 专注于为大规模的日志处理提供经济高效且易于管理的解决方案,尤其适用于微服务架构以及容器化和分布式环境。 以下是 Loki 的核心特性与设计原则: 标签驱动存储: Loki 不对完整的日志内容进行索引,而是仅对每个日志流(log stream)定义的一组标签(

实践笔记-harbor-01搭建(版本:2.9.0)

harbor搭建 1.下载安装包(版本:2.9.0)2.修改配置文件3.安装4.访问harbor5.可能用得上的命令: 环境:centos7 1.下载安装包(版本:2.9.0) 网盘资源:https://pan.baidu.com/s/1fcoJIa4xbvB7CtazYZNxQg?pwd=jb7w 在线下载: https://github.com/goharbor/har

selenium ide 2.9.1安装+firefox 53.0下载安装

火狐浏览器下载地址:http://ftp.mozilla.org/pub/firefox/releases/53.0/win64/zh-CN/ selenium IDE 下载地址:https://addons.mozilla.org/zh-CN/firefox/addon/selenium-ide/versions/ 1, 2, 3, 4,

实践笔记-harbor搭建(版本:2.9.0)

harbor搭建 1.下载安装包(版本:2.9.0)2.修改配置文件3.安装4.访问harbor5.可能用得上的命令: 环境:centos7 1.下载安装包(版本:2.9.0) 网盘资源:https://pan.baidu.com/s/1fcoJIa4xbvB7CtazYZNxQg?pwd=jb7w 在线下载: https://github.com/goharbor/har

docker :安装docker报错 container-selinux = 2.9

背景: 在centos7.5的环境上安装docker的时候报错 原因分析: 报错是container-selinux版本低或者是没安装的原因 yum 安装container-selinux 一般的yum源又找不到这个包 需要安装epel源 才能yum安装container-selinux 解决办法: 下载阿里云的repo并安装所需的rpm,方法如下 wget -O /etc/yum.repos

深度学习-2.9梯度不稳定和Glorot条件

梯度不稳定和Glorot条件 一、梯度消失和梯度爆炸 对于神经网络这个复杂系统来说,在模型训练过程中,一个最基础、同时也最常见的问题,就是梯度消失和梯度爆炸。 我们知道,神经网络在进行反向传播的过程中,各参数层的梯度计算会涉及到激活函数导函数取值,具体来说,假设现在有一个三层的神经网络,其中两个隐藏层的激活函数为 F ( x ) F(x) F(x),对应的导函数为 f ( x ) f

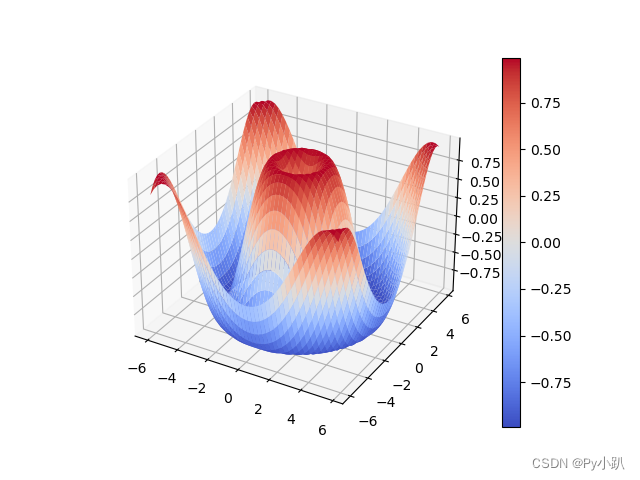

Python数学建模-2.9Matplotlib库

Matplotlib库是Python中一个非常流行的绘图库,它提供了大量的绘图工具,可以生成各种类型的静态、动态、交互式的图表。Matplotlib的设计初衷是为了与NumPy配合使用,从而提供一个强大的数学绘图工具。 1.Matplotlib的主要特点 丰富的图表类型:支持绘制线图、柱状图、散点图、饼图、等高线图、热力图、雷达图、三位曲线和曲面等多种类型的图表。高度可定制性:允许用户通过

2.9 启动文件和适配(笔记)

引擎入口: AppDelegate 的 applicationDidFinishLaunching函数 bool AppDelegate::applicationDidFinishLaunching() {// initialize director 获得导演类auto director = Director::getInstance();// 获得画布auto glview = dire

Pont深坑,与swagger 2.9的兼容问题

Pont是一个很好的前后端一体化工具,能够帮助自动生成API代码。 今天正在整Pont的时候,发现个别API参数在pont里无法导出,经过反复的对比发现。只要使用了@ApiParam或@ApiImplicitParam的参数,都无法正常被pont导出。例如定义的接口如下: @PostMapping("testPost")@ApiOperation(value = "后台管理员登录a

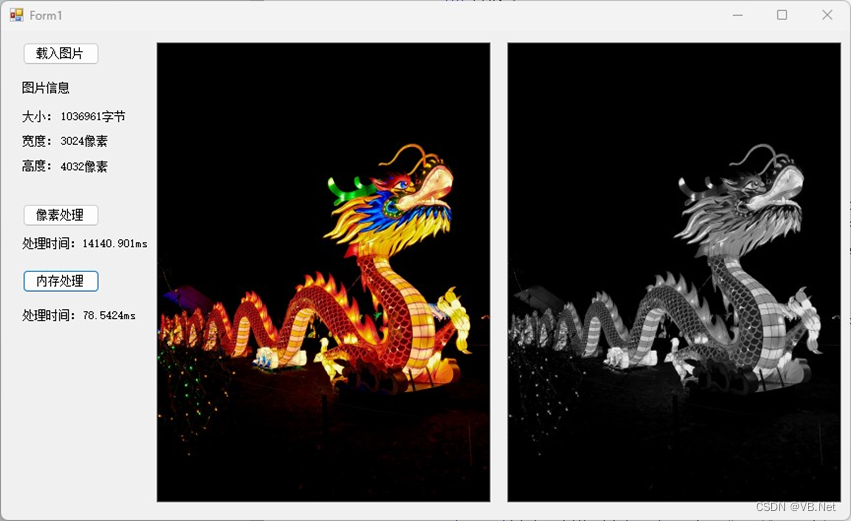

17.3.2.9 像素处理与内存处理之比较

版权声明:本文为博主原创文章,转载请在显著位置标明本文出处以及作者网名,未经作者允许不得用于商业目的。 通过第17.3.2.1节到第17.3.2.8节,相信读者对通过锁定内存来处理图像有了一定认识。与第17.3.1节相比较,可以看到代码量增加了不少,而且跟踪字节数组中数据位置时很容易把人绕晕。因此这里有一个重要的问题:为什么需要学习复杂的内存处理? 答案就是:一切都是为了效率。 【例 17.

2.9日学习打卡----初学RabbitMQ(四)

2.9日学习打卡 一.RabbitMQ 死信队列 在MQ中,当消息成为死信(Dead message)后,消息中间件可以将其从当前队列发送到另一个队列中,这个队列就是死信队列。而在RabbitMQ中,由于有交换机的概念,实际是将死信发送给了死信交换机(Dead Letter Exchange,简称DLX)。死信交换机和死信队列和普通的没有区别。 消息成为死信的情况: 队列消息长度到达限制

hadoop 2.9.2 win7编译文件

这里写自定义目录标题 欢迎使用Markdown编辑器新的改变功能快捷键合理的创建标题,有助于目录的生成如何改变文本的样式插入链接与图片如何插入一段漂亮的代码片生成一个适合你的列表创建一个表格设定内容居中、居左、居右SmartyPants 创建一个自定义列表如何创建一个注脚注释也是必不可少的KaTeX数学公式新的甘特图功能,丰富你的文章UML 图表FLowchart流程图导出与导入导出导入

ARIA库 2.9.0与VS 2012 配置步骤

** ARIA库配置vs2012 vs版本2012 安装ARIA 2.9.0-1和mobilesim 在ARI-2.0版本以后,ARIA只支持VS.NET,下面的操作都是在VS.NET中进行,就是说不支持vc6.0请大家注意。 1.Project->Properties->”AllConfigurations”->”C/C++” section->”General”->”Add

李飞飞两位高徒联合指导:能看懂「多模态提示」的机器人,zero-shot性能提升2.9倍...

视学算法报道 编辑:LRS 【导读】李飞飞朝着她的北极星「具身智能」又前进了一步! 人工智能领域的下一个发展机会,有可能是给AI模型装上一个「身体」,与真实世界进行互动来学习。 相比现有的自然语言处理、计算机视觉等在特定环境下执行的任务来说,开放领域的机器人技术显然更难。 比如prompt-based学习可以让单个语言模型执行任意的自然语言处理任务,比如写代码、做文摘、问答,只需

递归与分治策略-2.9.1线性时间选择(随机划分基准)(第k小问题)

import java.util.Random;/*** 线性时间选择——随机选择*/public class test2_9_1 {static Comparable a[] = {"49","38","65","97","76","13","27"};/*** 返回(left~right)内第k小元素*/private static Comparable randomizedSelect

2.9-2.12段寄存器和cs:ip

段寄存器有四类:cs,ds,ss,es. 其中,cs是代码寄存器,它指向的代码段是一组地址连续,起始地址为16的倍数的内存单元。这个代码段可以存储长度为N(N<=64KB)的一组代码。 而与之相关联的是IP(指令指针寄存器), 步骤如下: (1)cs:ip在地址加法中获得内存地址(csX16+ip),然后将通过输入输出控制电路和20位地址总线获得内存地址,将指令通过数据总线和输入输出控制电路放到指

写一个复数类Complex,(复数形如3.2+5.6i,2.9-1.3i,其中i*i=-1)。要求支持+-*/,++、--,到bool类型和string类型的转换,支持、运算符。

// ConsoleApplication1.cpp : 定义控制台应用程序的入口点。//#include "stdafx.h"#include <iostream>using namespace std;class Complex{float a;float b;public:Complex():a(),b(){}Complex(const float& a, const float&

Could not resolve com.github.CymChad:BaseRecyclerViewAdapterHelper:2.9.28.

1、首先进入阿里云maven仓库,在搜索栏输入无法下载的依赖名称,查询现有版本号,可以看到这里有2.9.34。 2、在build.gradle(Project)的buildscript闭包下替换为阿里云maven仓库: maven { url 'https://www.jitpack.io' }maven { url 'https://maven.aliyun.com/reposito

Could not resolve com.github.CymChad:BaseRecyclerViewAdapterHelper:2.9.28.

1、首先进入阿里云maven仓库,在搜索栏输入无法下载的依赖名称,查询现有版本号,可以看到这里有2.9.34。 2、在build.gradle(Project)的buildscript闭包下替换为阿里云maven仓库: maven { url 'https://www.jitpack.io' }maven { url 'https://maven.aliyun.com/reposito

Unity2019报错Microsoft (R) Visual C# Compiler version 2.9.1.65535

推荐阅读: 我的CSDN 我的博客园 QQ群:704621321 我的个人博客 版本介绍 我是用的版本是: unity 2019.4.20f1 Personal Visual Studio 2019 报错 报错截图如下: 解决 尝试解决办法(一) 双击报错,查看具体报错信息

ShareSDK for iOS 2.9.2已经发布

更新内容: 1、修复微信在调用客户端分享接口时崩溃问题。 新版本SDK下载地址: http://share.mob.com/Download Wiki已经完成更新,地址为: http://wiki.sharesdk.cn/iOS%E5%BF%AB%E9%80%9F%E9%9B%86%E6%88%90%E6%8C%87%E5%8D%97 Github上已经完成版本更新,地址为: https:/

ShareSDK for iOS 2.9.0已经发布

ShareSDK for iOS v2.9.0已经发布,本次更新内容包括: 1、修复Facebook获取用户信息报错问题 2、修复Instagram在iPad上显示分享菜单错误问题,需要指定菜单容器。 3、修复人人网分享不能在手机客户端显示问题。 4、增加明道、Line、WhatsApp平台分享。 5、修复iPhone越狱设备安装handyPhone插件时崩溃问题。 新版本SDK下载

2.9-tf2-数据增强-tf_flowers

文章目录 1.导入包2.加载数据3.数据预处理4.数据增强5.预处理层的两种方法6.把与处理层用在数据集上7.训练模型8.自定义数据增强9.Using tf.image tf_flowers数据集 1.导入包 import matplotlib.pyplot as pltimport numpy as npimport tensorflow as tfimp

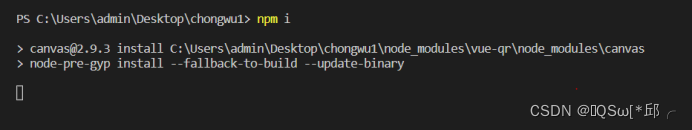

npm i 出现canvas@2.9.3 install C:\Users\admin\Desktop\chongwu\node_modules\vue-qr\node错误信息

npm i 出现canvas@2.9.3 install C:\Users\admin\Desktop\chongwu\node_modules\vue-qr\node错误信息 1.出现的问题2.如何解决 1.出现的问题 就是拿到一个项目,npm i出现如下的错误: 2.如何解决 2.npm install canvas@2.9.3 --canvas_binary_hos