面向专题

四种Flutter子页面向父组件传递数据的方法介绍

《四种Flutter子页面向父组件传递数据的方法介绍》在Flutter中,如果父组件需要调用子组件的方法,可以通过常用的四种方式实现,文中的示例代码讲解详细,感兴趣的小伙伴可以跟随小编一起学习一下... 目录方法 1:使用 GlobalKey 和 State 调用子组件方法方法 2:通过回调函数(Callb

《数字图像处理(面向新工科的电工电子信息基础课程系列教材)》P98

更改为 差分的数学表达式从泰勒级数展开式可得: 后悔没听廖老师的。 禹晶、肖创柏、廖庆敏《数字图像处理(面向新工科的电工电子信息基础课程系列教材)》 禹晶、肖创柏、廖庆敏《数字图像处理》资源二维码

实例demo理解面向接口思想

浅显的理解面向接口编程 Android开发的语言是java,至少目前是,所以理解面向接口的思想是有必要的。下面通过一个简单的例子来理解。具体的概括我也不知道怎么说。 例子: 现在我们要开发一个应用,模拟移动存储设备的读写,即计算机与U盘、MP3、移动硬盘等设备进行数据交换。已知要实现U盘、MP3播放器、移动硬盘三种移动存储设备,要求计算机能同这三种设备进行数据交换,并且以后可能会有新的第三方的

面向AI编程2024

文章目录 一、AIGC简介二、面向AI编程总结 近年AI技术发展真的迅猛,特别是AIGC,AIGC改变着各行各业,也改变了我。现在我很少再像从前那样面向浏览器编程,现在的我更倾向于面向AIGC编程,因为我发现她真的很懂我啊! 一、AIGC简介 AIGC是一种生成式AI,主要方向是文本、图像、音视频,特别是文本,这里有一些AIGC产品,似乎很多,五花八门的,其实很多是同一个或同

系统架构师考试学习笔记第三篇——架构设计高级知识(18)面向服务架构设计理论与实践

本章考点: 第18课时主要学习面向服务架构设计理论与实践。根据考试大纲,本课时知识点会涉及单选题型(约占2~5分)和案例题(25分),本课时内容偏重于方法的掌握和应用,根据以往全国计算机技术与软件专业技术资格(水平)考试的出题规律,概念知识的考查内容多数来源于实际应用,还需要灵活运用相关知识点。 本课时知识架构如图18.1所示。 一、SOA的相关概念 (

面向对象编程 和 面向过程编程 介绍

面向对象编程(Object-Oriented Programming,OOP)和面向过程编程(Procedural Programming,PP)是两种常见的编程范式。它们各自有不同的设计理念、代码组织方式和适用场景。以下是对这两种编程范式的详细介绍。 1. 面向对象编程(OOP) 面向对象编程是一种以对象为核心的编程范式,它将程序结构化为一组对象,这些对象具有特定的属性(数据)和行为(方法)

首次揭秘,面向核心业务的全闪分布式存储架构设计与实践

当今是云计算、大数据的时代,企业业务持续增长需要存储系统的 IO 性能也持续增长。 机械盘本身的 IOPS 一直徘徊在数百的级别,为了提高传统存储的性能,有些存储厂商加了缓存层,然而目前应用正由单一走向多元化,导致 IO 特征无法预测,缓存也难以发挥作用。 机械盘依赖盘片的旋转和机械臂的移动进行 IO,目前转速基本达到物理极限,所以机械盘性能一直徘徊不前,无法满足企业核心业务对于存储性能的要求

c++的面向过程与面向对象

面向过程与面向对象 面向过程: 在编程时重点考虑如何解决问题,以及解决问题的具体步骤。 面向对象: 在编程时重点考虑的是"谁"能解决问题(类、结构),以及"它"解决问题时所需要属性(成员变量)和功能(成员函数)。 抽象: 把“解决问题者”当作思考或观察对象,把解决问题所需的具备的属性和功能罗列出来,这个步骤叫作抽象。 封装: 把抽象的结果(问题所需的具体的属性和功能),设置相应访问

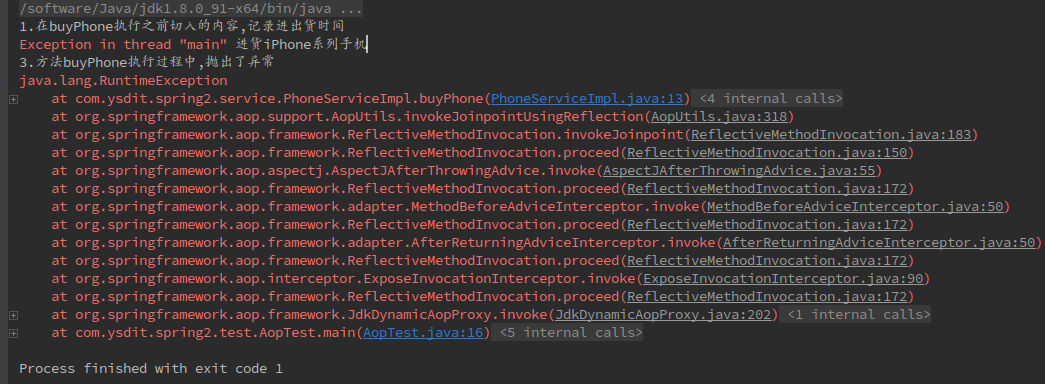

Spring之AOP面向切面编程实现(一)

实现方式:基于配置XML和基于注解实现。 场景:一个手机进货系统,一旦要进货(或出货),要提前记录进货时间,进货完毕后,还要提醒其它人进行验货。 分析:3步走,1,操作进货(或出货)的方法的时候,先记录当前的时间,完毕后,提醒其他人验货。为了不使代码变得冗余,采用aop的策略实现。 基于配置实现 进货出货的接口: IPhoneService.java public i

《论面向服务架构设计及其应用》写作框架,软考高级系统架构设计师

论文真题 面向服务架构(Service-Oriented Architecture, SOA) 是一种应用框架,将日常的业务应用划分为单独的业务功能服务和流程,通过采用良好定义的接口和标准协议将这些服务关联起来。通过实施基于SOA的系统架构,用户可以构建、部署和整合服务,无需依赖应用程序及其运行平台,从而提高业务流程的灵活性,帮助企业加快发展速度,降低企业开发成本,改善企业业务流程的组织和资

《数字图像处理(面向新工科的电工电子信息基础课程系列教材)》出版1周年

去年为廖老师的甲子而出书,时光荏苒如白驹过隙,转眼出版一周年了。这本书能有这样的品质,与廖老师的指导密不可分,尤其是在他擅长的统计学领域。巩固了统计学基础,对我深入理解当前最热门的生成模型(如VAE、扩散模型)起到了至关重要的作用。 最让我感动的是,最初他给我指出问题,我不认为我有问题,我认为是他不懂,他坚持不懈地找我讨论。我作为老师我做不到,如果学生觉得自己什么都知道,我肯定就不理他了。感谢廖

基于面向协议MVP模式下的软件设计-iOS篇

//原文地址:http://help.3g.163.com/15/1223/06/BBGISBCJ00964KAD.html 传统模式下的开发 MVC MVVM 基于面向协议MVP的介绍 MVP实战开发 说在前面: 相信就算你是个iOS新手也应该听说过MVC的,MVC是构建iOS App的标准模板。随着时间的推移,在iOS平台上MVC也逐渐开始面临着越来越多的问题,最近又开始流

面向智慧农业的物联网监测系统设计(论文+源码+实物)

1系统方案设计 根据系统功能的设计要求,展开面向智慧农业的物联网监测系统设计。如图2.1所示为系统总体设计框图。系统采用STM32单片机作为系统主控核心,利用YL-69土壤湿度传感器、光敏传感器实现农作物种植环境中土壤湿度、光照数据的采集,系统通过4G通信模块实现数据无线传输,用户在手机端能够实时查看系统监测的数据信息并实现智能化的控制要求,在工作模式上,有自动和手动两种模式,手动模式下可以直接

python面向过程、面向对象

文章目录 1、前言2、面向过程 OPP3、面向对象 OOP4、参考 1、前言 考虑这样一个问题,500个小孩围城一,从第一个小孩开始计数,逢三出圈(逢三:代表能被三整除,如6、27、468),使用python面向过程和面向对象进行编程解答。 2、面向过程 OPP # 定义500个孩子cycle = list(range(1, 501))step = 1while l

Spring核心功能——AOP(面向切面编程)

目录 AOP 1 介绍 2 AOP术语 3 应用场景 4 演示 AOP 1 介绍 Spring中另外一个核心功能,AOP AOP(Aspect Oriented Programming),即面向切面编程. OOP(Object Oriented Programming ),即面向对象编程. AOP面向切面编程,利用 一种称为"横切"的技术,剖开封装的对象内部,并将

连载:面向对象葵花宝典:思想、技巧与实践(3) - 面向过程 vs 面向对象

面向过程 在介绍面向对象之前,我们首先要介绍“面向过程“,首先是因为”面向过程“是软件思想中的鼻祖;其次是因为只有了解了面向过程,你才能更好的了解面向对象!正所谓:知己知彼百战百胜! 面向过程是一种以“过程”作为中心的编程思想,其中过程的含义就是“完成一件事情的步骤”。 面向过程其实是一种“机械的思想”,它就像流水线一样,一个阶段衔接一个阶段,每个阶段都有自己的输入、处理、输出,

什么是AOP(面向切面编程)

目录 前言 一、什么是面向切面编程 二、java中常用的AOP思想场景 三、示例 前言 小伙伴们在学校学习的时候,是否遇到过许多的编程思想。面向对象,面向过程,面向切面...。学习java的小伙伴在学习面向对象、面向切面的时候是否感到过迷惑。也许过了许久后才反应过来,原来是这么回事。今天我在此记录下什么是面向切面编程,如有不当之处还望指出。谢谢! 一、什么是面向切面编程

在Spring Boot中通过自定义注解、反射以及AOP(面向切面编程)

在Spring Boot中,通过自定义注解、反射以及AOP(面向切面编程)来动态修改请求参数是一种高级且强大的技术组合,它允许开发者在不修改原始方法实现的情况下,对方法的执行过程进行干预和定制。这种技术通常用于日志记录、权限校验、参数校验、数据脱敏等场景。下面,我将详细阐述如何使用这些技术来实现一个动态修改请求参数的示例。 第一步:定义自定义注解 首先,我们需要定义一个注解,用于标记哪些方法或

14、java 面向对象之一:面向过程与面向对象区别、对象的创建与使用、类的成员之一(属性)、类的属性之二(方法)等详解

java 面向对象之一: Ⅰ、面向过程与面向对象的区别:1、面向过程与面向对象描述:2、面向对象的两个要素:类与对象 Ⅱ、对象的创建与使用:1、面向对象思想:对象的创建与使用其一、描述:其二、代码为:其三、截图为: Ⅲ、类的成员:1、类中方法的声明和使用:其一、描述:其二、代码为:其三、截图为: 2、同类不同对象间的关系:独立堆空间其一、描述:其二、代码为:A、Person.java 与

面向整个价值链的高可信度卫星测试解决方案

在动态行业格局中增强卫星任务能力 在罗德与施瓦茨,我们利用专业知识和量身定制的测试和测量解决方案为卫星行业提供支持。这包括帮助行业参与者满足完整测试路径的要求,以实现完美的系统性能,确保符合最新技术和标准。此外,我们还提供全面的服务、咨询和集成测试解决方案,以实现高效的测试执行。 小型卫星的转变是由技术进步和对成本效益的追求推动的。配备更智能、更紧凑子系统的小型卫星正在逐渐取代大型卫星。这

【论文解读】SAM模型超级进化:面向移动端的轻量级SAM,比FastSAM快4倍!(附论文地址)

论文地址:https://arxiv.org/pdf/2306.14289.pdf 这篇论文的标题是《FASTER SEGMENT ANYTHING: TOWARDS LIGHTWEIGHT SAM FOR MOBILE APPLICATIONS》,由Chaoning Zhang等人撰写,发表于2023年。 文章主要探讨了如何将Segment Anything Model(SAM)优化

【系统架构设计师】论文:论SOA面向服务架构技术的应用

论文:论SOA面向服务架构技术的应用 文章目录 摘要正文总结 摘要 本人于2020年7月参加国内某某知名港口供电业务系统的开发工作,在该项目中主要担任系统架构师,主要负责该系统架构和网络安全体系架构设计。经过近20年的港口信息化建设,港口供电系统已经建立了一些应用系统,但是,随着港口供电业务的发展,有些系统已经无法满足目前供电业务需求,同时存在已经开发的系统之间信息共享能力

面向对象和面向过程 不同之处

对于不同的语言来说: C是面向过程 C++ JAVA是面向对象 C程序的设计首要考虑的是如何通过一个过程,对输入(或环境条件)进行运算处理得到输出(或实现过程(事务)控制) C++,首要考虑的是如何构造一个对象模型,让这个模型能够契合与之对应的问题域,这样就可以通过获取对象的状态信息得到输出或实现过程(事务)控制。 面向对象和面向过程的区别

搭建面向切面编程项目

此项目在整合Mybatis基础上修改,可参考主页的整合Mybatis文章 注解版本 第一步 引入maven坐标 <!-- 切面编程所需jar包--><dependency><groupId>org.springframework</groupId><artifactId>spring-context</artifactId><version>5.0.2.RELEASE</versi

面向对象编程与面向过程编程的区别与联系

转载自 https://www.cnblogs.com/Mr--Yang/p/6886447.html LinuxC编程的学习已经告一段落,这段开始学C++。C++是面向对象编程,C语言是面向过程编程。因此学习C++的第一件事就是要弄明白什么是面向过程编程,什么是面向对象编程。 之前学习的C语言是面向过程编程,回想一下C语言编程的过程。主函数,定义变量,调用函数然后实现。面向过程编程是一

开放封闭原则之“面向接口编程”

开放封闭原则之“面向接口编程” 前言: 同样是开放封闭原则,在ITOOjava的项目中,对“面向接口编程”又有了更深刻的理解,下面请听小编徐徐道来: 开放封闭原则定义:用面向接口编程这就为我们以后程序的扩展性提供基础。“对修改封闭,对扩展开发”。 利用接口的一个基本用途,规定子类的行为。更为广阔的用途是接口为其