每天专题

每天认识几个maven依赖(ActiveMQ+activemq-jaxb+activesoap+activespace+adarwin)

八、ActiveMQ 1、是什么? ActiveMQ 是一个开源的消息中间件(Message Broker),由 Apache 软件基金会开发和维护。它实现了 Java 消息服务(Java Message Service, JMS)规范,并支持多种消息传递协议,包括 AMQP、MQTT 和 OpenWire 等。 2、有什么用? 可靠性:ActiveMQ 提供了消息持久性和事务支持,确保消

每天一道面试题(2):fail-safe 机制与 fail-fast 机制分别有什么作用?

当谈论Java集合的 fail-fast 和 fail-safe 机制时,涉及的是在集合被并发修改时的行为和处理方式。这些机制对保证程序的正确性和稳定性非常重要,尤其是在多线程环境中。 1. Fail-Fast 机制 定义: Fail-fast 机制的核心是在检测到集合在遍历过程中被修改时,立即抛出 ConcurrentModificationException 异常,从而中断迭代操作。这种

【销售预测 ARIMA模型】ARIMA模型预测每天的销售额

输入数据txt格式: 2017-05-01 100 2017-05-02 200 ……. python 实现arima: # encoding: utf-8"""function:时间序列预测ARIMA模型预测每天的销售额author:donglidate:2018-05-25"""# 导入库import numpy as np # numpy库from statsmode

每天一个数据分析题(五百二十七)- word2vec模型

Word2vec,是一群用来产生词向量的相关模型。这些模型为浅而双层的神经网络,用来训练以重新建构语言学之词文本。关于word2vec模型,下面说法不正确的是: A. 得到的词向量维度小,可以节省存储和计算资源 B. 考虑了全局语料库的信息 C. 无法解决多义词的问题 D. 可以表示词和词之间的关系 数据分析认证考试介绍:点击进入 数据分析考试大纲下载 题目来源于CDA模拟题库 点

今日早报 每日精选15条新闻简报 每天一分钟 知晓天下事 9月6日,星期五

每天一分钟,知晓天下事! 2024年9月6日 星期五 农历八月初四 1、 “摩羯”加强为17级超强台风,6日广东深圳、珠海、湛江等多地全市停课。 2、 两部门:事业单位不得自行制定面向特定人员的专项招聘、加分等倾斜政策。 3、 央行:降准还有一定空间;存贷款利率进一步下行面临一定约束。 4、 我国天问三号任务计划2028年前后实施两次发射任务,实现火星样品返回地球。 5、 山东、四川、吉

每天掌握一个软测高级技巧:接口自动化神器apin进阶操作

之前写了一篇关于接口自动化框架 apin 入门使用是文章,主要介绍了 apin 的安装以及用例编写的方法。 今天这篇文章来给大家聊聊,apin 中的一些高级使用技巧。比如依赖接口的变量提取和引用,用例断言,以及函数工具的使用。 变量提取和引用 变量提取和引用主要是为了解决接口之间的参数依赖问题。 使用场景:接口 A 的参数中需要使用接口 B 返回的某个数据,那么就要在请求 B 接口之后,提

今日早报 每日精选15条新闻简报 每天一分钟 知晓天下事 9月5日,星期四

每天一分钟,知晓天下事! 2024年9月5日 星期四 农历八月初三 1、 气象台发布台风红色预警:“摩羯”或为近十年影响海南最强台风,海口5日12时起在全市范围内分批启动“六停”措施。 2、 国家医保局:将人工耳蜗等高值医用耗材纳入采购范围。 3、 食用油散装运输强制性国标启动制订:要求专用容器+核查运输记录。 4、 包装不得超三层、不得使用红木等,中秋节前多地启动

10天计划:每天5小时睡眠

Day 1 - Day 2: 适应期 目标:适应减少睡眠时间的变化。 睡眠:00:00 - 05:00(5小时)早晨(5:00 - 7:00):轻度运动(瑜伽、拉伸、散步)、20分钟冥想。上午(7:00 - 12:00):专注高强度任务(需要逻辑思考或创作)。中午(12:00 - 13:00):午餐,午间20分钟小睡。下午(13:00 - 17:00):处理日常任务和会议,做较轻松的工作。晚上

每天分享一个FPGA开源代码(3)- I2C

I2C(Inter-Integrated Circuit)是一种两线式串行总线。 一、主要特点 1. 简单性:只使用两根线,即串行数据线(SDA)和串行时钟线(SCL),减少了硬件连接的复杂性。 2. 多设备连接:可以连接多个具有 I2C 接口的设备到同一总线,每个设备都有唯一的地址,通过地址来区分和通信。 3. 双向通信:SDA 线允许数据在主设备和从设备之间双

MYSQL:删除指定时间范围内每个电站每天发电数据除最大值以外的记录

有一个需求,需要保留每个电站每一天发电数据的最大值记录,其余删除。 表数据大概长这样: MYSQL 5.7写法:(因为不支持ROW_NUMBER()函数,采用自定义的变量来代替) 首次清理一年内数据:INTERVAL 365 DAY清理前一日数据:INTERVAL 1 DAY----------------- DELETE A FROM power_app_data_log

每天一个数据分析题(五百一十九)- Word2vec

Word2vec,是一群用来产生词向量的相关模型,用来训练以重新建构语言学之词文本。Word2Vec包含哪两种模型? A. CBOW模型和Skip-Gram模型 B. Bag-of-Words和GloVe模型 C. LSA模型和CBOW模型 D. GloVe模型和CBOW模型 数据分析认证考试介绍:点击进入 数据分析考试大纲下载 题目来源于CDA模拟题库 点击此处获取答案

作为中级前端工程师,每天都做些什么?

一直以来都没有记录或总结过自己每天工作模式和状态,以至于说回想起刚毕业参加工作的时候,作为一个初级开发,做事凭借着满腔热情,花的时间多,但成长是否成正比呢? 今天分享一下自己当前的工作状态,其一是能够在不久后跟自己对比是否有所长进,其二也想看看JYM的工作方式,顺便偷师🐶! 顺带吆喝一句,技术大厂,前后端测试机会,捞人。 通勤 现在住的地方离公司比较远,前前后后需要40min,反而我比较

【软件逆向】第38课,软件逆向安全工程师之操作标志寄存器实例,每天5分钟学习逆向吧!

在这些实例学习中,我们使用汇编指令来操作标志寄存器,并根据标志寄存器的状态进行条件分支。这些操作对于编写高效的汇编程序以及理解程序的行为至关重要 实例 1:使用 PUSHF 和 POPF 保存和恢复标志寄存器状态 section .text global _start _start: ; 初始化 AL 寄存器 MOV AL, 0xFF ; 对 AL 寄存器进行加一操作,这将导致 AL 寄存器的

每天一个数据分析题(五百一十七)- Skip-Gram模型

Skip-Gram模型的基础形式非常简单,为了更清楚地解释模型,我们先从最一般的基础模型来看Word2Vec。Skip-Gram模型不包含以下哪一项? A. 输入层 B. 池化层 C. 输出层 D. 隐藏层 数据分析认证考试介绍:点击进入 题目来源于CDA模拟题库 点击此处获取答案 数据分析专项练习题库 内容涵盖Python,SQL,统计学,数据分析理论,深度学习,可视化,机器学

【软件技巧】第35课,软件逆向安全工程师之汇编指令mov、ptr、xchg交换指令,每天5分钟学习逆向吧!

在x86汇编语言中,mov 指令用于将一个值从一个位置移动到另一个位置。这个值可以是立即数、寄存器中的值、内存中的值或者是一个指针。mov 指令是汇编语言中最常用的指令之一,因为它在数据传输和初始化操作中起着核心作用。 mov 指令的基本格式: mov 目标操作数, 源操作数 目标操作数:接收数据的操作数,通常是寄存器、内存地址或者是一个指针。源操作数:提供数据的操作数,可以是立即数、寄存器

【软件逆向】第30课,软件逆向安全工程师之(五)寄存器相对寻址,每天5分钟学习逆向吧!

寄存器相对寻址是汇编语言中的一种寻址方式,它结合了寄存器间接寻址和立即数偏移。在这种寻址方式中,操作数的有效地址是通过将一个寄存器的内容与一个固定的偏移量(立即数)相加来得到的。以下是关于寄存器相对寻址的详细信息: 寄存器相对寻址的特点: 操作数地址是寄存器内容与偏移量的和:有效地址是寄存器的内容加上一个固定的立即数偏移量。灵活且具体:提供了对特定内存位置的间接访问,同时允许通过改变寄存器的内

每天五分钟玩转深度学习PyTorch:nn.Module中封装好的神经网络层

本文重点 PyTorch实现了神经网络中绝大多数的layer,这些layer都继承于nn.Module,封装了可学习参数parameter,并实现了forward函数,且很多都专门针对GPU运算进行了CuDNN优化,其速度和性能都十分优异。本文介绍pytorch中已经封装好的神经网络层,我们可以直接通过nn.的方式来调用。本文主要学习第2步(模型搭建)。 全连接层 nn.Linear(i

【软件逆向】第27课,软件逆向安全工程师之(二)寄存器寻址,每天5分钟学习逆向吧!

寄存器寻址是汇编语言中的一种寻址方式,在这种方式中,操作数位于CPU的寄存器中。寄存器是CPU内部的高速存储位置,用于快速访问数据。以下是关于寄存器寻址的详细信息: 寄存器寻址的特点: 操作数在寄存器中:数据直接存储在寄存器中,而不是内存地址或立即数。快速访问:由于寄存器位于CPU内部,因此访问速度远快于内存。指令简短:使用寄存器寻址的指令通常较短,因为不需要指定内存地址。 识别寄存器寻址:

【软件逆向】第34课,软件逆向安全工程师之段寄存器,每天5分钟学习逆向吧!

在x86架构的汇编语言中,段寄存器是一组用于存储内存地址的寄存器,它们与基址寄存器(如ebp、esp或eax)一起使用,以访问内存中的数据。段寄存器的主要作用是将线性地址转换为物理地址。 x86架构中的段寄存器包括: CS(Code Segment):代码段寄存器,存储当前正在执行的代码段的基址。DS(Data Segment):数据段寄存器,存储当前正在使用的数据段的基址。ES(Extra S

【软件技巧】第33课,软件逆向安全工程师之如何快速的跑到某行代码EIP设置,每天5分钟学习逆向吧!

鼠标右键在此设置EIP EIP(Extended Instruction Pointer)是x86架构中一个重要的寄存器,它用于存储当前正在执行的指令的地址。EIP是程序计数器(Program Counter)的扩展版本,因为它是32位寄存器,所以它能够存储一个32位的地址。 在x86架构中,EIP寄存器的作用如下: 指令地址:EIP寄存器存储当前正在执行的指令的内存地址。当CPU执行一个指令

每天学习一个Linux命令:systemd

systemd 是一个系统和服务管理器,用于 Linux 发行版,提供了一个强大的初始化系统和守护进程,能够管理系统的启动和服务。systemd 命令本身主要用于管理 systemd 守护进程及其控制的单元文件。 1. 命令简介 systemd 是一个系统和服务管理器,它替代了传统的 SysV init 系统。systemd 使用依赖关系来并行启动服务,从而加快启动过程,并且支持各种类型的单元

今日早报 每日精选15条新闻简报 每天一分钟 知晓天下事 9月1日,星期日

每天一分钟,知晓天下事! 2024年9月1日 星期日 农历七月廿九 1、 未来一周,四川东部、重庆等地持续高温天气,最高气温可达40~42℃。 2、 山西明确:今日起,职工医保个人账户家庭共济范围由直系亲属扩大至近亲属。 3、 湖南印发意见:在义务教育阶段开展学生每天校内体育锻炼2小时试点。 4、 河南:鼓励推广“一村一站一人”模式,设立乡村寄递物流收发公益性岗位。 5、

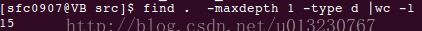

每天一个linux命令:find

原文出处:http://man.linuxde.net/find find命令用来在指定目录下查找文件。任何位于参数之前的字符串都将被视为欲查找的目录名。如果使用该命令时,不设置任何参数,则find命令将在当前目录下查找子目录与文件。并且将查找到的子目录和文件全部进行显示。 常用选项: -depth:从指定目录下最深层的子目录开始查找 -exec <执行指令>:假设find指令的回

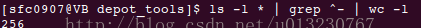

每天一个linux命令:ls

常用选项: -a:列出所有文件和文件夹 -A:列出所有文件,但不包括 . 和 .. -l:列出文件的详细具体信息 -F:在所有文件夹的后面加上/ -c:按照ctime的时间排序 -g:与-l类似,但不列出所有者 -R:列出所有子目录的内容 --version:你懂的 --help:你懂得 用法1:列出文件夹下所有文件的信息 用法2:列出该文件夹下所有的子目录 用

每天五分钟计算机视觉:人脸识别网络FaceNet

本文重点 在前面的课程中,为了解决人脸识别的问题,我们学习了Siamese神经网络。本文我们学习另外一种人脸识别网络模型FaceNet。 论文 FaceNet: A Unified Embedding for Face Recognition and Clustering FaceNet概述 FaceNet是谷歌在CVPR 2015上提出的一种深度学习模型,旨在解决人脸识别、验证和

每天一个数据分析题(五百一十一)- 神经网络

BP(back propagation)神经网络是1986年由Rumelhart和McClelland为首的科学家提出的概念,是一种按照误差逆向传播算法训练的多层前馈神经网络,是应用最广泛的神经网络。BP神经网络的训练顺序为何?( A:调整权重; B:计算误差值; C:利用随机的权重产生输出的结果) A. BCACA B. CABAB C. BACAC D. CBABA 数据分析认证考试