垂域专题

垂域LLM训练经验之谈

文章目录 前言一、全参 SFT二、LORA SFT三、LORA继续预训练四、Llama pro 预训练 + SFT总结 前言 本文将按以下几个部分进行叙述: 全参 SFTLora SFTLora 继续预训练Llama pro 预训练 + SFT 数据说明: 预训练数据:由SFT数据的Query 与 Answer 的拼接SFT数据:由GPT4根据垂域文档抽取问答对+人工

腾讯智能座舱体验升级 与车企共建座舱垂域大模型

当前,汽车用户用车时长持续增加,用车场景也在不断丰富,汽车智能座舱服务也越来越重要,加速“以人为中心”的智能座舱服务场景探索,成为车企打造差异化竞争力的关键。2023年9月8日,在2023腾讯全球数字生态大会·智慧出行专场,腾讯分享了智能座舱体验的全新升级,助力拓展更加丰富的智能用车场景,让人车交互、场景化服务体验更智能、更有趣。 基于座舱垂域大模型的应用,升级后的腾讯智能座舱TAI通过大数据分

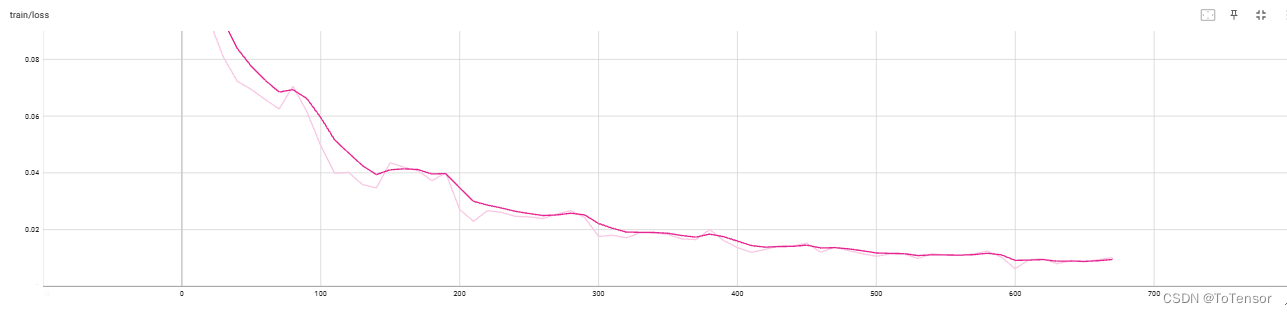

RAG之微调垂域BGE的经验之谈

文章目录 前言数据格式部分代码训练参数接下来的尝试总结 前言 随着大模型的爆火,很多垂域行业都开始使用大模型来优化自己的业务,最典型的方法就是RAG(检索增强生成)了。简单来说就是利用检索技术,找出与用户问题相关性最高的段落,再让LLM基于以上段落,去回答用户的提问。这样的事情,在CSDN的时候其实也做过一次,参考:CSDN问答机器人。只不过当时是在SBERT模型上微调,也取