swiftformer专题

2023年度端侧transformer类分类力作SwiftFormer模型解读

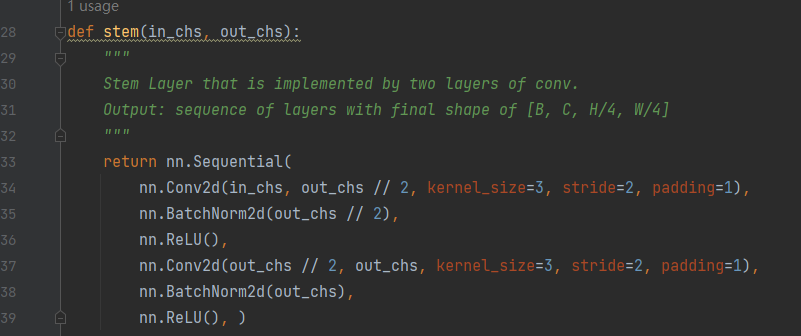

写在前面:本篇直接结合代码来理解网络的笔记 paper: Swiftformer-paper code: https://github.com/Amshaker/SwiftFormer 文章目录 网络结构精析零、整体一、patch embed二、stage 网络结构精析 零、整体 可以看到结构中,整体就是: stem -> 5X(convEncoder+S

SwiftFormer:基于Transformer的高效加性注意力用于实时移动视觉应用的模型

自注意力已经成为各种视觉应用中捕获全局上下文的默认选择。然而,相对于图像分辨率来说,它的二次计算复杂性限制了它在实时应用中的使用,尤其是在资源受限的移动设备上的部署。尽管已经提出了混合方法来结合卷积和自注意力的优点以获得更好的速度-精度权衡,但自注意力的昂贵的矩阵乘法操作仍然是一个瓶颈。在这项工作中,我们引入了一种新型的有效加性注意力机制,该机制通过线性元素乘法有效地替换了二次矩阵乘法操作。我们的