perceiver专题

【机器学习】使用Perceiver模型解决Transformer效率低下问题

1.引言 1.1.技术背景 Transformer在高维度输入上计算效率低下,制约了Transformer框架的应用和迭代: 内存消耗大: 当处理高维度输入,如长文本或高分辨率图像时,Transformer需要将模型参数和中间状态都保存到内存中。这会导致巨大的内存消耗。例如,在KV存储机制下,对于batch size为512、上下文长度为2048的设置,KV缓存里需要的空间规模可能达到3T

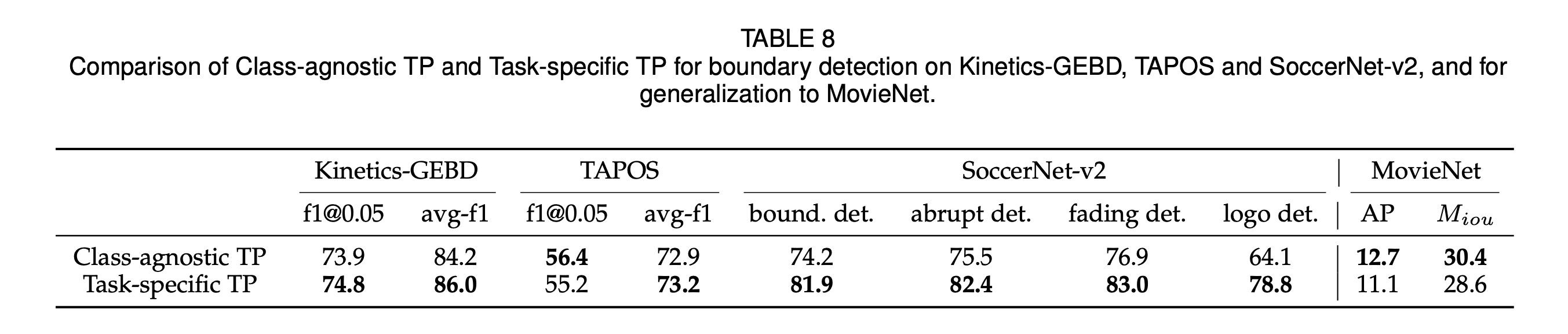

TPAMI 2023 | Temporal Perceiver:通用时序边界检测方法

本文介绍一下今年我们组被T-PAMI 2023收录的时序边界检测工作 Temporal Perceiver: A General Architecture for Arbitrary Boundary Detection。 论文名称: Temporal Perceiver: A General Architecture for Arbitrary Boundary Detec