icl专题

[论文笔记] LLM-ICL可解释论文:标签词是锚点:理解语境学习的信息流视角 Label Words are Anchors

Label Words are Anchors: An Information Flow Perspective for Understanding In-Context Learning Lean Wang, Lei Li, Damai Dai, Deli Chen, Hao Zhou, Fandong Meng, Jie Zhou, Xu Sun 信息流视角:论文提出了一种新的视角,即通

[论文笔记] LLM-ICL论文:AI模型对prompt格式分隔符的敏感性——结构化Prompt格式

又见惊雷,结构化Prompt格式小小变化竟能让LLM性能波动高达76%,ICLR2024

迪文屏开发保姆级教程3—背景图ICL文件生成

本篇文章主要介绍了在DGBUS平台上生成页面背景图片库,32xx.ICL文件的方法。 迪文屏官方开发指南PDF:(不方便下载的私聊我发给你) https://download.csdn.net/download/qq_21370051/88647174?spm=1001.2014.3001.5503https://download.csdn.net/download/qq_2137005

NeurIPS 2022|DeepMind最新研究:大模型背后的ICL可能与数据分布密切相关

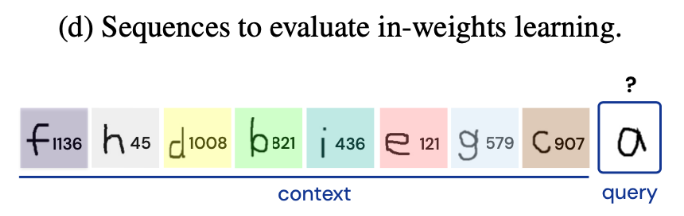

NeurIPS 2022|DeepMind最新研究:大模型背后的ICL可能与数据分布密切相关 大模型自然语言处理机器学习 传统的文本语言模型倾向于两阶段的训练模式,即首先在大规模语料库上进行预训练,然后在目标下游任务上进行微调,这种方式会受数据标注质量和过拟合等多方面的影响。最近兴起并流行的大型语言模型(large language models,LLMs)已经克服了这类问题,并且会展现出惊人

谈谈 NLP中 大语言模型 LLM的In-Context Learning(ICL) 能力

In-Context Learning(ICL) 传送门:https://github.com/wzzzd/LLM_Learning_Note/blob/main/Tuning/In-context-learning.md 1.介绍 自GPT-3首次提出了In-Context Learning(ICL)的概念而来,ICL目前已经变成了一种经典的LLMs使用方法。 2.思路 ICL主要思路

![[论文笔记] LLM-ICL可解释论文:标签词是锚点:理解语境学习的信息流视角 Label Words are Anchors](/front/images/it_default2.jpg)

![[论文笔记] LLM-ICL论文:AI模型对prompt格式分隔符的敏感性——结构化Prompt格式](https://i-blog.csdnimg.cn/direct/c9303ad01790475bbedae26b4c2a3a5f.png)