本文主要是介绍论文阅读:CNN+GCN,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

论文名称:卷积神经网络加上图卷积神经网络的边界回归方法用于医学图像分割。

期刊名称:ISSV 2019

作者:Yanda Meng Meng Wei.

作者单位:利物浦大学以及中科院宁波工业技术研究院。

摘要:

解剖结构的精准分割是医学图像分析的重要步骤,而边界回归的方法收到了研究者们的青睐。这种方法是从一个起点出发来进行分割任务,而不是对密集的像素点进行分类。然而,由于CNN的固有特性,使用卷积核拥有的局部感受野,缺乏空间信息,这些方法都需要额外的处理步骤来保存空间特征。这也会造成计算代价的增加以及特殊结构设计的困难和复杂。为了解决这个问题,本文提出了一种简单粗暴的边界回归方法。我们提出了一个新颖的多水平多层次的聚合网络,在一个端对端的模式下,回归实例的边界特征。我们提出的网络将卷积神经网络,注意力机制同图卷积网络无缝衔接起来(seamlessly link)。通过堆叠和迭代,特征能够被CNN提取,其中高低水平的特征信息都能够被提取出来,并且本文的模型将注意力转到边界上,而实现这一点主要靠GCN和注意力机制,最主要的是,多亏了聚合GCN和顶点采样的方法,模型能够获取到由稀疏到稠密的边界特征,这些特征是跨区域的,在超声图像的胎头分割任务和视盘视杯分割任务中证明了模型的有效性。

观模型

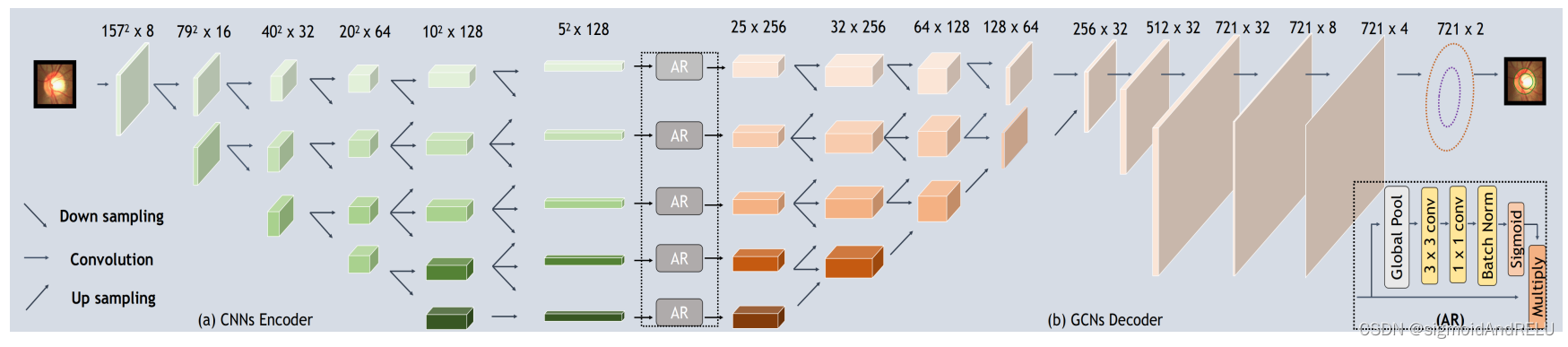

在作者给出的模型图片中,我们可以发现,将CNN作为encoder这是无可厚非的,提取能力还得靠卷积,而中间的层都是用一个简单的SEblock进行连接 ,但是这个东西的特殊之处在于将二维变成了一维,如果有代码那就更加清晰了,而GCN仅仅作为一个后处理的方式跟在二维的特征后,将图卷积节点分类的思想用在了图像上,这种想法是可圈可点的。

而唯一觉得不理解的地方在于特征在通过注意力模型之后变成一张图,即特征图的像素化成了点,并且特征图过小,对于图像的分割未必是好的。

只不过看结果是好的而已。

这篇关于论文阅读:CNN+GCN的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!

![[论文笔记]LLM.int8(): 8-bit Matrix Multiplication for Transformers at Scale](https://img-blog.csdnimg.cn/img_convert/172ed0ed26123345e1773ba0e0505cb3.png)