本文主要是介绍COIN 基于隐式神经表示对于压缩工作的探究,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

1. 论文基本信息

2. 创新点

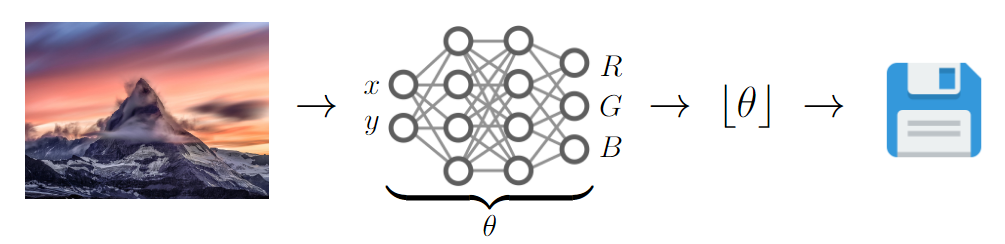

- 提出了一种新的图像压缩的简单方法:不是存储图像的每个像素的 RGB 值,而是存储过度拟合图像的神经网络的权重。

3. 背景

压缩隐式神经表示。使用神经网络将像素位置 (x, y) 映射到 RGB 值(通常称为隐式神经表示)来过度拟合图像。然后,将这个神经网络的权重 θ 量化为较低的位宽并传输它们。

- 将我们的方法与学习的权重分布相结合可能会导致有前途的神经数据压缩方法

- 将图像视为从像素位置到 RGB 值的函数,使得网络可以通过逐渐提高分辨率来形成渐进式解码,对资源受限的设备特别有吸引力。

4. Pipeline

令 I 表示我们希望编码的图像,使得 I[x, y] 返回像素位置 (x, y) 处的 RGB 值。文中定义了一个函数 fθ : R2 → R3,其参数 θ 将像素位置映射到图像中的 RGB 值,即 fθ (x, y) = (r, g, b)。然后,我们可以通过在一些失真度量下将 fθ 过拟合到图像上来编码图像。在本文中,我们使用均方误差,得到以下优化问题:

使用标准激活函数的 MLP 参数化 fθ 会导致欠拟合,有多种办法可以解决这个问题,有可能使用大量参数来使得 MLP 能够过拟合模型、或者使用正弦激活函数对像素坐标进行编码,文中选择了一种给定参数预算产生了功能好的结果。

文中采用两种方法减少模型的大小:

- 架构搜索:通过调整 MLP 的层数和每层的宽度 (即每层的神经元数量或参数量)来找到最优的网络架构。

- 权重量化:打 将权重的精度从 32 位降低到 16 位,有助于减少模型的大小。

5. 💎实验成果展示

6. 🔍问题分析

6.1. 局限性:

- 编码速度慢:

- 由于需要为每个编码的图像解决优化问题,编码过程较慢。这对于大规模的一对多媒体分发,如Netflix,可能不是理想的。

- 解码时的计算需求:

- 解码时需要在每个像素位置评估网络以还原完整的图像。尽管这种计算可以通过并行处理优化,但仍可能会产生一定的计算成本。

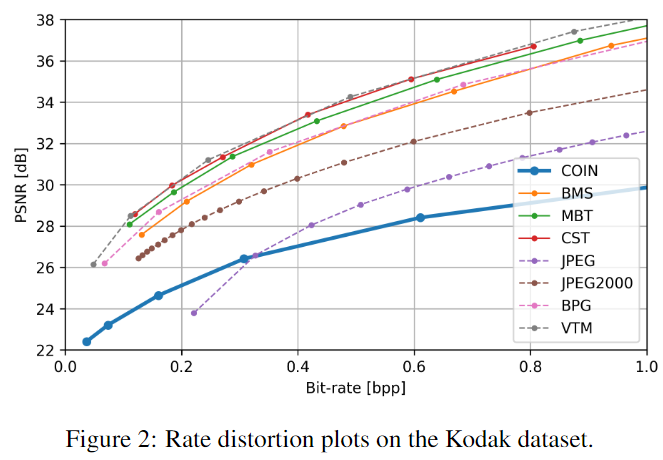

- 性能:

-

- 与现有的最先进的压缩方法相比,该方法的性能较差。

6.2. 未来工作方向:

- 元学习和摊销推理:

- 可能可以通过元学习或摊销推理方法绕过编码速度的局限性。

- 权重分布学习:

- 学习函数权重的分布可能会为该方法带来显著的压缩收益。

- 神经架构优化:

- 通过神经架构搜索或修剪等方法优化表示图像的函数的结构。

- 模型压缩:

- 可以采用更先进的模型压缩方法,而不仅仅是简单地将权重转换为半精度。

- 应用于其他类型的数据:

- 将该方法应用于不同类型的数据,如视频或音频,可能会有趣且有潜力。

这篇关于COIN 基于隐式神经表示对于压缩工作的探究的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!