本文主要是介绍中国成了国际学术会议论文最后一根救命稻草(转载),希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

中国成了国际学术会议论文最后一根救命稻草(转载)

标签: 国际 会议 1小时前这两年,大家都明显感觉到邮箱里面的会议信息多了。里面最常看到的信息有以下几条:(1)会议被EI检索,优秀论文推荐到SCI期刊。(2)会议日期延期,会议日期再延期。(3)第一届、第二届、第三届很多。

我本人是支持学者参加国际会议的,并且,每年都会有计划地参加几个知名会议。去年,我参加了METALFORMING、AMPT国际会议,今年已经投了摘要的是ICF、NUMIFORMING、PRICP三个国际会议,明年会议中计划投稿的有NUMISHEET等,目前还有几个也在构思中。我的想法是,勒紧裤腰带也要参加一些本领域主流国际会议。但是,对于非主流的国际会议,我今后肯定不参加,除非一切免费。

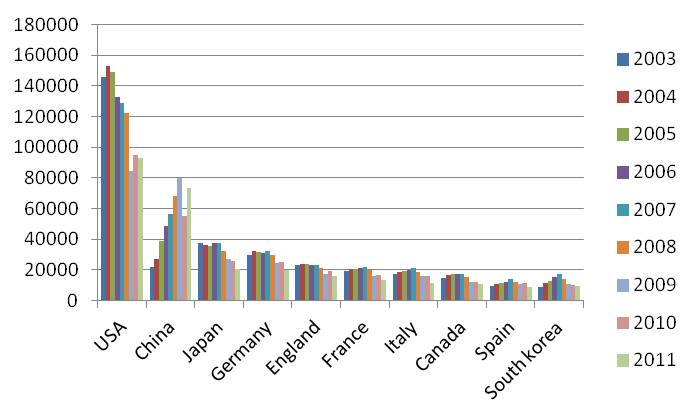

今天,我分析了近年世界主要国家发表会议论文情况(数据来源于ISTP数据库),让我好奇的是,10年中排在前10位的国家是相对比较稳定的。分别是美国、中国、日本、德国、英国、法国、意大利、加拿大、西班牙、韩国。对于这十个国家发表会议论文的情况如图1所示。

从这个图中,我们可以看出一些端倪。(1)从2004年开始,美国学者发表会议论文的数量在逐年减少。(2)从2008年开始,日本、德国、英国、法国、意大利、加拿大、西班牙、韩国这8个国家发表会议论文的数量在逐年减少。(3)从2003年开始,中国学者发表的会议论文数量每年成正比率增加。(4)中美学者发表的会议论文的数量差别越来越小。几年后,很有可能要超越。

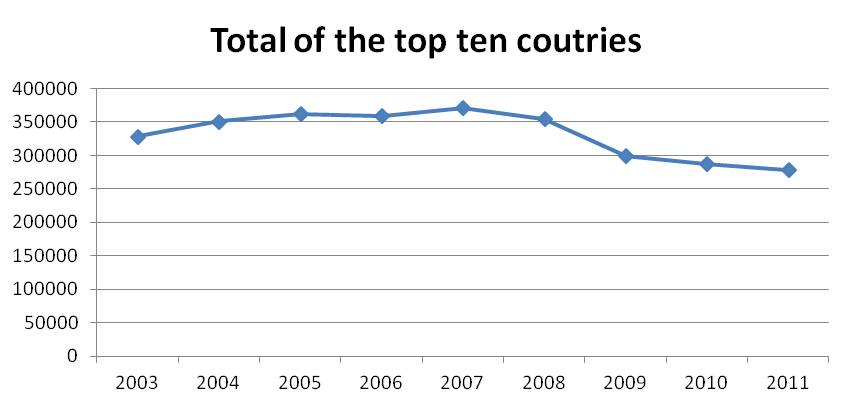

图2所示为近年前十个国家发表会议论文的数量变化趋势。其中,最高峰出现在2007年。从此以后,每年数量都在减少。到2011年时,会议论文数量减少了25%。其中美国学者会议论文减少最多,相对2008年减少29%,相对2004年减少40%。相对而言,中国学者的会议论文增加了30%。

现在,我们应该能够理解,为什么我国会议信息越来越泛滥了吧。或许是因为经融危机或者其它原因,欧美主要国家的学者参加会议均在减少,只有中国依然在持续增加。因此,任何一个有头脑的“会议出版商”,都会抓住中国学术界这一棵救命稻草不放的。这就是我们会议信息越来越多的原因。

写这篇博客的目的就是希望国内减少一些“不正规”的国际会议,不要让国际会议成为某些人、团体、出版商捞钱的工具。的确,我国科技工作者的经费就那么一点,经不起太多的“折腾”。花了钱,什么也没有学到,或者什么宣传作用也没有起到,不是很浪费吗?

除了会议论文,SCI学术期刊的论文数量还是必须重视的。虽然很多人会说,SCI论文数量没有用,但是,毋庸置疑,就目前学术而言,SCI学术论文还是国际学术界里面的“硬通货”。虽然,在国内我见过没有2篇SCI论文的人也能够获得国家自然科学基金资助,但是,在澳大利亚,这样的人可能连博士论文外审都艰难通过。

这篇关于中国成了国际学术会议论文最后一根救命稻草(转载)的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!

![[论文笔记]LLM.int8(): 8-bit Matrix Multiplication for Transformers at Scale](https://img-blog.csdnimg.cn/img_convert/172ed0ed26123345e1773ba0e0505cb3.png)