本文主要是介绍中国小伙在学术论文中求婚…论文致谢还能有哪些玩法?,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

听完后,她心里拔凉拔凉的!

她想,这大概是最婉转的分手了。

诚然,对于科研狗来说,发个影响因子很高的文章是很难的,但是在论文里求个婚还是很简单的嘛!

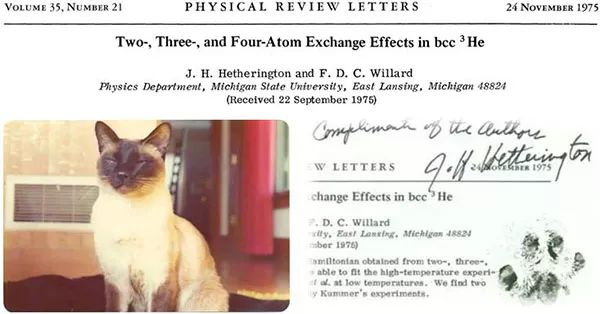

图片来源:论文截图

图片来源:论文截图仔细一看原来是一个来自中国的小伙在文章致谢部分向女友求婚,「Will you marry me?」

这或许就是科研狗的浪漫了吧!

最早在致谢里求婚的大佬就是生命科学的学者,看起来还挺帅的对不对?

图片来源:Caleb Brown 主页

图片来源:Caleb Brown 主页 不过他求婚的文章,影响因子也没上 10……所以,如果有人和你说发了 IF=10 的 paper 就结婚,还是果断分手吧!

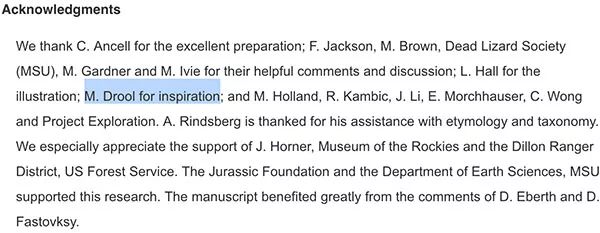

图片来源:论文截图

图片来源:论文截图其实关于在文章致谢部分求婚的栗子还有很多,比如西班牙生物学家 David Tamayo 在 Marine Biology 上发表的论文、南京中医药大学的小伙在 Scientific Report 上发表的论文,这里就不一一列举啦!

花样百出的致谢 通常在一篇学术论文中,如果我们在参考文献前停下来,大部分情况下会看到致谢部分,但一般情况下,这一段致谢会被读者和审稿人所忽视。

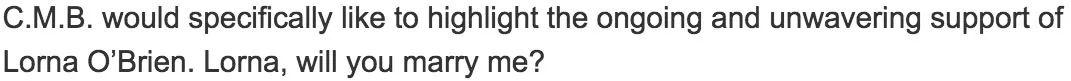

当然,也不是所有论文都有致谢部分的,此前 Paulhus 等人在 Plos one 发表的一个与论文致谢相关的研究表明,约有 67.1% 的文章结尾有致谢部分,其中以生物类的文章最多,约 83.6%。

图片来源:Plos one

图片来源:Plos one 致谢作为一个常常被人忽视的部分,其中彩蛋也不是一般的多。不论是对虚拟人物的感谢,还是自怨自艾的抱怨,抑或是犀利的评论,我们都可以在致谢中看到。

大多时候,文章里的致谢可能都是诚挚的感谢,但是有时在致谢背后往往藏着作者对编辑、对审稿人、对基金委员会、对导师或者实验室成员的满满埋怨!

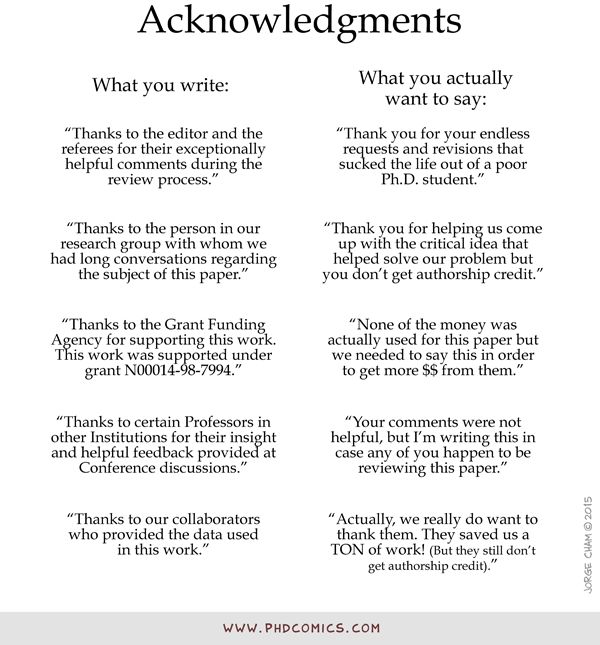

图片来源:phdcomics

图片来源:phdcomics 对基金委员会的吐槽

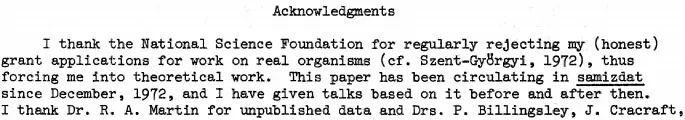

图片来源:论文截图

图片来源:论文截图 作者吐槽基金委不给予支持,只能转向理论研究,当然这篇理论性的文章,被引用了 2 500 多次!

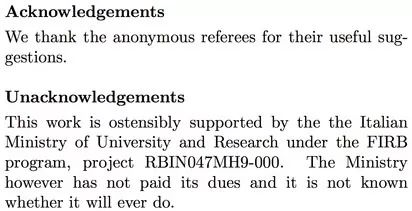

图片来源:论文截图

图片来源:论文截图 又比如这篇,作者吐槽了意大利的科学基金,虽然得了资助,但是没给钱,发空饷!

对著名人物的恶搞

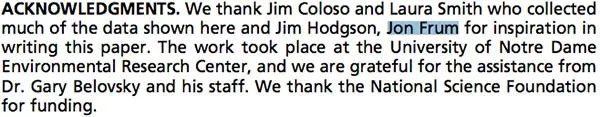

图片来源:论文截图

图片来源:论文截图 这一篇发在 PNAS 里的文章埋了一个彩蛋,Jon Frum 是一个邪教的领导人,自然不会对论文有啥贡献啦,这就是作者的恶作剧了!

图片来源:论文截图

图片来源:论文截图 和上面的那条类似,乍看之下,并没有啥问题!但是 Slayer 是一个美国著名的速度金属乐队,这篇文章发在 Science 上。

而且,这两篇文章都来自一个实验室,这个实验室有在致谢部分用部分假名和趣味词语的传统!果然是大牛搞怪都高端……

对同行们的嘲讽

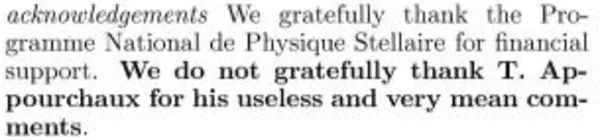

图片来源:论文截图

图片来源:论文截图  图片来源:论文截图

图片来源:论文截图 「我们不感谢 T. Appourchaux 的无用的、非常吝啬的评论。」

一言不合就开撕,科研人真的真性情啊!

感谢自己的宠物

图片来源:论文截图

图片来源:论文截图 这里的 Moe 是作者养的喵星人。不过这不算啥,要知道喵星人在 PRL 都是发过文章的!

图片来源:论文截图

图片来源:论文截图 还有感谢啤酒的,对,啤酒

图片来源:论文截图

图片来源:论文截图 图片来源:论文截图

图片来源:论文截图腾讯AI大战王者荣耀!504场1v1仅输1场,5v5达电竞职业水平

这 10 大基础算法,程序员必知必会!

送书 | 想要和华为揽入麾下的人才一样拿到200万年薪嘛?

常见 Python 代码优化技巧

ACL2019最佳论文奖出炉,华人包揽众多奖项

喜欢就点击“在看”吧!

这篇关于中国小伙在学术论文中求婚…论文致谢还能有哪些玩法?的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!

![[论文笔记]LLM.int8(): 8-bit Matrix Multiplication for Transformers at Scale](https://img-blog.csdnimg.cn/img_convert/172ed0ed26123345e1773ba0e0505cb3.png)