本文主要是介绍论文阅读——《Deep learning methods for molecularre presentation and property prediction》,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

目录

前言

一、分子表征

1.基于序列的表示(sequence-based representation)

SMILES(Simplified Molecular Input Line Entry System)字符串

分子指纹(Molecular fingerprint)

2.分子2D数据(molecular 2D data)

分子图数据(molecular graph data)

分子图像数据(molecular image data)

3.分子3D数据(molecular 3D data)

分子图(3D molecular graphs)

分子网格(3D molecular grid)

二、基于序列的方法

1.数据扩充方法(Data augmentation methods)

2.卷积神经网络模型(Convolutional neural network models)

3.递归神经网络模型(Recurrent neural network models)

4.子结构学习方法(Substructure learning methods)

5.基于序列的自监督学习方法(Sequence-based self-supervised learning methods)

三、基于图形的方法(Graph-based methods)

1.光谱GCN模型(Spectral GCN models)

2.空间GCN模型(Spatial GCN models)

3.基于树的模型(Tree-based methods)

4.基于图的自监督学习方法(Graph-based self-supervised learning methods)

四、基于图像的方法(Image-based methods)

五、基于三维图形的方法(3D Graph-based methods)

六、基于三维网格的方法( 3D Grid-based methods)

七、基于数据的混合方法与集成学习( Hybrid data-based methods and ensemble learning)

八、迁移学习、多任务学习和元学习( Transfer learning, multi-task learning, and metalearning)

九、DL模型在分子性质预测中的可解释性(Interpretability of the DL model on molecular property prediction)

十、分子性质预测的挑战和未来的工作(Molecular property prediction challenges and future work)

1.三维数据中的自监督学习方法(Self-supervised learning methods in 3D data)

2.有经验的图形卷积方法(Graph convolution methods with experience)

3.1D、2D和3D数据融合和选择方法(1D, 2D, and 3D data fusion and selection methods)

4.元学习方法(Meta-learning methods)

5.DL模型的可解释性(The interpretability of DL models)

总结

前言

这是一篇发表在DrugDiscoverToday(2022中科院二区,属于Elsevier出版社旗下)上的一篇关于分子表征和性质预测的综述。

这篇综述中总结了深度学习(DL)方法在分子表征和性质预测方面的当代应用。并根据分子数据的格式(1D、2D和3D)对DL方法进行分类。还讨论了一些常见的DL模型,如集成学习和迁移学习,并分析了这些模型的可解释性方法。还强调了DL方法在分子表征和性质预测方面的挑战和机遇。

一、分子表征

1.基于序列的表示(sequence-based representation)

-

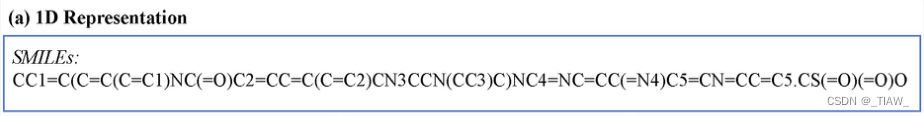

SMILES(Simplified Molecular Input Line Entry System)字符串

在SMILES字符串中,原子和化学键分别用字母和标点符号表示,分支用括号描述。 C30H35N7O4S

然而,由于SMILES字符串可能不对应于有效分子,因此提出了自参考嵌入字符串(SELFIES)来解决这个问题,其中每个SELFIES字符串对应于有效分子。

-

分子指纹(Molecular fingerprint)

指纹是另一种基于序列的分子表示,它包含分子结构信息,如扩展连接指纹(ECFP)和分子访问系统(MACCS)。它们通常被用作传统ML方法的输入或与其他类型的数据相结合的辅助输入。

尽管SMILES字符串简单快速,但它仍然无法全面捕捉原子之间的空间关系。在C=C5苯环中,五个碳原子被分组为C5;然而,不同的碳原子与其他原子有不同的关系,并且位于分子中的不同位置。此外,它们可能对应不同的性质。因此,仅使用SMILES不足以预测某些性质。

分子指纹(Fingerprint)和SMILES(简化分子线性输入规范化系统)是描述分子结构的两种不同方法,它们之间存在着关联。

SMILES通常被认为是一种字符串表示法,用于将分子描述成一个可读的字符串。在SMILES表示中,分子中每个原子都用一个字母或数字表示,而分子中的链、支链和环则用括号表示。因此,SMILES提供了一种方便的方式来存储分子结构,并且易于进行自动处理和分析。

相对地,分子指纹是一种数学描述符号,主要通过对分子中的某些化学特征进行计算得出。不同于SMILES,分子指纹将分子结构转化为一系列数字或位向量,以此表示分子的结构信息。这些特征通常包括原子和分子的电荷、大小、极性等,旨在刻画分子所具备的一些重要化学特征。

虽然SMILES和分子指纹并不是直接相关的概念,但在实际应用中,SMILES常常是用来作为计算分子指纹的输入格式之一。例如,许多化学信息学软件(如RDKit、ChemAxon等)都可以将SMILES格式的分子自动转换为其对应的分子指纹,以实现各种计算机辅助化学(Computer-Aided Chemistry)任务,如药物筛选、毒理学评价、分子分类等。因此,SMILES和分子指纹可以说是在化学信息学领域中相辅相成的两种描述方式。

但它们也有各自的缺点。

首先,分子指纹存在着诸如维度灾难和数据稀疏性等问题。因为每个指纹都需要通过计算得到,而不同的指纹方法往往会产生大量不同的特征,这使得指纹长度急剧增加,导致训练模型所需的存储空间和计算成本都大幅提高。此外,由于分子指纹通常是二进制或实值向量,在大多数情况下,任何两个分子之间的指纹都具有很少的共享特征,这使得使用分子指纹进行分类和回归任务时存在严重的数据稀疏性问题。

其次,SMILES表示法也存在一些缺陷。首先,SMILES只记录了粗略的分子结构信息,对于分子的微观特征无法体现,这在进行一些高级应用时可能会带来一定的困难。另外,由于SMILES格式的字符串序列可以有多种不同的编码方式,不同软件中解释同一个分子的SMILES序列可能会有差异,这会影响在不同平台上进行分析和处理的可靠性和准确性。

2.分子2D数据(molecular 2D data)

-

分子图数据(molecular graph data)

图形数据是学习分子表示的一种有效方法。分子的原子被视为分子图中的节点,而化学键被视为边。随着图卷积网络(GCN)的发展可以更直接、更有效地收集相邻节点的信息,这有助于捕捉分子内原子之间的空间关系。

-

分子图像数据(molecular image data)

通过将分子转换为基于像素的光栅化图像而获得的分子图像是分子的另一种2D表示格式,图像中的每个像素表示键、原子或空白背景。

分子图数据(molecular graph data)和分子图像数据(molecular image data)是描述分子结构的两种不同方式。

分子图数据通常采用基于图论的方法表示分子,将原子之间的化学键和它们之间的拓扑联系转换为数学图中的节点和边。分子图可以作为分子的结构描述符号,为计算机辅助化学研究提供了一个统一、可执行的平台,可用于分子识别、分类、性质预测等方面。例如,CDK(Chemistry Development Kit)、OpenBabel等化学信息学软件都支持处理分子图数据。在分子图表示中,每个原子被表示为一个节点,原子之间的化学键则表示为连接节点的边。

相比之下,分子图像数据着重于显示出分子的几何结构,通常由二维或三维图像组成;这些图像显示了分子的形态以及原子之间的相对位置,尤其在三维空间中。分子图像的获取需要通过实验手段,如光学显微镜、X射线衍射、电子显微镜等。分子图像使我们能够观察到分子层次上的细节,从而对分子结构和功能进行更深入的理解和研究。

总的来说,分子图数据和分子图像数据构成了计算机辅助化学研究中描绘分子结构的两种主要方式。分子图数据用于计算机进行快速处理和分析,而分子图像则帮助人们直观地理解分子的空间几何结构。

3.分子3D数据(molecular 3D data)

-

分子图(3D molecular graphs)

3D分子图记录了每个原子的3D位置。

-

分子网格(3D molecular grid)

3D分子网格是一种特殊的3D图像,其中网格中的体素通过不同的方法指示分子构象的不同元素或属性。

3D分子图(3D molecular graphs)和3D分子网格(3D molecular grids)是描述分子结构的两种不同方式,都涉及到新兴的计算机模拟技术。

3D分子图是一种基于分子结构信息的三维表示方法,可以用来捕捉分子之间的化学特征并帮助分析分子在空间中的排列。它与传统的平面分子图相比,在表达分子中原子的位置、相对距离以及键角等方面更加精确。

3D分子网格是一种将分子封装在规则网格中的三维表示方法,使得分子中各个元素在体积上被划分为许多不同的小区域或单元格,每个单元格被赋予了一些物理或化学属性的值。这种方法可以使得分子之间相互作用的强度在空间上呈现出连续性,从而更加真实地反映分子与周围环境的相互作用。3D分子网格常用于分子对接、药效预测等领域。

当然,3D分子图和3D分子网格都有着自己的优缺点。3D分子图能够准确地描述分子的几何结构和化学键角度信息,但如果分子过于复杂,三维结构的计算过程可能会非常耗时和困难;3D分子网格较好地反映了分子与其周围环境的相互作用,在分子识别、分子对接等领域有着不可替代的作用,但它也会带来少量的计算误差并需要更多的计算代价。

总的来说,3D分子图和3D分子网格在描述分子结构方面各自有其优缺点,具体应用还需考虑问题的实际情况和需求。

二、基于序列的方法

SMILES是描述分子最直接、最简单的方法。它类似于自然语言,其中每个原子都是句子中的一个单词。鉴于自然语言处理(NLP)领域的快速进展,NLP方法可以应用于SMILES序列的嵌入。

1.数据扩充方法(Data augmentation methods)

在使用DL模型处理SMILES之前,必须克服SMILES中的不一致性。对于一个分子,根据SMILES语法,可能有许多有效的SMILES序列。起始原子和遍历顺序可能对应于一个序列;因此,我们可以选择任何原子作为起点,选择任何分支作为第一个通过的原子。标准SMILES确保每个分子根据某些规则只有一个SMILES字符串。然而,当使用非规范SMILES作为输入时,相同分子的各种SMILES格式可以增强DL模型的学习能力。这是因为非规范SMILES还可以通过提供与SMILES语法和化学性质相关的潜在特性来为DL模型带来好处。因此,建议增加数据或枚举以扩大字符串的覆盖范围,从而确保模型能够学习分子的多个字符串。

考虑到每个分子都有不同的长度,与长字符串相比,短字符串的可能符号更少。在Conv2S中,随机连续生成SMILES字符串,直到L^N/(L+1)<1%,其中L和N分别是生成的SMILES的长度和数量。为了克服数据集不平衡的问题,具有较少SMILES字符串的分子由重复的SMILES串来补充,以确保所有分子具有相同数量的SMILES串。Kimber等人对五种不同的SMILES增强方法进行了全面分析。他们发现,增强方法提高了DL模型的性能,并且使用规范SMILES所获得的结果优于使用单个随机SMILES。

2.卷积神经网络模型(Convolutional neural network models)

卷积神经网络(CNNs)可以用于序列数据处理。例如,ConvS2S模型将SMILES转换为整数列表,然后添加位置嵌入以通知模型对应字母的位置。

Lim等人还对SMILES进行了字符级嵌入,其中为每个字母生成嵌入向量。引入了一个带有多头自注意模块的CNN层来处理输入嵌入,并添加了两个完全连接的层来输出预测。SMILES卷积指纹(SCFPs)结合了多原子性质,包括类型、度、电荷和手性,形成原子的特征向量。SMILES序列可以转换为矩阵,矩阵的长度是SMILES顺序的最大长度。构造了两个卷积和池化层以及随后的全局池化层来提取表示,并且相应滤波器的大贡献通过回溯指示了重要的子结构。

考虑到基于CNN的方法需要固定长度的输入样本,在将药物SMILES发送到网络之前,必须对其进行填充或截断。通常,数据集中SMILES串的最大或平均长度可以被选择为模型输入样本的固定长度。然而,这两种方法都会导致数据丢失和噪声的引入,这是基于CNN的方法的主要问题之一。

3.递归神经网络模型(Recurrent neural network models)

递归神经网络(RNN)和变体,如长短期记忆(LSTM)和门控递归单元(GRU),在NLP中被广泛用于处理序列数据。为了处理分子序列数据,SMILES序列的精确和稳健的RNN模型对于提取分子特征至关重要。Hou等人提出了一种双向LSTM(Bi-LSTM),通过贝叶斯优化改进了通道和空间注意力网络,可以专门识别SMILES序列中的素因子。Nazarova等人提出了RNN的两种反向传播方法,并比较了SMILES的二进制和十进制表示在聚合物性能预测中的性能。他们发现二进制表示法比十进制表示法更准确。CNN和RNN的结合也可以提高表示的性能。Li等人使用一个热编码将SMILES中的每个字符转换为向量,并引入了堆叠的CNN和RNN层的混合架构来进行表示提取。据报道,与普通RNN模型相比,CNN能够提高预测性能。

尽管RNN适用于序列处理,但仅使用序列而忽略其他信息(如化学背景或分子结构)并不是学习分子表示的综合方法。特别是,分子内的原子关系、原子基团以及键类型也可能与分子性质有关,可以通过某些方式引入分子性质来提高性能。

此外,使用序列的模型的可解释性仍然存在缺陷。鉴于分子分支与主序列融合,在没有其他更具体的设置的情况下,RNN模型很难区分基序和分支;因此,来自同一官能团的键原子可能位于彼此远离的位置。即使引入了注意力机制,它也只关注单个字母或相邻字母。

4.子结构学习方法(Substructure learning methods)

通常,官能团是分子的关键部分,分子的性质和活性与官能团和亚结构密切相关。然而,SMILES序列并不直接包含这种类型的信息;因此,已经开发了专注于隐藏在SMILES中的官能团的方法。SMILES对编码学习高频SMILES子串的词汇表,并根据所学习的词汇表转换SMILES,该词汇表可以被馈送到DL模型中。Mol2Context-vec35在ECFP的帮助下提取亚结构。该亚结构包括多个原子,包括一个中心原子和围绕该中心原子的给定半径内的所有原子。每个子结构都有自己的标识符。子结构序列是BiLSTM的输入,它捕捉原子团之间的相互作用。

Mol-BERT将每个子结构的向量总结为无监督学习和下游任务的分子表示。S2DV37定义了一个分割字符来保留子结构信息,以及一个具有预定义大小的滑动窗口来处理序列。指示单个原子的分支链和双字符被单个字符取代,并且每个分支都以相同的方式进行扩展和处理。

每个滑动窗口生成一个向量来描述化合物及其子结构之间的关系。

5.基于序列的自监督学习方法(Sequence-based self-supervised learning methods)

近年来,自我监督学习(SSL)发展迅速。SSL可以使用大量未标记的数据集,并设计借口任务来学习数据的内在特征,从而减少对标记样本的需求。一般来说,基于序列的SSL模型可以分为对比学习方法和生成学习方法。对比学习方法是构建伪标签数据来学习正样本和负样本之间的差异,而生成方法将输入编码为潜在特征并对其进行解码以重建输入,从而可以将潜在特征用作输入的表示。从数据信息的角度来看,对比学习方法试图找到数据间信息,而生成学习方法侧重于数据内信息。

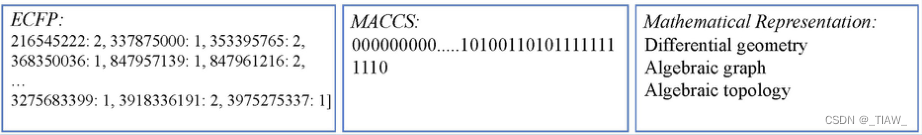

在NLP领域,来自变换器的双向编码器表示(BERT)是一种广泛使用的学习单词特征的SSL方法,其中变换器包括编码器和解码器。类BERT方法可以应用于SMILES序列中,以提取原子或分子特征(图2a)。MOL-BERT结合了三个任务来生成分子表示。第一个是BERT中使用的掩蔽语言模型(MLM)。第二种是SMILES等效方法,它使用来自相同分子的两个SMILES序列作为一类,使用不同分子的两种SMILES顺序作为另一类进行训练。第三种是利用分子化学特性进行预测。所有三个模型都被联合训练以输出分子表示。SMILES-BERT也基于BERT,但只保留了MLM,并引入了自注意层来使用顺序信息。

除了基于BERT的方法外,还有其他使用编码器和解码器架构进行分子表示的生成方法。Hu等人使用基于GRU的编码器-解码器生成模型来生成固定大小的潜在特征,以表示SMILES中的分子,并为下游预测任务引入了CNN模型。分子预测模型微调(MolPMoFiT)使用语言模型根据单词序列预测下一个单词,这也可以提取下游任务的特征。

NLP中使用的翻译模型也可以在SMILES序列数据中实现(图2b)。序列到序列(seq2seq)是一种流行的工具,包含用于翻译任务的编码器和解码器,其目的是将一个序列转换为另一个序列。类似地,编码器的输出也可以是其他任务的表示。当对SMILES使用seq2seq方法时,主要目标是找到两个对应的序列进行训练。Winter等人提出了一种翻译分子结构的两种语义等效表示(即SMILES和IUPAC名称)的方法。

Transformer-CNN训练一个Transformer模型来执行SMILES规范化任务,其中输入是非规范SMILES,输出是相应的标准SMILES。

因此,SSL是一种很有前途的方法,因为它能够在没有标签的情况下发现输入数据的内部特征。对于基于序列的SSL方法,仍然缺乏有助于发现SMILES字符串之间相互关系的对比学习方法,这是分子表示研究的未来方向。

三、基于图形的方法(Graph-based methods)

图是一种更直接的结构,可以存储和表示大多数结构信息。在图模型中,原子被设置为节点,键被设置为边,每个节点都有自己的特征。在图数据的帮助下,分子内的结构信息可以被GCN使用,GCN是为非欧几里得图数据设计的。它们能够捕获有关连接节点之间关系的信息。一般来说,GCN有两种类型:空间卷积和光谱卷积。前者通过使用空间域中的某些消息传递规则收集关于其相邻节点的信息来更新每个节点的特征。后者通过对拉普拉斯矩阵进行特征值分解,将图数据转换到谱域。

1.光谱GCN模型(Spectral GCN models)

我们首先介绍了光谱GCN方法。LanczosNet使用Lanczos算法为图谱卷积建立拉普拉斯算子的低秩近似,可用于利用多尺度信息和设计可学习的谱滤波器。Shang等人从Chebyshev近似中提出了一个具有新的灵活频谱滤波器的一致边缘感知多视点频谱GCN模型;根据边的类型将分子图分解为图的多个视图,并使用学习边的注意力权重的一致边映射方法来确保边的一致性。

因此,在分子表示和性质预测方面,光谱方法比空间方法更少。这是因为具有不同原子的分子会产生不同大小的图,而光谱GCN模型只能处理固定大小的图。因此,在处理输入图数据样本时,仍然需要进行数据对齐操作,如填充或截断,这将损害数据的完整性并影响模型的最终性能。

2.空间GCN模型(Spatial GCN models)

空间GCN模型在药物发现和MPP中得到了更广泛的应用。通常,空间GCN模型需要两个矩阵作为输入:一个相邻矩阵和一个特征矩阵。前者表示分子内原子的空间互连,可以从分子图中获得,而后者通常由不同的方法定义。DeepAtomicCharge使用具有跳过连接的消息传递神经网络(MPNN)来预测原子电荷。AttentiveFP是另一种源自GCN的分子表示方法,它自动学习非局部分子内相互作用,并通过注意力机制捕捉特定任务的隐藏边缘。Multiphysical GNN结合了尺度特定的图神经网络和元素特定的图神经元网络,以捕获来自不同尺度的各种原子相互作用,用于多物理表示。

边缘也被认为是卷积过程中应该考虑的一个重要元素。交叉依赖图神经网络认为原子和键同样重要。构造了原子中心视图和键中心视图,并提出了两个视图之间的交叉依赖消息传递方案。TrimNet提出了一种三元边缘网络,通过原子-键-原子排列来收集信息,以改进边缘信息的提取。一对原子以及它们之间的键被连接成三元组,多头注意力用于从节点的相邻节点和边缘收集节点的信息。

有向图是一种特殊类型的图,它包含指示消息传递方向的有向边。这种性质通常用于处理过度光滑的问题,这在图学习模型中经常发生。例如,边缘记忆神经网络专注于传递边缘而非节点的消息。每条边都具有对应于两个相反方向的两个状态;因此,每个状态仅基于其上游节点进行更新,从而避免了过度平滑问题带来的有用信息的消失。

3.基于树的模型(Tree-based methods)

通过选择起始原子,可以将图转换为树结构,从而打破图的圆圈并提供图的另一个视图。此外,根据广度优先搜索(BFS)或深度优先搜索(DFS)方法,可以使用RNN模型将树转换为原子序列进行表示学习。

Su等人和Wang等人都开发了基于分子树结构的QSAR建模方法。分子被编码为特征描述符,树结构长短期记忆(tree-LSTM)用于描述分子树数据结构,并将其与分子财产关联。

Junction Tree首先将分子分解为子结构,然后基于这些子结构生成树结构图。尽管提出了用于分子生成的连接树,但编码器部分可以分离用于性质预测。受此启发,Wang等人提出了一种基于多通道树的分子预测方法。将分子转化为基于子结构的图,并应用BFS方法遍历图以生成树结构。然后应用具有注意力机制的基于GRU的神经网络来学习多个层次的分子特征。

然而,由于不同的遍历方法,如BFS或DFS,以及不同的根原子选择方法,树结构不是唯一的。生成的分子树的多个结构会影响模型的泛化。规范结构的定义是不稳健的,并且不能确保所有与属性相关的信息,特别是连接信息,在结构中得到全面展示,因为将图转移到树将不得不破坏一个或多个连接。

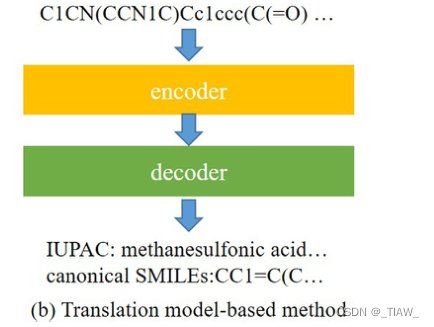

4.基于图的自监督学习方法(Graph-based self-supervised learning methods)

与序列数据上的性能类似,SSL方法在图形数据上也取得了显著的性能。Wu等人在图数据上定义了另一种类型的SSL方法,即预测方法,该方法基于自我生成的标签设计基于预测的预训练任务。

在对比学习方法中,如何构建正样本和负样本是至关重要的一步。在这方面,MolCLR以三种方式增强了分子:原子掩蔽、键缺失和子图去除。来自同一分子的样品被表示为正对,其他样品被表示成负对,用于对比损失计算。然而,MOCL认为,节点下降、边缘扰动和子图提取等增强方法会影响分子的财产,不适合于对比学习。相反,MOCL采用了一种亚结构替换策略,即用具有类似财产的生物异构体替换亚结构。在NLP域中,许多特征是在单词和句子级别提取的。NLP中的这两个级别类似于图中的节点级别和图级别,它们分别表示局部和全局特征。Li等人在节点和图级别上对模型进行了预训练。在图形级别,每个分子被分解为两部分,模型需要预测这两部分是否来自同一分子。分子图对比学习方法的过程如图所示。

生成方法通过编码器-解码器模型重建输入。分子图BERT将局部消息传递和GNN结合到BERT模型中进行预训练。Koge等人使用分子超图文法变分自动编码器(VAE)提取分子嵌入,将分子结构和物理财产嵌入到VAE的潜在特征中。基于分子图的生成学习方法的过程如图所示。

MPP中通常使用的预测模型用于预测节点或边的类型或属性。GROVER结合了两级SSL。在节点/边缘级别定义的第一个SSL任务是预测子图的属性。在图形级别定义的第二个SSL任务是预测不同基序的出现;结合这两个层次可以提供关于分子的结构和语义信息。此外,SSL和监督学习的结合为理解分子提供了一种新的方法。例如,SUGAR67结合了基于子图的监督和SSL方法,并且来自分类和互信息最大化的两个损失被分组到最终损失函数中。评估结果表明,SSL的引入提高了模型的性能。基于分子图的预测学习方法的过程如图所示。

四、基于图像的方法(Image-based methods)

DL方法在图像处理领域取得了巨大的成功,这也为QSAR/QSPR提供了启示。更具体地说,可以将分子转换为图像,从而使传统的DL模型可以用于QSAR/QSPR任务,其中CNN是最广泛用于分子特征提取的模型。

对于基于图像生成的方法,最简单的方法是直接使用分子图像,可以通过软件进行转换,如RDKit和Open Babel。然而,这种类型的图像在没有有效信息的情况下引入了很大的空白区域。

此外,尺度敏感性是另一个问题,因为所有分子都被转换成相同大小的图像。换句话说,由于整个分子图像的大小固定,相同原子/结构的大小在不同分子中是振动的。

其他图像生成方法试图避免这个问题。Yoshimori等人为每个原子生成了一个图谱,并通过将所有原子图谱相加作为28*28热图。MolMap将分子描述符和指纹特征映射到2D特征图中,从而产生了一种将手工制作的特征组合到2D空间中以捕捉分子特征的内在相关性的方法。

频域是图像处理中的另一个重要领域。Tchagang等人通过频域方法将分子转换为图像。他们首先将分子转换为一维库仑矩阵,然后引入时间-频率类(TFL)方法生成TFL图像,可以对分子的结构、几何、能量、电子和热力学财产进行编码。MolPSI是一种基于光谱图模型的等尺寸分子2D图像表示方法,其中使用过滤过程来生成一系列多尺度拓扑表示和几何信息。

此外,分子图像已被用于通过预训练的模型检测官能团,该模型被进一步微调以用于活性悬崖预测。提取学习到的权重,以突出区分形成活性悬崖对和非活性悬崖对的化合物的关键官能团。

因此,基于图像的方法不是MPP的主流,因为它们必须将数据样本转换到欧几里得空间,由于缺乏原子和键属性,欧几里得空间不适合分子性质预测。然而,近年来已经提出并开发了基于图像的DL模型。为了利用基于图像的DL模型,能够从某些角度发现原子之间关系的图像生成方法值得进一步研究,这将有助于生成新的有效分子表示。

五、基于三维图形的方法(3D Graph-based methods)

分子的构象通常包含分子的原子三维坐标,也被称为其几何数据,可以为MPP提供额外的空间信息。要解决的第一个问题是3D分子构象数据集是有限的。为了扩大基于几何的方法的应用领域,在二维数据集上引入了构象生成。嵌入RDKit中的Merck Molecular Force Field(MMFF94)可用于构象生成。此外,提出了哈密顿神经网络来预测分子的构象,并将预测的三维坐标输入到基于MPNN的指纹生成器中用于分子表示。

然而,与基于1D和2D的方法相比,专注于基于几何的数据的方法仍然相对较少。与2D数据类似,基于几何的方法也分为两类:基于3D图的方法和基于3D网格的方法。

基于三维图的方法主要通过引入几何信息来调整或改进GCN。除了相邻矩阵和特征矩阵外,3D-GCN引入了包括原子间3D位置的相对位置矩阵,以确保卷积过程中的平移不变性。结果表明,在没有额外增强方法的情况下,训练后的模型具有旋转随机性的内在特征。Lu等人设计了一种GCN,从分子的构象和空间信息捕获多级量子相互作用。在模型中依次涉及相邻节点的不同阶数,以确保节点表示可以覆盖更高阶的交互。然而,与社交媒体和引文网络图等其他大型图数据不同,分子图中的节点数量是有限的。在某些情况下,高阶邻居可能会覆盖分子中的大量原子,从而导致过度光滑(见上文)。

为了解决三维图中的消息传递问题,提出了球形消息传递方法。具体地,每个原子的3D坐标被转换为球面坐标系,并且原点节点的相邻节点由包括边长、边之间的角度和扭转角的三元组指定。与普通的三维坐标相比,三元组更灵活,能够更准确地描述分子的结构。球形消息传递对输入分子的平移和旋转是不变的。此外,几何消息传递神经网络(GemNet)80还使用分子的球形表示来确保模型对平移是不变的,对排列和旋转是等变的。

此外,SSL方法是基于3D图形的方法的一个重要分支,用于发现图形的不同特征。Fang等人提出了一种充分利用分子几何信息的自监督框架。他们构建了一个新的键角图,其中分子内的化学键被视为节点而不是边,而两个键之间形成的角度被视为它们之间的边。对某些原子的1-跳邻域的项目进行掩蔽,用于键长和键角预测,以提取局部表示。Liu等人提出了一种SSL方法,该方法包含分子的3D和2D视图之间的对比学习和生成学习方法。在对比学习中,来自同一分子的3D和2D图都被视为训练模型的正对。在生成学习中,对模型进行训练,以从其2D拓扑生成3D构象。

这两种策略结合在一起进行分子表征。

六、基于三维网格的方法( 3D Grid-based methods)

3D网格是另一种使用分子几何数据的表示方法,它将每个原子放置在网格的一个或多个体素中。事实上,蛋白质等大分子可以用3D网格更好地表示,但此类数据在MPP中仍显示出良好的性能,尤其是在某些量子力学财产方面。3D CNN是3D网格数据的最佳选择;因此,一个更强大、信息量更大的3D CNN网格可以提高MPP的性能。

Libmolgrid提供了一个库来生成3D分子数据的体素网格以表示分子。网格的分辨率是影响结果的一个重要因素。多分辨率3DDenseNet使用以原子为中心的高斯密度模型来创建3D网格,并生成具有不同尺度(4–14Å)的多通道网格作为3D DenseNet处理和预测的输入数据。Casey等人还通过使用高斯模型生成了两个3D空间点网格(电子电荷密度和静电势)。旋转增强方法也应用于上述两种方法,以放大训练数据集,而不是改变大小,Tran等人选择C、H、O、N、S和Cl作为3D网格的独立通道,并使用基于CNN的自动编码器进行分子表示。

Kuzminykh等人发现,规则的三维分子网格过于稀疏,影响了CNN的性能,并提出了一种波变换平滑方法来填充每个原子的相邻体素。

因此,仍然缺乏用于MPP的基于3D图和基于3D网格的方法,并且所需的长分析时间是一个严重的问题,尤其是对于基于3D网格方法而言。此外,对3D图形数据的图形卷积仍然是一个悬而未决的问题。

通过简单地添加3D位置信息将传统的GCN方法扩展到3D场景并不能充分利用几何数据的优势。尽管球形消息传递试图在3D图上拟合特定的GCN,但这仍然是设计3D图消息传递机制的一种很有前途的方法。

七、基于数据的混合方法与集成学习( Hybrid data-based methods and ensemble learning)

所有上述的1D、2D和3D表示方法都以不同的方式呈现分子,并且将它们组合可以提供分子的多视图。GraSeq结合了分子图和SMILES序列,并使用GCN和biLSTM进行编码。Karim等人将SMILES、指纹、分子图、2D和3D描述符与多个DL模型相结合,用于定量毒性预测。通常,指纹被视为一个流行的辅助因素,基于图像的和基于图形的方法都结合了指纹来提高预测性能。

集成学习还可以连接多个分类器,以提高联合模型相对于每个单独分类器的性能。Kosasih等人建立了一个由三个GIN组成的集合。Busk等人还建立了多个MPNN的集合,这些MPNN用随机参数初始化,并在同一数据集上单独训练。此外,他们使用所有分类器的方差来表示预测的不确定性,校准结果提高了模型的性能。Karim等人将SMILES字符串转换为指示每个字符不存在的一个热向量,将分子图像和2D数字特征作为输入,并分别在这三种类型的数据上训练RNN、CNN和全连接神经网络。这些网络的输出通过集成平均方法或元神经网络进行组合。

八、迁移学习、多任务学习和元学习( Transfer learning, multi-task learning, and metalearning)

实验数据集的不足是MPP中的另一个问题。使用来自其他域的大型数据集来帮助找到数据较少的目标域的模式将有效地克服这个问题。迁移学习、多任务学习和元学习都被建议用于此目的。

对于迁移学习,首先在大型数据集上为某些借口任务训练模型,从而学习分子的一般表示。然后将学习到的一般表示用于下游任务(通常具有有限的样本),以传递先验知识。MRlogP在大数据集(500000个分子)上对低精度预测的logP值使用迁移学习,并且在244个类药物化合物的小精度数据集上对参数进行微调。在计算机视觉领域,迁移学习在ImageNet数据集的帮助下更频繁地使用,该数据集提供了超过1000 000张图像。Zhong等人在ImageNet上使用预训练的模型,并将其转移到用于QSAR任务的分子图像数据中。

多任务学习同时训练所有任务并共享表示,以提高预测的泛化能力。Liu等人利用多任务学习从QM9和炼金术数据集预测12个量子化学财产。此外,在框架中选择了一个以原子为中心的对称函数作为辅助预测目标,以提高其可推广性和可转移性。

近年来,出现了元学习方法来解决少镜头问题,也称为“学习学习”。在训练过程中,元学习将训练数据集划分为不同的元任务,以学习初始化良好、泛化能力强的模型参数。通过在新任务上进行少量梯度下降来更新模型,以提高模型的性能。例如,MetaMGNN结合了Tox21中的图神经网络、SSL和任务权重感知元学习,以及用于MPP的SIDER中的六个任务。Wang提出了一种考虑不同分子财产和不同分子子结构之间关系的属性软件嵌入方法,并且元学习方法选择性地更新任务中的参数,以分别建模通用和属性软件知识。

因此,这三种类型的学习方法都可以找到不同任务之间的关系,并解决数据有限的问题。通常,迁移学习方法可以使用大规模数据集,如ChEMBL和ZINC来学习分子的通用表示,并对其进行微调以适应特定的数据集。多任务学习通过同时学习几个相关任务来提高模型的泛化能力,而元学习预测数据有限的看不见的任务,这在MPP领域对少镜头问题很有希望,并避免昂贵、耗时和费力的实验数据收集。

九、DL模型在分子性质预测中的可解释性(Interpretability of the DL model on molecular property prediction)

DL最具争议的领域是它的可解释性。可解释的DL方法分为两类:被动和主动。被动方法使用DL模型中的参数进行解释,而主动方法改变训练过程以提高模型的可解释性。Jiménez-Luna等人指出,透明度、合理性、信息性和不确定性估计是人工智能方法在药物设计中可解释性的主要方面。

Pope等人评估了三种关于GCN的显著可解释性方法,并报告了显著子图可以被解释为官能团。酰胺、三氯甲基、磺酰胺和芳香结构都通过可解释性方法突出显示。Jiménez-Luna等人提出了一种特征归因方法,使用经过训练的MPNN模型为每个节点生成重要性分数,并根据原子的重要性分数对其进行着色。该方法可以识别药效团基序,并对性状悬崖进行识别。

对于分子性质预测,被动方法仍然是理解分子精确亚结构与其性质之间关系的主要方法。注意力机制可以学习输入的不同部分的权重,以确保DL模型能够专注于重要部分。注意力机制的概念也可以用于DL模型的可解释性,该模型可以找到重要的原子或基团及其对分子性质的相应贡献。例如,Tang等人可视化了自我注意值,以检测分子的哪些部分对其亲脂性或水溶性有贡献。Wu等人开发了一个用于毒性预测的多任务图注意力框架。该框架提取了分子子结构的特征,每个子结构都被分配了一个注意力权重。检测到最高权重的亚结构,如酰氯、氨基脲、亚硝酸盐和亚硝酰胺(称为结构警报)。

此外,不确定性估计是评估模型可靠性的重要方法。Ryu等人使用贝叶斯GCN预测分子财产。它用“混凝土”脱落代替了标准脱落,并通过贝叶斯方法估计了模型的不确定性。作者发现,不确定性可以作为预测的置信度指标。Hirschfel等人评估了分子性质预测的许多不确定度估计量,并提出将多个弱不确定性估计量结合起来可以导致更一致的性能。

十、分子性质预测的挑战和未来的工作(Molecular property prediction challenges and future work)

1.三维数据中的自监督学习方法(Self-supervised learning methods in 3D data)

SSL方法是发现分子独特特征的一个很有前途的方向。近年来,人们提出了基于1D数据和2D数据的方法,并取得了相对较好的性能。对于SSL方法来说,借口任务的设计是最关键的一步。然而,隐藏在3D分子数据中的丰富信息仍有待充分利用。D SSL方法已经在许多领域得到了应用;因此,设计一种新的分子3DSSL方法对于预测分子财产非常有用。此外,虚拟筛选用于寻找具有高结合亲和力的配体-靶标对,这是药物发现和设计的关键步骤。1在虚拟筛选软件中,需要靶标和配体的构象。因此,准确而全面的分子3D表示也将有助于虚拟筛选。

2.有经验的图形卷积方法(Graph convolution methods with experience)

GCN方法由于其在图形数据上的优异性能,已成为分子相关任务中的主流方法。然而,仍有改进的空间,例如引入经验数据和专家知识。我们不能忽视人类经验对DL模型的影响,有一些方法可以通过定义原子、键和官能团的类型将专业知识注入到模型中。6然而,一些高级或复杂的领域经验在MPP中可能更加强大,例如模体和财产之间的关系,这些还没有被充分利用。设计这种类型的高级体验作为DL模型的输入仍然是一个悬而未决的问题。

3.1D、2D和3D数据融合和选择方法(1D, 2D, and 3D data fusion and selection methods)

通常,与低维数据相比,高维数据包含更多的信息。如果是这种情况,那么基于2D数据的模型的性能应该比基于1D数据的模型更好。然而,正如我们上面所讨论的,混合方法使用1D、2D和3D数据,消融实验已经证明了它们在MPP中的单独作用,这表明低维数据贡献的信息并没有完全被高维数据覆盖。这里提出的一个问题是,当已经在使用高维数据(2D或3D数据)时,为什么1D数据仍然有助于模型性能。这可以从以下两个角度来回答。首先,当将1D序列转换为2D图时,一些信息可能会丢失。其次,DL模型不能充分利用高维数据中的隐藏信息;因此,1D数据仍然用作辅助信息源。

无论是什么原因,如何确定适当的数据类型(或多种类型的最佳组合)仍然是一个悬而未决的问题。

4.元学习方法(Meta-learning methods)

转移学习、多任务学习和元学习都用于解决某些财产可用实验数据的缺乏。我们已经回顾了一些合适的方法,在我们看来,我们认为金属学习方法是目前最有前途的研究方向之一。更具体地说,元学习是实际应用的理想方法,因为某些任务可能只有少数实例(例如,预测一些罕见的分子财产),而由于数据样本数量有限,无法使用传统的ML或DL模型。因此,MPP的元学习方法值得进一步研究。

5.DL模型的可解释性(The interpretability of DL models)

我们已经讨论了一些关于DL可解释性的方法。与图像处理中的传统任务不同,大多数与分子相关的任务都是高度专业化的,需要化学专家来分析潜在的机制,例如分子亚结构的作用。分子相关任务的这些特征与DL模型的“黑盒”性质有些矛盾。因此,提高DL模型的可解释性始终是必要的。更具体地说,通过分析成功预测和失败的数据样本来定位模型中的关键功能元素,不仅有利于DL模型的最终性能,也有利于新的QSAR理论的发现。在我们看来,主动方法是一种更强大的工具,可以通过添加特定参数来提高DL模型的可解释性。

总结

在这篇综述中,综述了多种类型分子数据的DL方法以及新兴的方法,包括迁移学习、元学习等。此外,还讨论了DL模型中分子的可解释性方法。

使用DL方法在药物发现方面取得了重大进展。然而,在提高分子表征和性质预测的性能、鲁棒性和可解释性方面,它仍然面临着更多的挑战。

这篇关于论文阅读——《Deep learning methods for molecularre presentation and property prediction》的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!