本文主要是介绍CVPR 2018:Image Correction via Deep Reciprocating HDR Transformation -- 论文笔记,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

CVPR 2018: Image Correction via Deep Reciprocating HDR Transformation 来自大连理工大学,香港城市大学和腾讯AI lab。

论文下载: https://arxiv.org/abs/1804.04371

论文根据相机成像的过程,提出了往复式HDR的思想,用于恢复过曝光或欠曝光图像在图像恢复(image correction)过程中易丢失的细节。

图像恢复问题可以追溯到CCDs的发明,CCDS中存在半导体,使得自然场景图和成像像素之间存在着非线性的关系,而这个非线性关系通常通过gamma校正得到。

相机成像过程如下图,相机响应函数CRF,曝光时间 t,自然场景S:

在曝光度不恰当时,就会出现过曝或者欠曝的情况:下图分别表示欠曝、正常曝光、过曝和合成HDR。

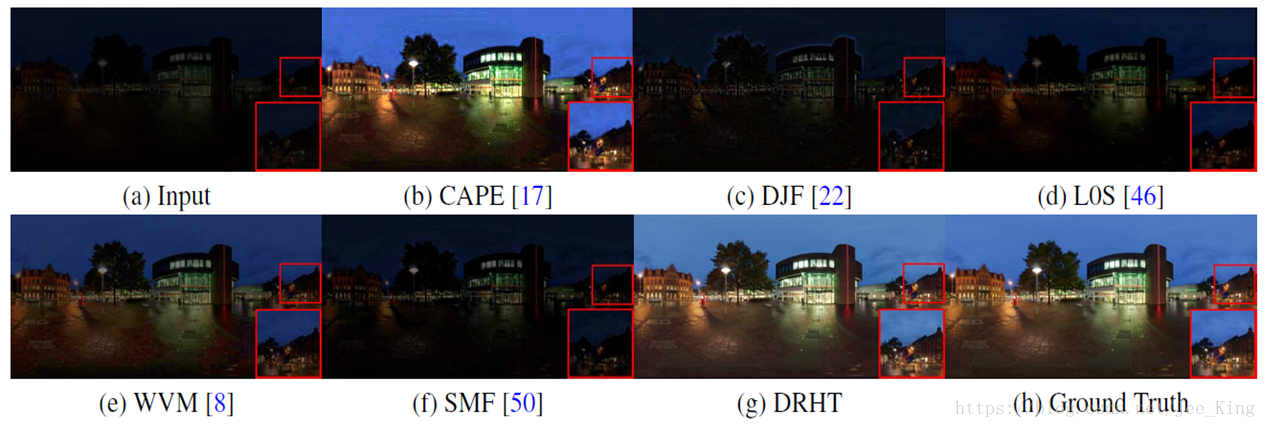

目前存在许多图像修复方法不能很好地恢复过曝欠曝下图像的细节信息:如下图,要么亮度不合适,要么细节恢复能力很差。

下图表示图像形成过程,相机先获取场景然后tone mapping到LDR域。据此,作者提出了一种新的图像恢复方法:先将LDR域图像转至HDR域图像,以此得到更为丰富的细节信息;再将HDR域图像恢复至LDR域图像,利用HDR域所带有的细节信息。而目前存在的绝大部分的方法都只是在LDR域进行图像的恢复问题。

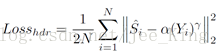

论文的整个pipeline:两个相似的encoder-decoder网络结构,前半部用于恢复HDR域的细节信息,后半部用于HDR到LDR域的转换。整个过程用公式表达为 :

数据集:The city scene panorama dataset. 39,198 训练,1,672 evaluation; The Sun360 outdoor panorama dataset. 6,400 微调;【数据集可能存在不太合理的情况,此类问题的数据集还需要改进】

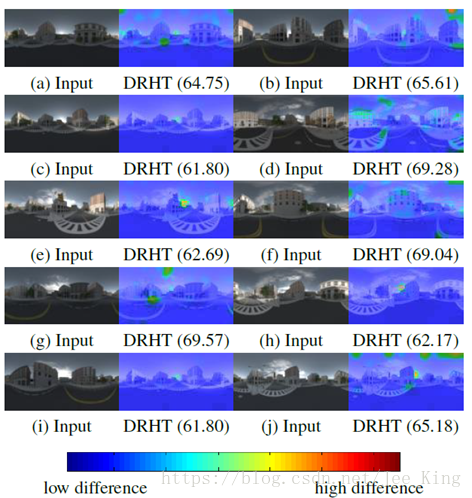

前半子网络性能分析:下图用来显示重建的HDR和GT 之间的差别(可是论文说不生成HDR图,也许是S^full?),由蓝色到红色表示差别的大小。

效果图:

buxile bisaikaishile!

这篇关于CVPR 2018:Image Correction via Deep Reciprocating HDR Transformation -- 论文笔记的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!

![BUUCTF靶场[web][极客大挑战 2019]Http、[HCTF 2018]admin](https://i-blog.csdnimg.cn/direct/ed45c0efd0ac40c68b2c1bc7b6d90ebc.png)