本文主要是介绍WPS阅读论文和记笔记,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

WPS阅读论文和记笔记

总体实例

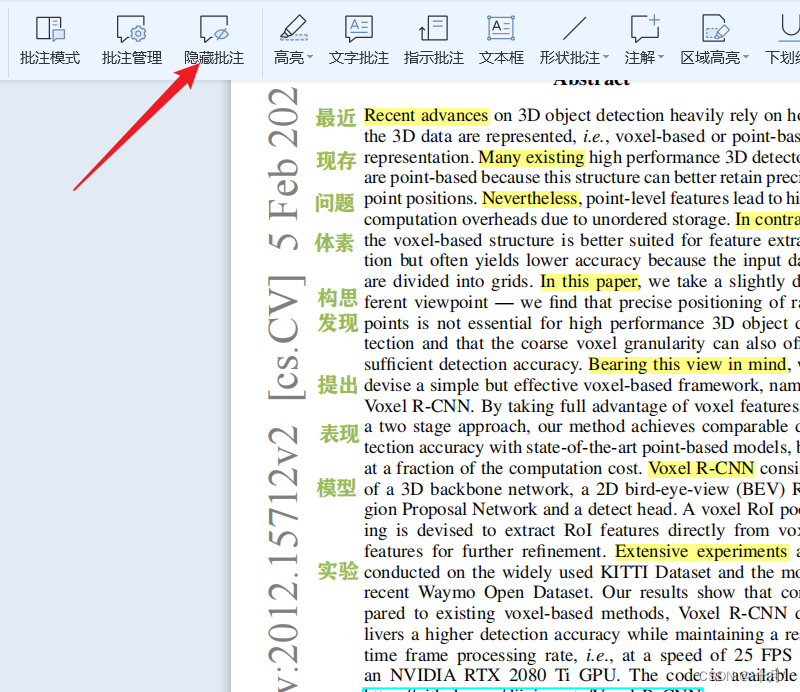

可以试试拿WPS做论文笔记或者拿别的做了拿这个看,还挺方便的。

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-D4dGwHou-1684546446460)(C:\Users\zgh\AppData\Roaming\Typora\typora-user-images\image-20230520092721261.png)]](https://img-blog.csdnimg.cn/42eb3d9d2cf8491890c3afd8be6b58cd.png)

笔记批注内容和思路

这是做了之后的,用文字批注标出来每块区域大致内容,方便检索和回顾。(文字批注字体和颜色可以选自己喜欢的,相当于自己独特的东西,我挺喜欢)

然后对于每一段去高亮重点段落的开头,这些都是有逻辑的,比如摘要里面,会这么写:

- 最近,,,

- 现存方法,,,

- 问题,,,

- 我们的构思,,,

- 我们提出了,,,

- 具体而言,,

- 实验,,,,

这样的结构,文字批注也是把这个标出来,这样一下就能想起来每一节每一块按照逻辑将的东西。

然后对于每一块,最近,,现存,,问题这样的东西,我会高亮标出来,自己意译,这样是你自己理解的东西,和原文就有些差别了,可以后续做笔记或者加到自己论文里,当前人的工作,或者相关工作。

一些细节

WPS里面批注一开始都是合起来的,不会看上去满页都是批注,找不到原文内容。然后鼠标移过去他会显示,移走就消失。需要看那块的时候移过去就好,不会很乱

批注工具:

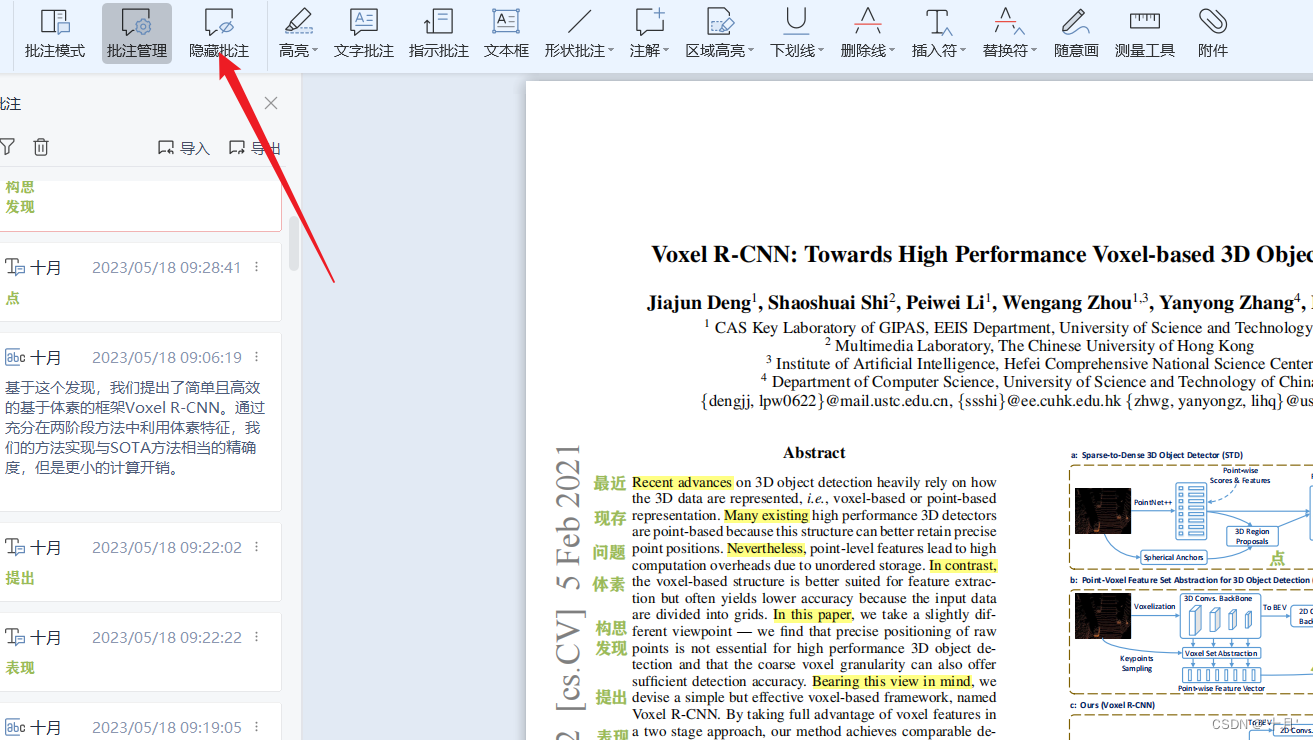

最后上面有几个批注管理工具

隐藏批注:隐藏批注后,文中所有批注消失,很干净了就。

批注模式:批注模式会打开所有的批注,在做完笔记后进行整理的时候,打开所有,直接复制需要的内容到论文总结中,也挺快的

批注管理:批注管理,对批注修改,删除,等等

PXJfHu-1684546446463)]

批注管理:批注管理,对批注修改,删除,等等

这篇关于WPS阅读论文和记笔记的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!

![[论文笔记]LLM.int8(): 8-bit Matrix Multiplication for Transformers at Scale](https://img-blog.csdnimg.cn/img_convert/172ed0ed26123345e1773ba0e0505cb3.png)