72b专题

零一万物Yi-1.5开源,34B/9B/6B多尺寸,34B超Qwen1.5-72B

前言 近年来,大型语言模型(LLM)在各个领域展现出惊人的能力,为人们的生活和工作带来了巨大的改变。然而,大多数开源 LLM 的性能仍然无法与闭源模型相媲美,这限制了 LLM 在科研和商业领域的进一步应用。为了推动 LLM 的开源发展,零一万物团队推出了全新一代的开源语言模型——Yi-1.5,并提供 34B/9B/6B 三种不同尺寸,旨在为研究人员和开发者提供更多选择,助力 LLM 的发展与应用

集简云新增通义千问qwen 72b chat、qwen1.5 等多种大语言模型,提升多语言支持能力

通义千问再开源!继发布多模态模型后,通义千问 1.5 版本也在春节前上线。 此次大模型包括六个型号:0.5B、1.8B、4B、7B、14B 和 72B,性能评测基础能力在在语言理解、代码生成、推理能力等多项基准测试中均展现出优异的性能,且支持多语言。 为了满足用户对多种AI模型的需求,快速体验到更加强大和多样化的AI能力,集简云目前已将以下应用模型快速接入到平台内,您可在通义千问模型开源版(原

第二十篇-推荐-纯CPU(E5-2680)推理-llama.cpp-qwen1_5-72b-chat-q4_k_m.gguf

环境 系统:CentOS-7 CPU: Intel® Xeon® CPU E5-2680 v4 @ 2.40GHz 14C28T 内存: 48G DDR3 依赖安装 make --versionGNU Make 4.3gcc --versiongcc (GCC) 11.2.1 20220127 (Red Hat 11.2.1-9)g++ --versiong++ (GCC) 11.2.

LLM - Qwen-72B LoRA 训练与推理实战

目录 一.引言 二.模型简介 1.Qwen-Model 总览 2.Qwen-Chat-72B - PreTrain - Tokenizer - Base Line - SFT / RLHF 3.Qwen-72 模型架构 - Config.json - c_attn/c_proj - Attention Forward - ROPE - Qwen MLP - Qw

轻松上手:通过阿里云PAI QuickStart微调部署Qwen-72B-Chat模型

作者:熊兮、求伯、一耘 引言 通义千问-72B(Qwen-72B)是阿里云研发的通义千问大模型系列的720亿参数规模模型。Qwen-72B的预训练数据类型多样、覆盖广泛,包括大量网络文本、专业书籍、代码等。Qwen-72B-Chat是在Qwen-72B的基础上,使用对齐机制打造的基于大语言模型的AI助手。 阿里云人工智能平台PAI是面向开发者和企业的机器学习/深度学习平台,提供AI开发全链路

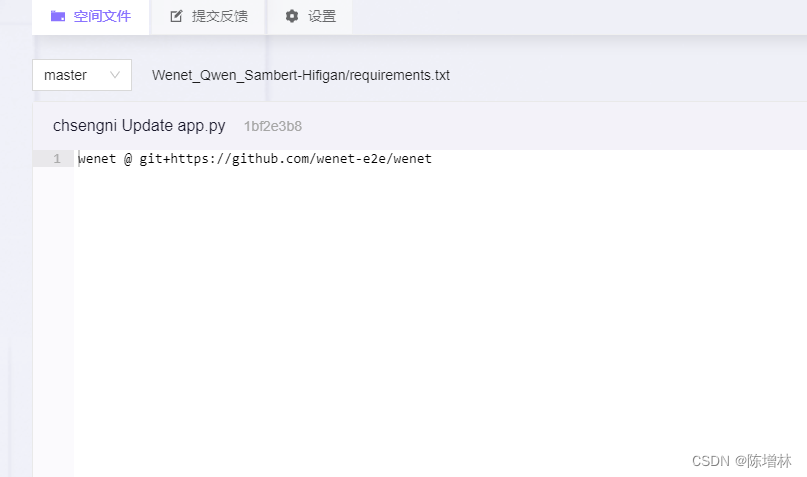

WeNet语音识别+Qwen-72B-Chat Bot+Sambert-Hifigan语音合成

WeNet语音识别+Qwen-72B-Chat Bot👾+Sambert-Hifigan语音合成 简介 利用 WeNet 进行语音识别,使用户能够通过语音输入与系统进行交互。接着,Qwen-72B-Chat Bot作为聊天机器人接收用户的语音输入或文本输入,提供响应并与用户进行对话。最后,系统利用 Sambert-Hifigan 进行语音合成,将机器人的响应转换为自然流畅的语音输出,使

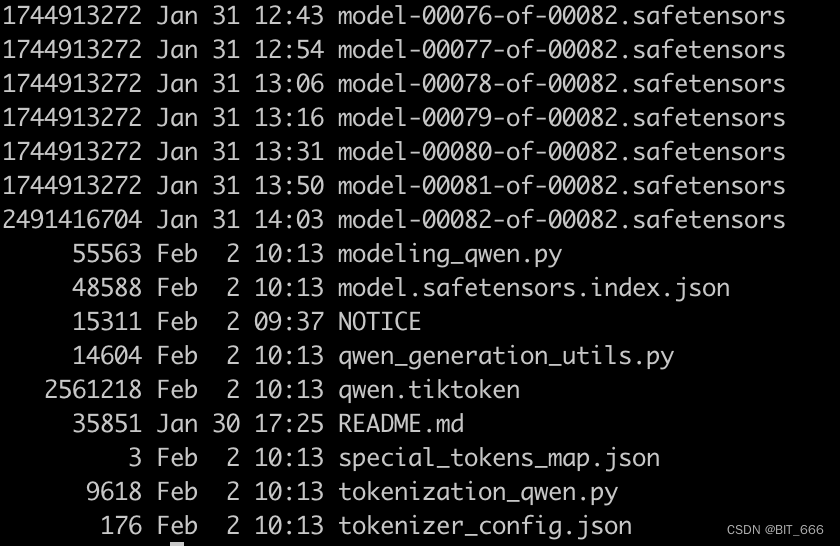

阿里开源大模型 Qwen-72B 私有化部署

近期大家都知道阿里推出了自己的开源的大模型千问72B,据说对于中文非常友好,在开源模型里面,可谓是名列前茅。 千问拥有有强大的基础语言模型,已经针对多达 3 万亿个 token 的多语言数据进行了稳定的预训练,覆盖领域、语言(重点是中文和英文)。 Qwen 模型在一系列基准数据集(例如 MMLU、C-Eval、GSM8K、MATH、HumanEval、MBPP、等)上优于类似模型大小的基线