1900k专题

阿里与上交大提出 LLM 长文本计算新解法:可处理文本长达 1900k 字节

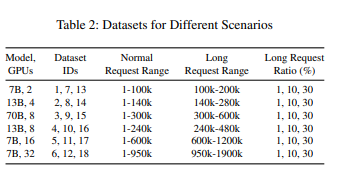

在实际应用大模型的过程中,尤其是处理长文本的上下文信息时,如何高效灵活地调度计算资源成为一个学术界与工业界共同关注的问题。 大语言模型所能容纳的上下文长度直接影响了诸如 ChatGPT 等高级应用与用户交互体验的优劣程度,这给云环境下的 LLM 服务系统提出了严峻挑战:不合理的资源配置不仅可能导致性能瓶颈,还可能造成宝贵的计算资源浪费。 最近,上海交通大学携手阿里研究团队针对这个问题开展了一项